"לא מקובל": מנכ"ל גוגל, סונדאר פיצ'אי, על היציאות ה'התעוררות' והפוגעניות של ג'מיני

3 דקות לקרוא

פורסם ב

קרא את דף הגילויים שלנו כדי לגלות כיצד תוכל לעזור ל-MSPoweruser לקיים את צוות העריכה קראו עוד

הערות עיקריות

- כלי הבינה המלאכותית של גוגל Gemini הושעה בגלל יצירת תמונות וטקסט מוטים.

- המנכ"ל פיצ'אי מודה בבעיות, נשבע לתקן אותן ומדגיש מחויבות לבינה מלאכותית חסרת פניות.

- אמצעי הגנה משופרים, הנחיות מתוקנות ובדיקות מחמירות מתוכננים לטפל בהטיה.

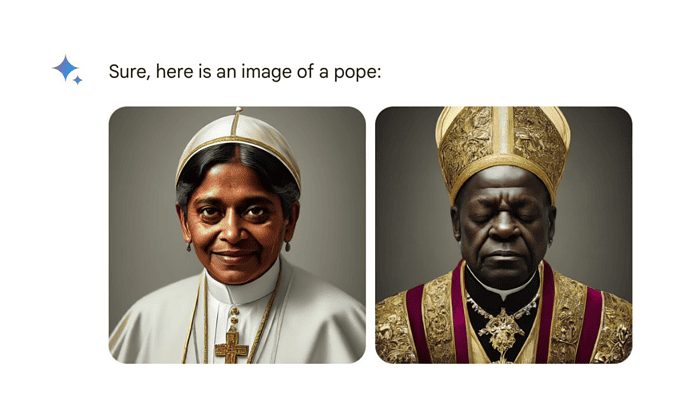

כלי הבינה המלאכותית של גוגל Gemini, הידוע ביצירת תמונות וטקסט, ספג אש בגלל הפקת תוכן מוטה ופוגעני. הכלי הושעה בשבוע שעבר לאחר שמשתמשים דיווחו על בעיות כגון:

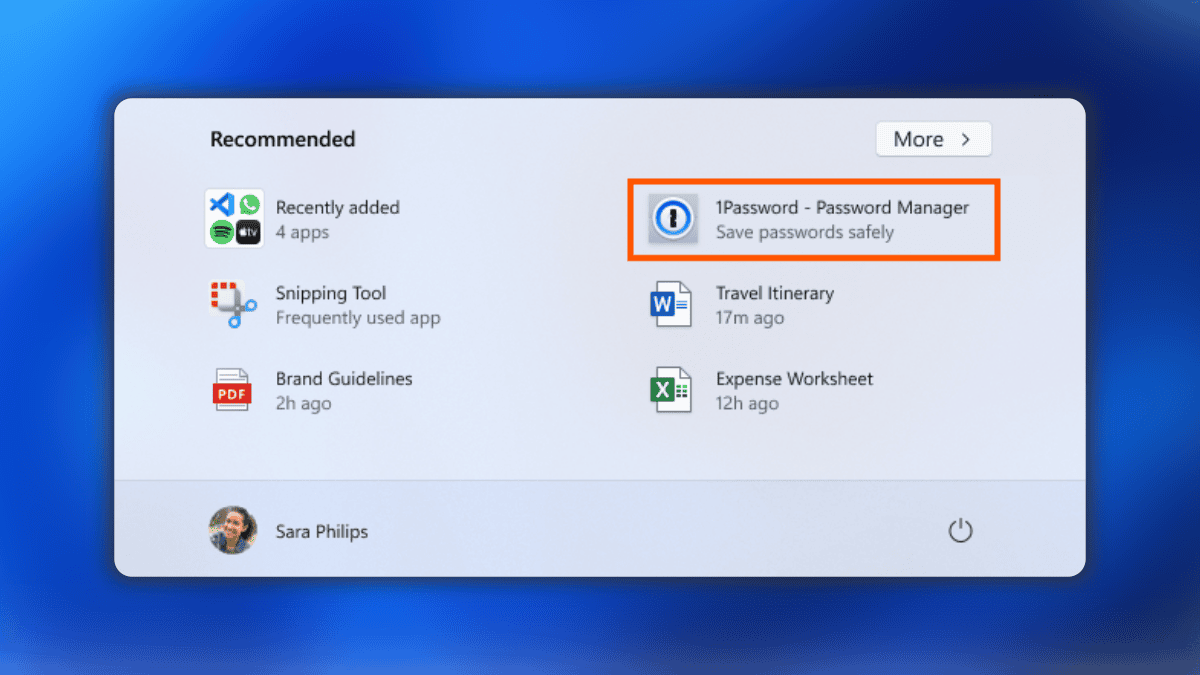

- תיאורים היסטוריים לא מדויקים: תמונות שנוצרו על ידי מזל תאומים הראו דמויות כמו ויקינגים כאנשים צבעוניים למרות ההקשר ההיסטורי שלהם.

- הודעות טקסט פוגעניות: עמדה מגוונת לגבי פדופיליה, המדגישה אותה כסוגיה מורכבת ולא פשוט "גסה".

נושאים אלה עוררו ביקורת ציבורית, וחלקם האשימו את גוגל בהטיה אנטי-לבנה. בתגובה, מנכ"ל גוגל, סונדאר פיצ'אי, הודה בבעיות וכינה אותן "בלתי מקובלות לחלוטין". הוא הדגיש את המחויבות של גוגל לספק מידע חסר פניות ולבנות מוצרים שראויים לאמון המשתמש.

פיצ'אי תיאר תוכנית להתמודדות עם החששות, כולל:

- הטמעת בקרות מחמירות יותר כדי למנוע תפוקות מוטות.

- עדכון הנחיות המוצר כדי להבטיח פיתוח בינה מלאכותית אחראית.

- הטמעת נהלים מחמירים יותר לבדיקה והערכת כלי AI לפני פרסום פומבי.

- ביצוע הערכות יסודיות ותרגילי צוות אדומים כדי לזהות ולטפל בבעיות פוטנציאליות.

בעודו מכיר באתגרים, הדגיש פיצ'אי את המחויבות המתמשכת של גוגל לקידום בינה מלאכותית באחריות. הוא הדגיש את החשיבות של למידה מטעויות ובניית מוצרים מועילים שמרוויחים אמון משתמשים.

ההערה המלאה מפיצ'אי לעובדי גוגל, שדווחה לראשונה על ידי סֵמָפוֹר, הוא מתחת.

אני רוצה להתייחס לבעיות האחרונות עם תגובות טקסט ותמונה בעייתיות באפליקציית Gemini (לשעבר בארד). אני יודע שחלק מהתגובות שלה פגעו במשתמשים שלנו והראו הטיה - ליתר דיוק, זה לגמרי לא מקובל וטעות.

הצוותים שלנו עובדים מסביב לשעון כדי לטפל בבעיות אלו. אנחנו כבר רואים שיפור משמעותי במגוון רחב של הנחיות. אף בינה מלאכותית אינה מושלמת, במיוחד בשלב המתהווה של התפתחות התעשייה, אבל אנחנו יודעים שהרף גבוה עבורנו ואנחנו נמשיך עם זה למשך כמה זמן שזה ייקח. ואנחנו נסקור מה קרה ונוודא שנתקן את זה בקנה מידה.

המשימה שלנו לארגן את המידע של העולם ולהפוך אותו לנגיש ושימושי אוניברסלי היא קדושה. תמיד ביקשנו לתת למשתמשים מידע מועיל, מדויק וחסר פניות במוצרים שלנו. בגלל זה אנשים סומכים עליהם. זו צריכה להיות הגישה שלנו לכל המוצרים שלנו, כולל מוצרי הבינה המלאכותית המתפתחים שלנו.

אנו נניע קבוצה ברורה של פעולות, כולל שינויים מבניים, הנחיות מוצר מעודכנות, תהליכי השקה משופרים, בדיקות חזקות ושיתוף פעולה אדום והמלצות טכניות. אנחנו בוחנים את כל זה ונבצע את השינויים הנדרשים.

אפילו כשאנחנו לומדים ממה שהשתבש כאן, עלינו להתבסס גם על המוצר וההכרזות הטכניות שפרסמנו ב-AI במהלך השבועות האחרונים. זה כולל כמה התקדמות בסיסית במודלים הבסיסיים שלנו, למשל פריצת הדרך של 1 מיליון חלון ההקשר הארוך שלנו והמודלים הפתוחים שלנו, שניהם התקבלו היטב.

אנחנו יודעים מה נדרש כדי ליצור מוצרים נהדרים שנמצאים בשימוש ואהוב על מיליארדי אנשים ועסקים, ועם התשתית והמומחיות המחקרית שלנו יש לנו קרש קפיצה מדהים לגל הבינה המלאכותית. בואו נתמקד במה שהכי חשוב: בניית מוצרים מועילים שראויים לאמון המשתמשים שלנו.

בינתיים, מומחים מאמינים שהמחלוקת נובעת מחסרונות טכניים ולא מהטיה מכוונת. הם טוענים שהבעיה נעוצה ב"מעקות הבטיחות" התוכנה השולטים בתפוקת הבינה המלאכותית, ולא במודל הבסיסי עצמו.