GPT-4 זמין כעת למנויי ChatGPT Plus

3 דקות לקרוא

פורסם ב

קרא את דף הגילויים שלנו כדי לגלות כיצד תוכל לעזור ל-MSPoweruser לקיים את צוות העריכה קראו עוד

OpenAI נחשפה סוף סוף GPT-4. לדברי החברה, מודל ה-AI האחרון שלה מדויק ויעיל יותר מכיוון שהוא יכול להתמודד עם יותר קלט ללא בלבול. בנוסף לכך, ל-GPT-4 אכן יש רב-מודאלי יכולת, המאפשרת לו לעבד תמונות. GPT-4 זמין כעת למנויי ChatGPT Plus, ומפתחים יכולים כעת לגשת אליו כ-API.

לאחר דיווחים לגבי הגעתו בשבוע שעבר, GPT-4 סוף סוף כאן, מועבר דרך התשתית המותאמת לבינה מלאכותית של Azure. הוא הוכשר על מחשבי-על של Microsoft Azure AI ויש לו כמה הבדלים בולטים מ-GPT-3.5. בפרט, GPT-4 קלע באחוזון 88 ומעלה במבחנים ובנצ'מרקים שונים.

"בשיחה סתמית, ההבחנה בין GPT-3.5 ל-GPT-4 יכולה להיות עדינה", אומר OpenAI בפוסט בבלוג. "ההבדל מתגלה כאשר מורכבות המשימה מגיעה לסף מספיק - GPT-4 אמין יותר, יצירתי ומסוגל להתמודד עם הוראות הרבה יותר ניואנסיות מ-GPT-3.5."

באופן כללי, OpenAI אמרה שזה 82% פחות אפשרי שהמודל החדש יגיב לנושאים ובקשות מוגבלות, מה שהופך אותו לבטוח עבור המשתמשים. גם איכות התגובה שלו השתפרה, עם סבירות של עד 40% להפקת תשובות עובדתיות.

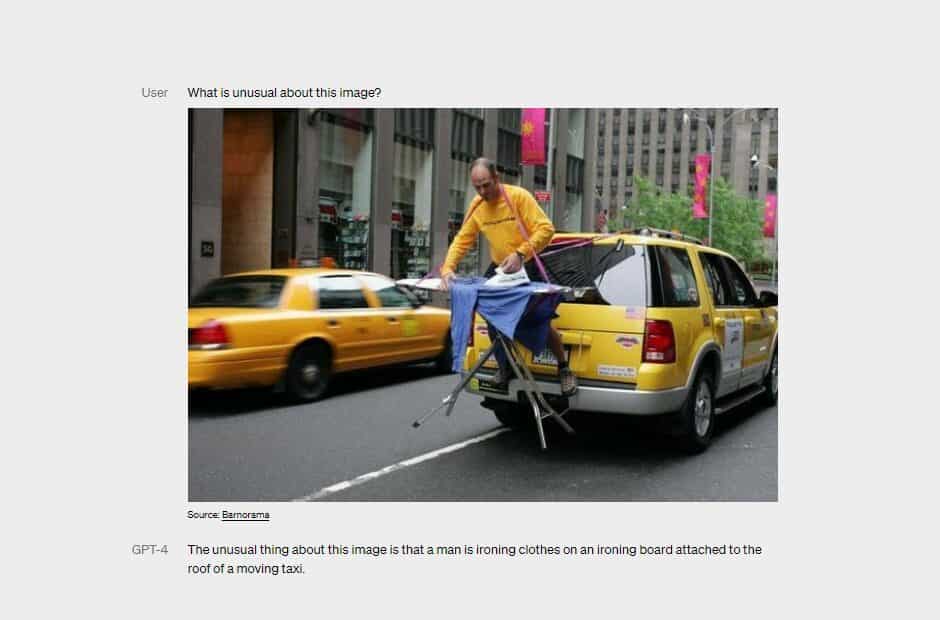

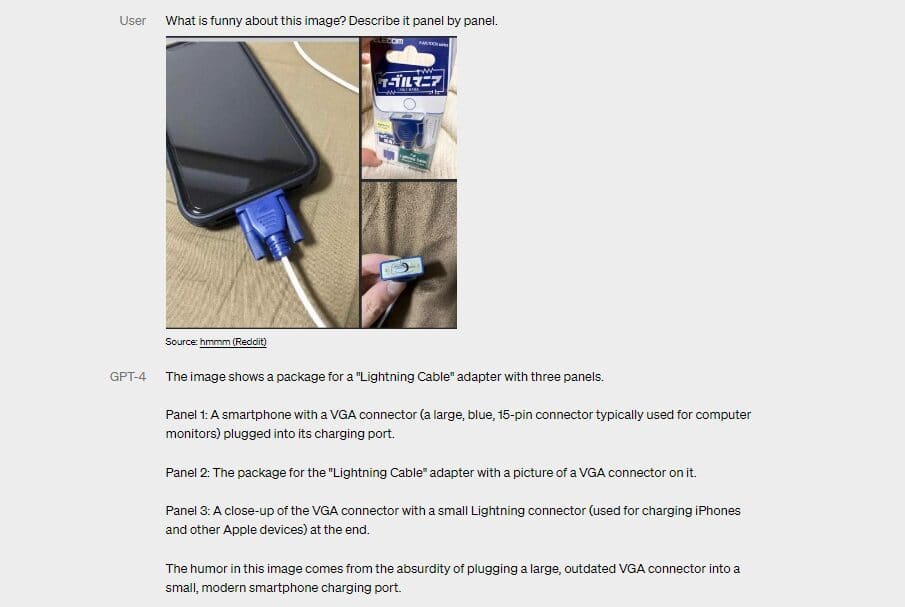

חלק עצום מ-GPT-4 מתמקד ביכולת שלו לטפל בשאילתות בצורה יעילה יותר. כפי שציינה OpenAI, כעת היא יכולה לקבל 25,000 מילים של טקסט מבלי לחוות בלבול. אלו חדשות טובות למשתמשים שרוצים לנצל את מלוא הפוטנציאל של הדגם, שכן הם יורשו לספק פרטים נוספים והנחיות בשאלות ובבקשות שלהם. גולת הכותרת הגדולה ביותר של GPT-4, עם זאת, היא תוספת של יכולת מולטי-מודאלית, שהייתה אחת הציפיות הגדולות מהדגם מאז שדווח עליה בשבוע שעבר. באמצעות היכולת החדשה הזו, GPT-4 יכול כעת לעבד קלט תמונות ולתאר אותם באמצעות טקסטים, אם כי הוא עדיין לא זמין לכל לקוחות OpenAI מכיוון שהוא עדיין בבדיקה טכנית בעזרת Be My Eyes ותכונת ההתנדבות הווירטואלית שלו .

"לדוגמה, אם משתמש שולח תמונה של החלק הפנימי של המקרר שלו, המתנדב הוירטואלי לא רק יוכל לזהות נכון את מה שיש בו, אלא גם להרחיב ולנתח מה ניתן להכין עם אותם מרכיבים", תיאר OpenAi את הפונקציה . "הכלי יכול גם להציע מספר מתכונים עבור אותם מרכיבים ולשלוח מדריך שלב אחר שלב כיצד להכין אותם."

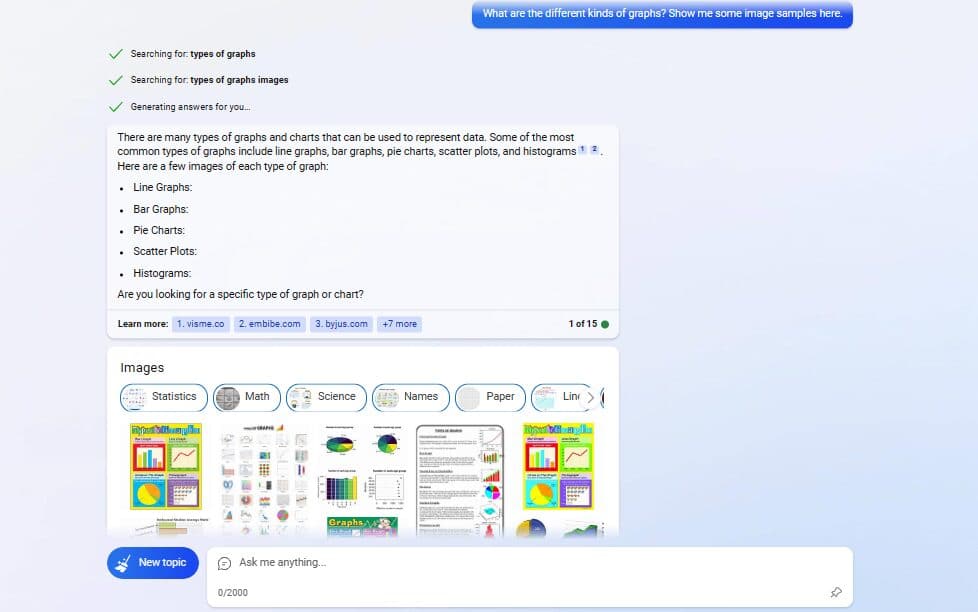

וואו בינג יכול עכשיו לתאר תמונות, עכשיו שהוא יודע שהוא משתמש ב-GPT-4!

byu/BroskiPlaysYT inבינג

אף על פי כן, נראה שהיכולת הרב-מודאלית הזו מובאת חלקית לתוך ה- בינג חדש. מיקרוסופט אמרה שהצ'אטבוט של מנוע החיפוש שלה מריץ את המודל מאז השבוע שעבר. עם זאת, חשוב לציין שהתכונה המולטי-מודאלית של Bing עדיין מוגבלת. כדי להתחיל, הוא יכול לקבל תמונות רק באמצעות קישורים המסופקים באינטרנט, אותם הוא יתאר כתגובה. בינתיים, כאשר יתבקשו תמונות באמצעות תיאורים, הצ'אטבוט יספק את התוכן הרלוונטי ביותר, כולל תוצאות תמונה ועוד.

בהערה צדדית, השיפורים הללו ב-GPT-4 אינם אומרים את הסוף של בעיות קיימות הקיימות בדרך כלל בכל מוצרי הבינה המלאכותית הגנרטיבית. למרות ש-OpenAI הבטיחה לדגם להיות בטוח יותר מ-GPT-3.5 מבחינת סירוב להגיב להוראות מזיקות, הוא עדיין יכול ליצור הזיות והטיות חברתיות. אפילו מנכ"ל OpenAI, סם אלטמן מְתוּאָר GPT-4 כמשהו "עדיין פגום, עדיין מוגבל." למרות זאת, הצוות מוקדש לשיפור מתמיד של המודל ככל שהוא ממשיך למשוך יותר תשומת לב מהציבור וככל שמיקרוסופט מזריקה אותו ליותר ממוצריה.