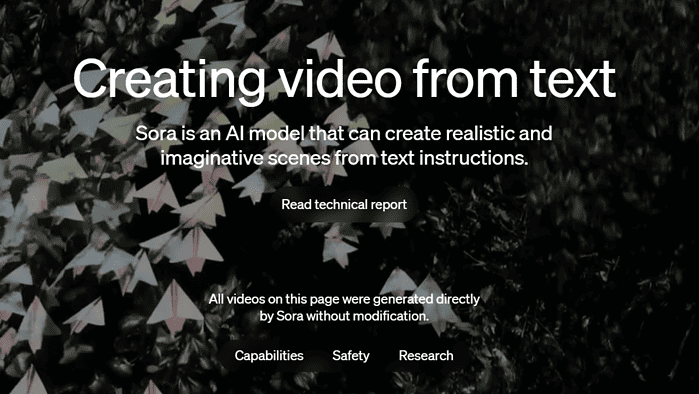

Scopri Sora, il nuovo modello text-to-video di OpenAI che crea straordinari video HD basati su istruzioni di testo

La questione non è “possiamo farlo”, ma “dovremmo farlo”.

2 minuto. leggere

Edizione del

Leggi la nostra pagina informativa per scoprire come puoi aiutare MSPoweruser a sostenere il team editoriale Per saperne di più

Note chiave

- OpenAI ha appena annunciato un nuovo modello di intelligenza artificiale da testo a video, Sora, e sembra impressionante ma allo stesso tempo spaventoso.

- Le persone ora si chiedono se questo modello possa impossessarsi del loro lavoro.

- Il modello conterrà metadati C2PA una volta implementato in un prodotto OpenAI in futuro.

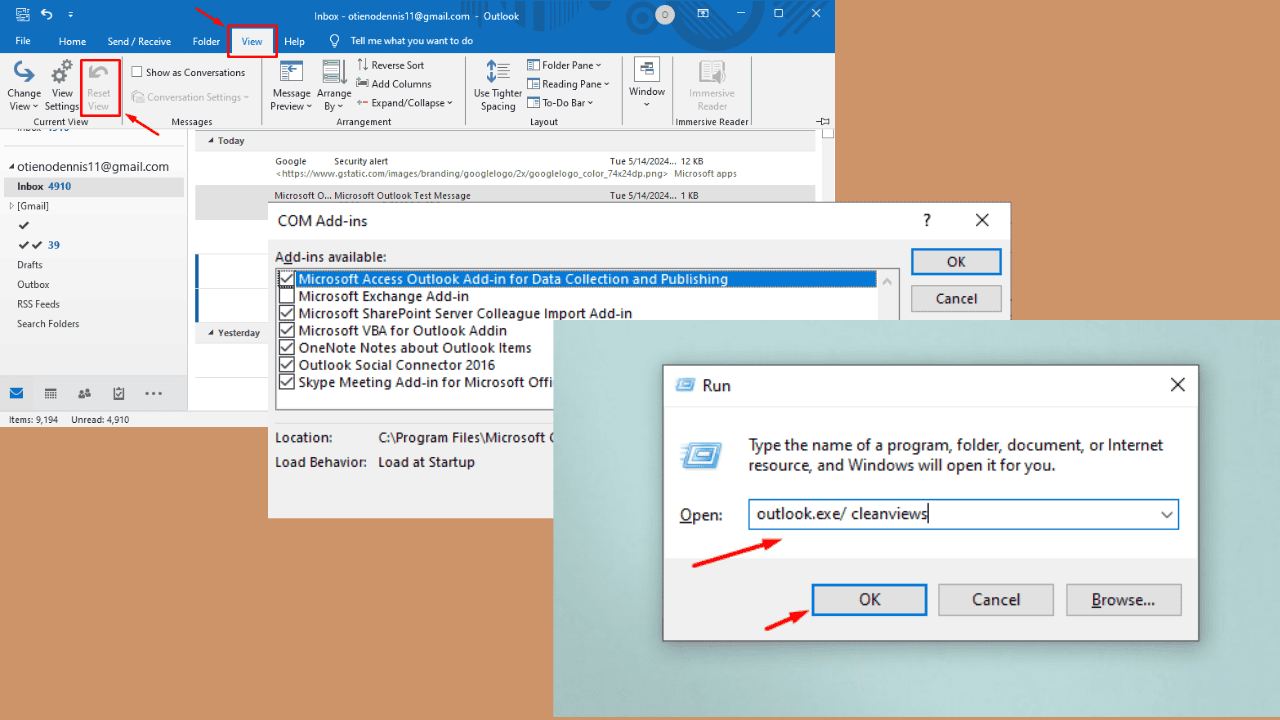

OpenAI ha appena annunciato un nuovo modello di intelligenza artificiale da testo a video, Sora, e sembra impressionante. La premessa sembra piuttosto semplice, ma allo stesso tempo notevole: puoi digitare qualsiasi parola richiesta, per quanto dettagliata desideri, e poi il modello AI tornerà con un video altamente dettagliato di 60 secondi.

Dai un'occhiata ad alcuni dei risultati che Sora potrebbe ottenere:

Onestamente è spaventoso e impressionante allo stesso tempo. La reazione del pubblico è un misto di stupore e allarme, soprattutto considerando Il passato legale di OpenAI controversie con società giornalistiche per il presunto utilizzo dei loro articoli per formare la modella senza il loro consenso.

E dobbiamo anche parlare di potenziali posti di lavoro che potrebbero essere sostituiti. Anche lo stesso capo di OpenAI, Sam Altman, che una volta fu estromesso dall'incarico, ha affermato che il ritmo della nostra ricerca sull'intelligenza artificiale è stato avanzando troppo velocemente e la quantità di adattamenti di cui l’umanità ha bisogno è allarmante.

Questo modello si basa sulla ricerca DALL-E e GPT passata, utilizzando l'esclusivo metodo di ricapitolazione di DALL-E 3 per generare didascalie estremamente descrittive per i dati di allenamento visivo. Tuttavia, deve ancora affrontare sfide nella simulazione realistica di scene complesse, nella comprensione delle relazioni di causa-effetto e nel non confondere i dettagli spaziali di un prompt.

Quando verrà implementato in un prodotto OpenAI in futuro, che si tratti di ChatGPT, una nuova offerta o Copilot, il modello conterrà metadati C2PA, in modo simile a ciò che Microsoft ha fatto su Creatore di immagini da Designer. I controlli di testo e immagini proteggono i prodotti OpenAI da contenuti dannosi come violenza, incitamento all'odio e violazione della proprietà intellettuale.

"Stiamo inoltre garantendo l'accesso a una serie di artisti visivi, designer e registi per ottenere feedback su come far avanzare il modello per essere più utile per i professionisti creativi", afferma OpenAI.