Nordcoreani che utilizzano ChatGPT per truffare gli utenti di LinkedIn; "gli attacchi stanno diventando molto sofisticati"

2 minuto. leggere

Edizione del

Leggi la nostra pagina informativa per scoprire come puoi aiutare MSPoweruser a sostenere il team editoriale Per saperne di più

Note chiave

- La Corea del Nord utilizza strumenti di intelligenza artificiale come ChatGPT per attacchi informatici sofisticati contro i lavoratori statunitensi.

- Gli obiettivi includono dipendenti nei settori della sicurezza informatica, della difesa e delle criptovalute su piattaforme come LinkedIn.

- L'intelligenza artificiale aiuta a creare falsi profili di reclutatori, creare messaggi e creare fiducia con gli obiettivi.

Rapporti recenti indicano che i gruppi di hacker nordcoreani stanno impiegando strumenti di intelligenza artificiale come ChatGPT per lanciare complessi attacchi informatici contro i colletti bianchi americani. Questo sviluppo solleva preoccupazioni riguardo al panorama in evoluzione delle minacce online e al potenziale uso improprio dell’intelligenza artificiale per scopi dannosi.

Gli attori nordcoreani stanno sfruttando gli LLM basati sull’intelligenza artificiale per generare contenuti probabilmente utilizzati nelle campagne di spear-phishing. Queste campagne in genere implicano l'impersonificazione di entità legittime, come i reclutatori, per indurre le persone a rivelare informazioni sensibili o a fare clic su collegamenti dannosi.

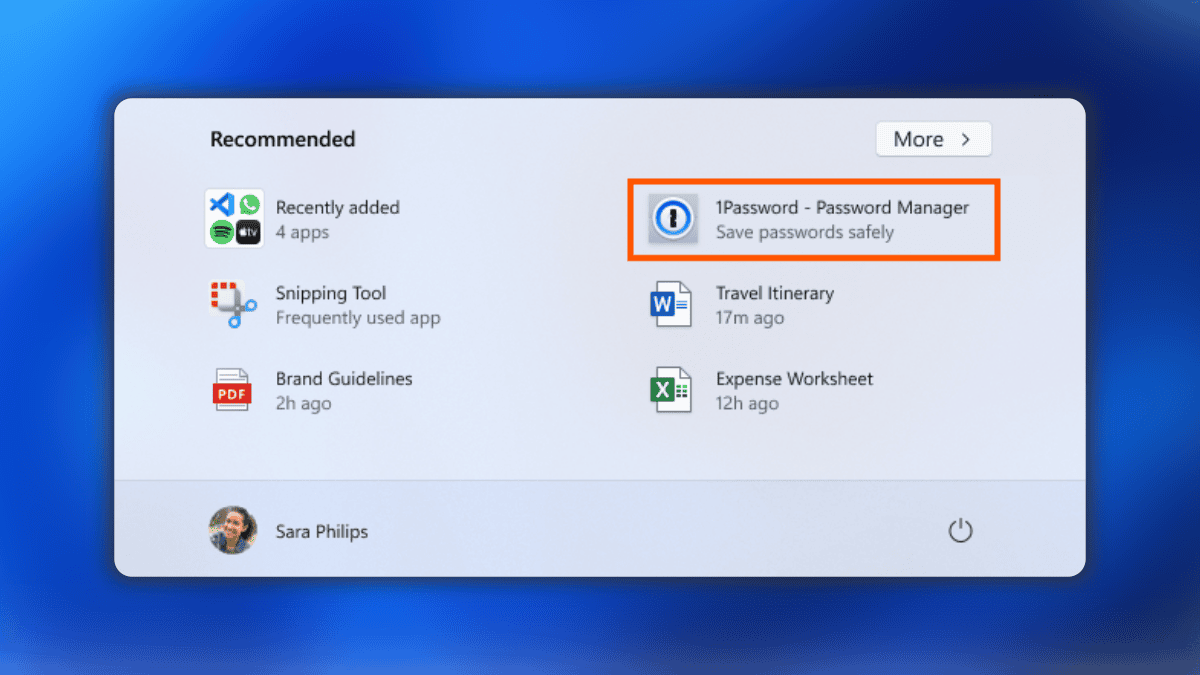

Gli obiettivi di questi attacchi sembrano essere concentrati in settori specifici, tra cui società globali di sicurezza informatica, difesa e criptovaluta. Mezzi sociali piattaforme come LinkedIn, Facebook, WhatsApp, Discord e Telegram fungono da campo di battaglia principale per queste operazioni, con LinkedIn che emerge come la piattaforma preferita per le truffe di phishing.

Gli esperti ritengono che i fondi acquisiti attraverso questi attacchi informatici vengano incanalati verso il finanziamento dei missili balistici e dei programmi nucleari della Corea del Nord, secondo un gruppo di esperti delle Nazioni Unite. Gli attacchi stessi implicano meticolose tattiche di ingegneria sociale.

Gli hacker crea meticolosamente falsi profili di reclutatori su LinkedIn, impegnandosi in conversazioni estese per creare fiducia con i loro obiettivi. L’intelligenza artificiale generativa è fondamentale in questo processo, poiché assiste nella creazione di contenuti, nella creazione di messaggi e nella fabbricazione di identità.

Gli attacchi stanno diventando molto sofisticati. Non stiamo parlando di un'e-mail mal formulata che dice "clicca su questo collegamento".

afferma Erin Plante, vicepresidente della società di sicurezza informatica Chainalysis.

L’uso dell’intelligenza artificiale da parte della Corea del Nord negli attacchi informatici rappresenta un progresso significativo nelle sue capacità. La nazione è stata coinvolta in progetti informatici a partire dagli anni '1980 e '1990.

Nonostante i sostanziali investimenti della Corea del Nord nell’intelligenza artificiale, i loro tentativi non sono privi di vulnerabilità. Le barriere linguistiche spesso mettono alla prova i gruppi di hacker, portando a incoerenze nella comunicazione e incomprensioni culturali. I casi di inglese scritto male, l’insolita esitazione a partecipare a videochiamate e le risposte scritte sono serviti come segnali di allarme per le potenziali vittime.

Più qui.