Microsoft promette una migliore esperienza di Copilot contro gli attacchi informatici

Microsoft è spesso considerata da molti il leader mondiale nell’intelligenza artificiale generativa

2 minuto. leggere

Edizione del

Leggi la nostra pagina informativa per scoprire come puoi aiutare MSPoweruser a sostenere il team editoriale Per saperne di più

Note chiave

- I rapidi progressi dell’intelligenza artificiale sollevano preoccupazioni riguardo ad usi impropri e vulnerabilità.

- Microsoft affronta quindi questi problemi con l'intelligenza artificiale generativa come i LLM e il modo in cui combatte l'uso improprio dell'intelligenza artificiale.

- L'azienda di Redmond utilizza difese come Spotlighting per proteggersi dagli attacchi ai sistemi di intelligenza artificiale.

L’intelligenza artificiale (AI) è la tecnologia più innovativa che abbiamo previsto e i suoi rapidi progressi a volte possono essere inquietanti. Alcuni hanno detto che lo siamo avanzando troppo velocemente con l’intelligenza artificiale, e con così poco tempo ma così tanti progressi, l’intelligenza artificiale è soggetta ad abusi e vulnerabilità.

Microsoft ha delineato di recente il suo approccio per affrontare questi problemi con l’intelligenza artificiale generativa, in particolare con i modelli linguistici di grandi dimensioni (LLM). Il colosso tecnologico di Redmond è spesso considerato il leader mondiale nel mercato dell'intelligenza artificiale generativa, grazie allo strumento di assistente AI Copilot su Windows e dispositivi mobili.

Microsoft afferma che limita ciò che LLM può e farà utilizzando diversi livelli di difesa attraverso l'architettura di Microsoft AI. I livelli hanno lo scopo di fermare due tipi principali di attacchi ai sistemi di intelligenza artificiale, che si tratti di messaggi dannosi o di contenuti avvelenati.

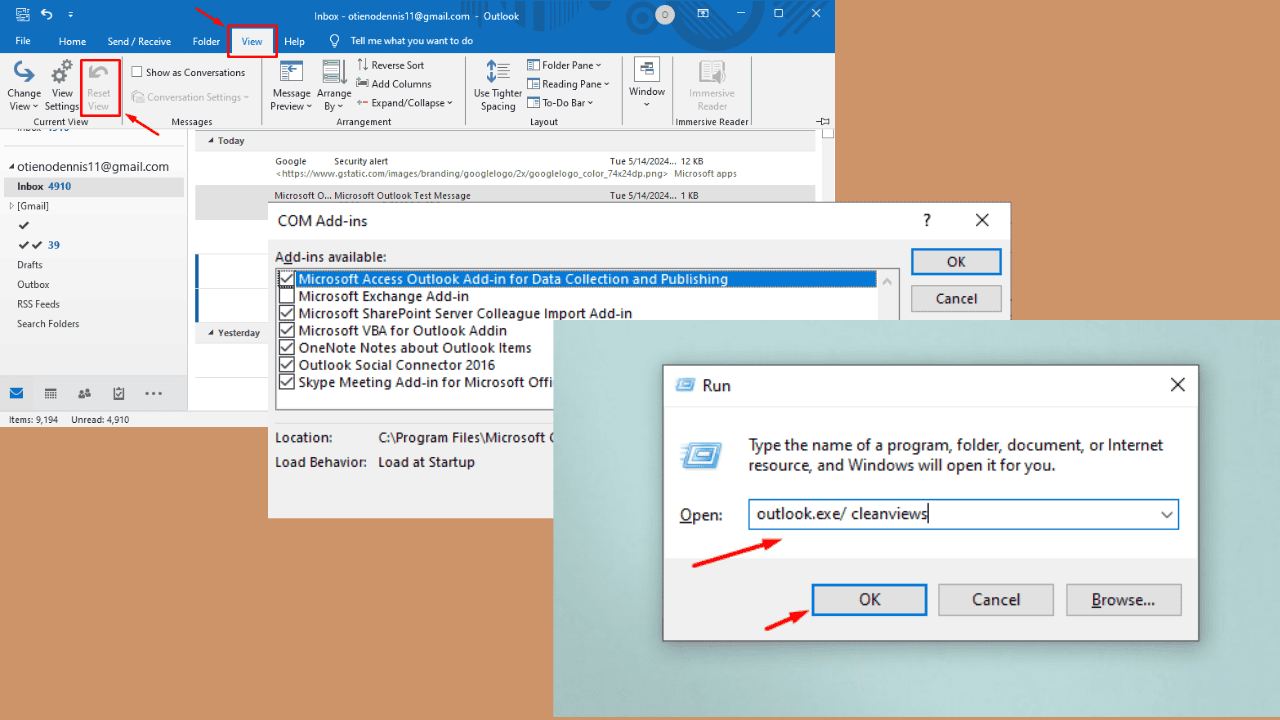

Microsoft ha sviluppato una tecnica chiamata Spotlighting, che contrassegna i dati esterni per differenziarli dalle istruzioni legittime. Ad esempio, un'e-mail errata potrebbe indurre l'intelligenza artificiale a rivelare informazioni sensibili dalle e-mail dell'utente e questo sistema può aiutare l'intelligenza artificiale a distinguerle dai comandi reali senza rallentarla.

Ed è estremamente utile, considerando come sarà presto Copilot ovunque in Outlook, il popolare servizio di posta elettronica. Microsoft è anche a conoscenza di un nuovo tipo di attacco informatico chiamato Crescendo che può manipolare i sistemi di intelligenza artificiale come Copilot per creare contenuti dannosi.

"Nel caso di Crescendo, i nostri team hanno apportato aggiornamenti software alla tecnologia LLM alla base delle offerte AI di Microsoft, inclusi i nostri assistenti AI Copilot, per mitigare l'impatto di questo bypass del guardrail AI multigiro", promette Microsoft.

OpenAI, la società emergente di intelligenza artificiale con un forte sostegno finanziario da Microsoft, ha anche limitato l’uso dell’intelligenza artificiale per le campagne politiche, nel tentativo di promuovere un uso più sano e senza abusi dell’intelligenza artificiale.