Microsoft Azure AI presenta "Prompt Shields" per combattere la manipolazione LLM

2 minuto. leggere

Edizione del

Leggi la nostra pagina informativa per scoprire come puoi aiutare MSPoweruser a sostenere il team editoriale Per saperne di più

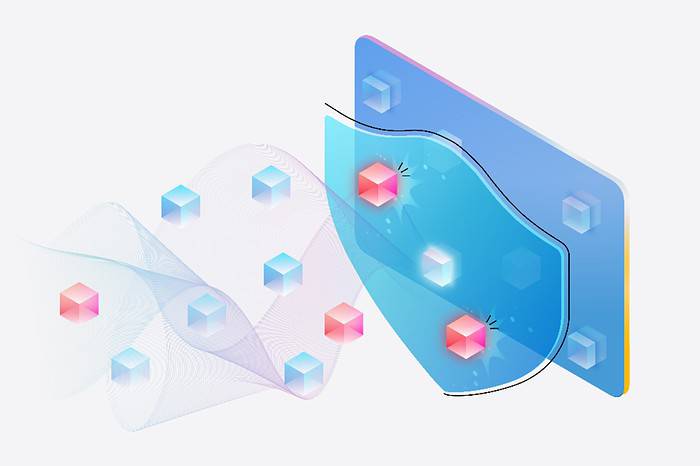

Microsoft oggi ha annunciato un importante miglioramento della sicurezza per il servizio Azure OpenAI e le piattaforme Azure AI Content Safety. Soprannominata “Prompt Shields”, la nuova funzionalità offre una solida difesa contro attacchi sempre più sofisticati che prendono di mira modelli linguistici di grandi dimensioni (LLM).

Prompt Shields protegge da:

- Attacchi diretti: Conosciuti anche come attacchi jailbreak, questi tentativi richiedono esplicitamente al LLM di ignorare i protocolli di sicurezza o eseguire azioni dannose.

- Attacchi indiretti: Questi attacchi incorporano sottilmente istruzioni dannose all'interno di testo apparentemente normale, con l'obiettivo di indurre il LLM a comportarsi in modo indesiderato.

Prompt Shields è integrato con i filtri dei contenuti del servizio Azure OpenAI e è disponibile in Azure AI Content Safety. Grazie ad algoritmi avanzati di apprendimento automatico e all'elaborazione del linguaggio naturale, Prompt Shields è in grado di identificare e neutralizzare potenziali minacce nei prompt degli utenti e nei dati di terze parti.

Spotlighting: una nuova tecnica di difesa

Microsoft ha inoltre introdotto “Spotlighting”, un approccio specializzato di ingegneria tempestiva progettato per contrastare gli attacchi indiretti. Le tecniche di evidenziazione, come la delimitazione e il datamarking, aiutano gli LLM a distinguere chiaramente tra istruzioni legittime e comandi incorporati potenzialmente dannosi.

Disponibilità

Prompt Shields è attualmente in anteprima pubblica come parte di Azure AI Content Safety e sarà disponibile all'interno del servizio Azure OpenAI dal 1° aprile. L'integrazione in Azure AI Studio è pianificata nel prossimo futuro.