Bing potrebbe presto avere la capacità di utilizzare immagini, video e altri tipi di dati nelle risposte

3 minuto. leggere

Edizione del

Leggi la nostra pagina informativa per scoprire come puoi aiutare MSPoweruser a sostenere il team editoriale Per saperne di più

I nuovo Bing basato su ChatGPT è in continuo miglioramento e Microsoft potrebbe iniziare il suo più grande sviluppo la prossima settimana. Andreas Braun, CTO di Microsoft Germania, ha recentemente annunciato che GPT-4 arriverà la prossima settimana. Accanto a questo, il dirigente ha accennato a "modelli multimodali che offriranno possibilità completamente diverse".

Microsoft ha già investito miliardi di dollari nelle sue iniziative di intelligenza artificiale, in particolare nel miglioramento incessante di Bing per competere meglio con Google. Ora, il gigante del software ha confermato l'arrivo di GPT-4 la prossima settimana, che dovrebbe essere inserito nel suo motore di ricerca e nel chatbot.

Prima del rilascio di ChatGPT Bing, c'erano voci su Bing utilizzando GPT-4. Tuttavia, Microsoft ha invece utilizzato il modello GPT-3.5 insieme alla sua tecnologia proprietaria Prometeo, che consente a Bing di generare dati aggiornati. Sorprendentemente, anche se il nuovo Bing non è ancora disponibile per tutti, l'azienda ha già in programma di dare una spinta significativa al motore di ricerca tramite l'imminente GPT-4.

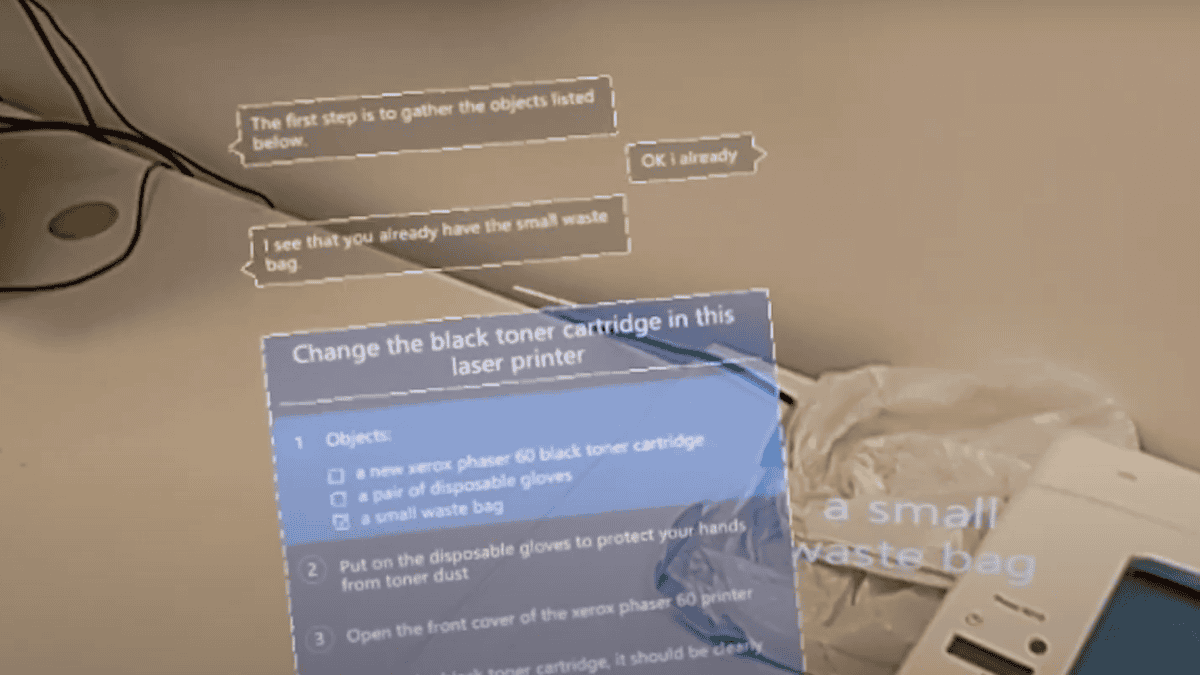

Si prevede che il nuovo e imminente Large Language Model di OpenAI consentirà al chatbot di Bing di generare risultati più rapidi, il che può essere di grande aiuto poiché la versione attuale di solito impiega alcuni secondi per iniziare a generare risposte. Tuttavia, a parte la velocità, una capacità multimodale potrebbe essere la cosa più importante che la nuova introduzione di LLM potrebbe portare.

All'evento AI in Focus – Digital Kickoff di Microsoft, Braun ha condiviso alcuni dettagli su cosa aspettarsi dall'ingresso di un nuovo LLM. (attraverso Heise)

"Introdurremo GPT-4 la prossima settimana, lì avremo modelli multimodali che offriranno possibilità completamente diverse, ad esempio i video", ha affermato Braun, che ha descritto LLM come un "punto di svolta".

Inoltre, Braun ha confermato che Microsoft ha in programma di "rendere i modelli completi" utilizzando la capacità multimodale. Una volta iniettato, questo dovrebbe consentire a Bing di fornire una varietà di dati quando risponde alle domande, il che significa che potrebbe anche elaborare video, immagini e altri tipi di dati. Ciò dovrebbe tradursi in risposte migliori, rendendo Bing un assistente di ricerca più efficace per tutti.

D'altra parte, è importante notare che Bing non è il primo nella multimodalità. Recentemente, Tu.com ha implementato la sua funzione di ricerca chat multimodale, consentendo agli utenti di fornire input di testo e vocali e ricevere risposte oltre i testi di conversazione. Il motore di ricerca, tuttavia, sta ancora lottando per attirare l'attenzione del pubblico. Nel frattempo, nonostante non sia ancora completamente accessibile da tutti, Bing ha già una lista d'attesa in continua espansione. L'iniezione di una capacità multimodale in esso influenzerà sicuramente i suoi rivali, come You.com. Tuttavia, è ancora presto per dire quanto sarà vasto questo effetto poiché l'annuncio di Braun conferma solo pochissimi dettagli.