Što je GPT-3 i kako će utjecati na vaš trenutni posao

3 min. čitati

Ažurirano

Pročitajte našu stranicu za otkrivanje kako biste saznali kako možete pomoći MSPoweruseru da održi urednički tim Čitaj više

GPT je skraćenica za Generative Pre-training Transformer (GPT), jezični model koji je napisao Alec Radford, a objavio OpenAI, istraživački laboratorij umjetne inteligencije Elona Musksa 2018. Koristi se generativnim modelom jezika (gdje se dvije neuronske mreže međusobno usavršavaju konkurencijom) i sposoban je steći znanje o svijetu i obraditi dugotrajne ovisnosti prethodnom obukom na različitim skupovima pisanog materijala s dugim dijelovima uzastopnog teksta.

GPT-2 (Generative Pretrained Transformer 2) najavljen je u veljači 2019. i nenadzirani je jezični model transformatora obučen na 8 milijuna dokumenata za ukupno 40 GB teksta iz članaka podijeljenih putem Reddita. Elon Musk je slavno oklijevao objaviti ga jer se bojao da bi se mogao koristiti za slanje lažnih vijesti na društvene mreže.

U svibnju 2020. OpenAI je najavio GPT-3 (Generative Pretrained Transformer 3), model koji sadrži dva reda veličine više parametara od GPT-2 (175 milijardi naspram 1.5 milijardi parametara) i koji nudi dramatično poboljšanje u odnosu na GPT-2.

S obzirom na bilo koji tekstualni upit, GPT-3 će vratiti dovršetak teksta, pokušavajući odgovarati uzorku koji ste mu dali. Možete ga "programirati" tako da mu pokažete samo nekoliko primjera onoga što želite da radi, a isporučit će cijeli članak ili priču, kao što je tekst ispod, koji je u potpunosti napisao GPT-3.

GPT-3 postiže snažne performanse na mnogim NLP skupovima podataka, uključujući prevođenje, odgovaranje na pitanja i zatvaranje zadataka, kao i nekoliko zadataka koji zahtijevaju razmišljanje u hodu ili prilagodbu domene, kao što je dešifriranje riječi, korištenje nove riječi u rečenicu ili izvođenje troznamenkaste aritmetike. GPT-3 može generirati uzorke novinskih članaka koje ljudski evaluatori teško razlikuju od članaka koje su napisali ljudi.

Posljednja aplikacija uvijek je zabrinjavala OpenAI. GPT-3 je trenutno dostupan kao otvorena beta verzija, a očekuje se da će na kraju biti dostupna plaćena privatna beta verzija. OpenAI je rekao da će ukinuti pristup API-ju za očito štetne slučajeve upotrebe, kao što su uznemiravanje, neželjena pošta, radikalizacija ili astroturfing.

Dok su najočitije ugrožena populacija oni koji proizvode pisane radove, kao što su scenaristi, programeri umjetne inteligencije već su pronašli iznenađujuće aplikacije, kao što je korištenje GPT-3 za pisanje koda.

Sharif Shameem je, na primjer, napisao layout generator gdje u običnom tekstu opišete što želite, a model generira odgovarajući kod.

Ovo je pametno.

S GPT-3 izradio sam generator izgleda u kojem samo opisujete bilo koji izgled koji želite i on generira JSX kôd za vas.

ŠTO pic.twitter.com/w8JkrZO4lk

- Sharif Shameem (@sharifshameem) Srpanj 13, 2020

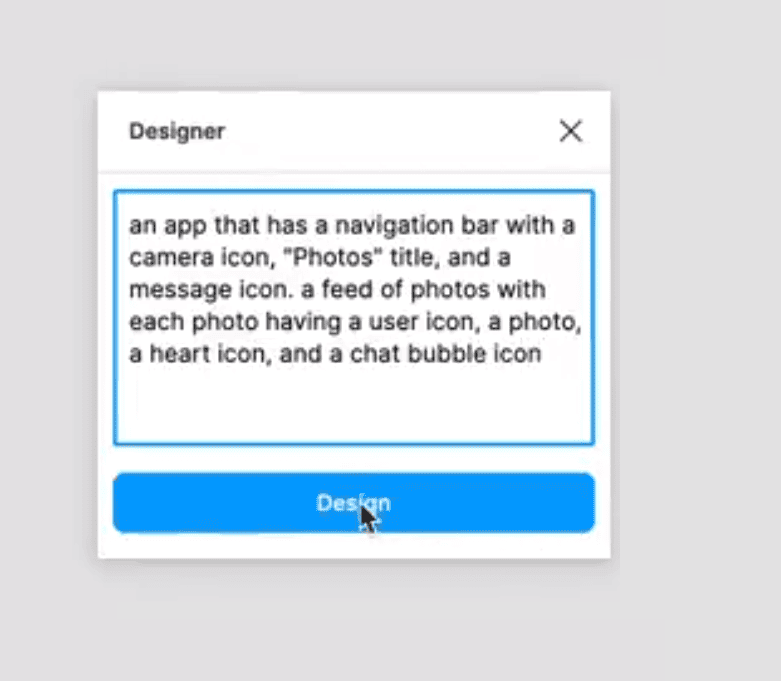

Jordan Singer je na sličan način stvorio dodatak Figma koji omogućuje stvaranje aplikacija koristeći običan tekstualni opis.

Ovo mijenja sve. ?

Uz GPT-3, napravio sam dodatak Figma koji sam dizajnirao za vas.

Ja to zovem "dizajner" pic.twitter.com/OzW1sKNLEC

— jordanska pjevačica (@jsngr) Srpanj 18, 2020

Može se čak koristiti za dijagnosticiranje astme i prepisivanje lijekova.

So @OpenAI dali su mi rani pristup alatu koji programerima omogućuje korištenje onoga što je u biti najmoćniji generator teksta ikada. Mislio sam to testirati postavljanjem medicinskog pitanja. Podebljani tekst je tekst koji generira AI. Nevjerojatno… (1/2) pic.twitter.com/4bGfpI09CL

— Qasim Munye (@qasimmunye) Srpanj 2, 2020

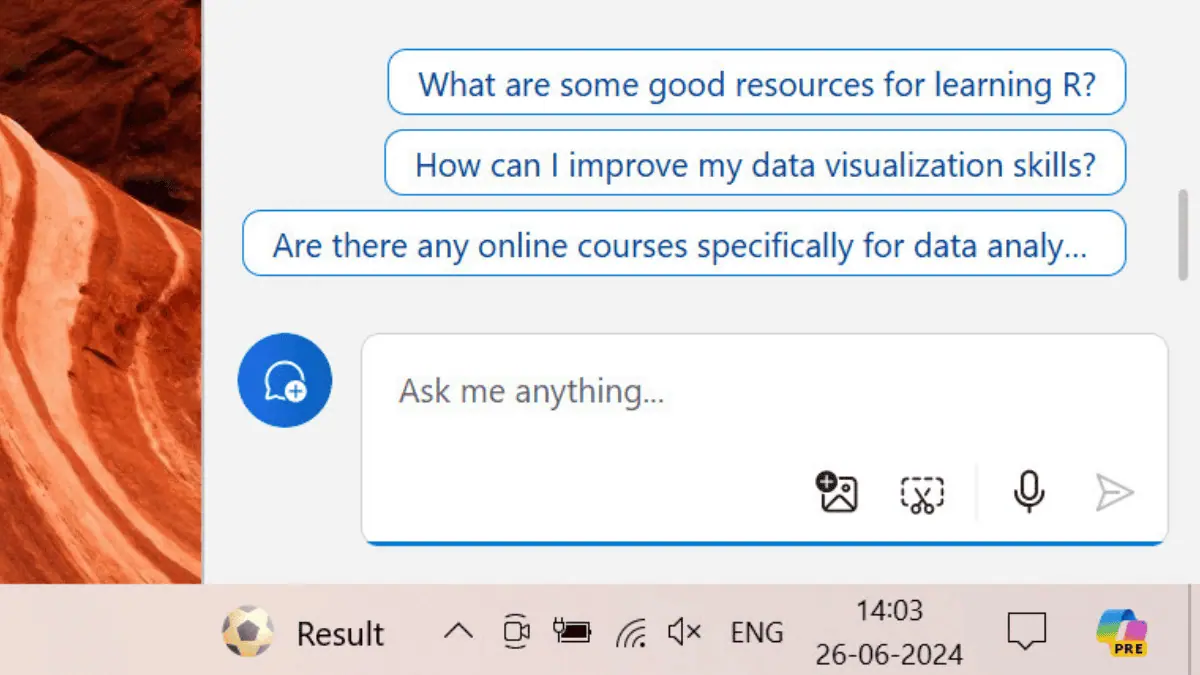

Druge aplikacije su kao tražilica ili neka vrsta proročišta, a mogu se čak koristiti za objašnjenje i proširenje teških koncepata.

Napravio sam potpuno funkcionalnu tražilicu na vrhu GPT3.

Za bilo koji proizvoljni upit, vraća točan odgovor I odgovarajući URL.

Pogledajte cijeli video. Nevjerojatno je dobar.

cc: @gdb @npew @gwern pic.twitter.com/9ismj62w6l

— Paras Chopra (@paraschopra) Srpanj 19, 2020

Iako se čini da bi ovaj pristup mogao izravno dovesti do opće umjetne inteligencije koja može razumjeti, razmišljati i razgovarati poput čovjeka, OpenAI upozorava da su možda naišli na temeljne probleme s povećanjem, s GPT-3 koji zahtijeva nekoliko tisuća petaflop/s-dana računanja , u usporedbi s desecima petaflop/s-dana za puni GPT-2. Čini se, dok smo bliže, iskorak koji će sve naše poslove učiniti zastarjelim još uvijek daleko.

Pročitajte više o GPT-3 na GitHubu ovdje.