La nouvelle IA autonome LINGO-2 de Wayve peut interagir avec les passagers et prendre les commandes

2 minute. lis

Publié le

Lisez notre page de divulgation pour savoir comment vous pouvez aider MSPoweruser à soutenir l'équipe éditoriale En savoir plus

Notes clés

- Le LINGO-2 de Wayve est le premier modèle de voiture autonome capable de naviguer et d'expliquer ses actions en temps réel.

- Ce modèle vision-langage-action (VLAM) utilise des caméras et un traitement du langage pour comprendre son environnement.

- Les passagers peuvent interagir avec LINGO-2 en posant des questions ou en fournissant des instructions simples.

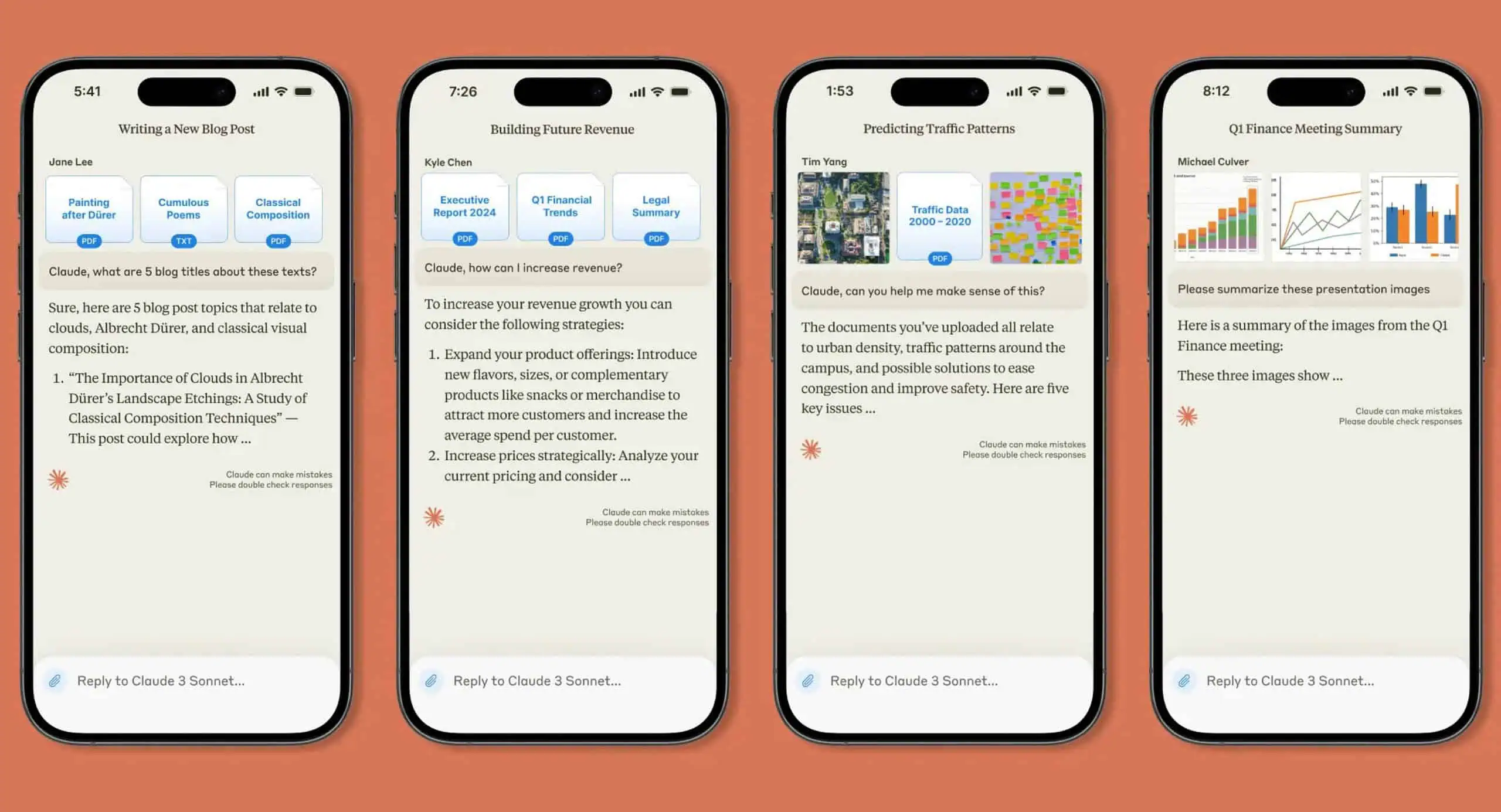

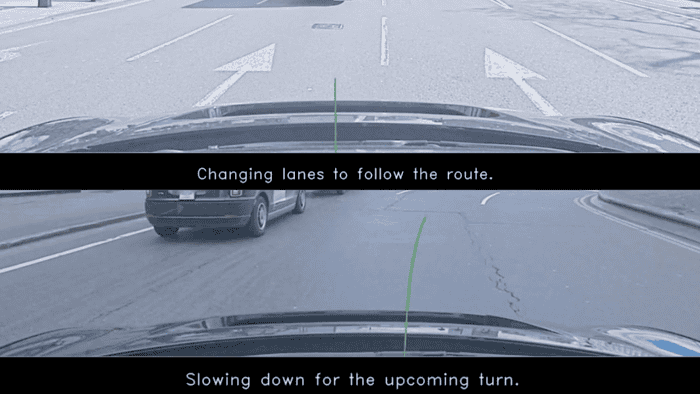

Wayve a dévoilé LINGO-2, un nouveau modèle vision-langage-action (VLAM) conçu pour être utilisé sur la voie publique. LINGO-2 intègre la perception visuelle, le traitement du langage et des capacités de prise de décision en temps réel pour naviguer dans son environnement. LINGO-2 agit comme le cerveau d’une voiture autonome. Il utilise des caméras pour percevoir son environnement (vision), puis utilise le traitement du langage pour comprendre la scène.

Contrairement à ses prédécesseurs, LINGO-2 a de quoi fournir des explications en temps réel sur ses actions tout en contrôlant les mouvements du véhicule.

«LINGO-2 navigue autour d'un bus. Nous pouvons observer que LINGO-2 peut suivre les instructions soit de se retenir et de « s'arrêter derrière le bus », soit de « accélérer et dépasser le bus ».

Cette fonctionnalité permet au modèle de raconter son processus de prise de décision, augmentant ainsi la confiance dans les véhicules autonomes. Par exemple, LINGO-2 peut élucider les raisons d’actions telles que le ralentissement des piétons, favorisant ainsi une compréhension plus approfondie de leur comportement.

« Nous demandons à LINGO-2 de décrire « Quel temps fait-il ? » Il peut identifier correctement que le temps varie de « très nuageux, il n'y a aucun signe de soleil » à « ensoleillé » en passant par « le temps est clair avec un ciel bleu et des nuages épars ».

De plus, LINGO-2 ouvre des voies d'interaction entre les passagers et le véhicule. Les utilisateurs peuvent être en mesure de donner des instructions simples en langage naturel, comme demander un virage, tandis que les passagers peuvent se renseigner sur les environs de la voiture, y compris l'état des feux de circulation ou les dangers potentiels.

« Quand on demande au modèle : « Quelle est la couleur des feux tricolores ? il répond correctement : « Les feux de circulation sont au vert ».

Malgré ses capacités, Wayve reconnaît certaines limites. L'exactitude des explications et la capacité du modèle à exécuter en toute sécurité des instructions vocales dans divers scénarios réels nécessitent un affinement supplémentaire.

Les débuts de LINGO-2 peuvent constituer une étape importante dans la technologie des véhicules autonomes. Il offre un avenir dans lequel les voitures autonomes pourront fournir des explications claires sur leurs actions. La conduite autonome offre un potentiel de transparence et d’interaction avec les passagers malgré les défis restants.

Plus ici.