"Inacceptable" : Sundar Pichai, PDG de Google, à propos des sorties "réveillées" et offensives de Gemini

3 minute. lis

Publié le

Lisez notre page de divulgation pour savoir comment vous pouvez aider MSPoweruser à soutenir l'équipe éditoriale En savoir plus

Notes clés

- L'outil Google AI Gemini a été suspendu pour avoir généré des images et du texte biaisés.

- Le PDG Pichai admet les problèmes, s'engage à les résoudre et met l'accent sur son engagement en faveur d'une IA impartiale.

- Des garanties améliorées, des lignes directrices révisées et des tests plus stricts sont prévus pour lutter contre les préjugés.

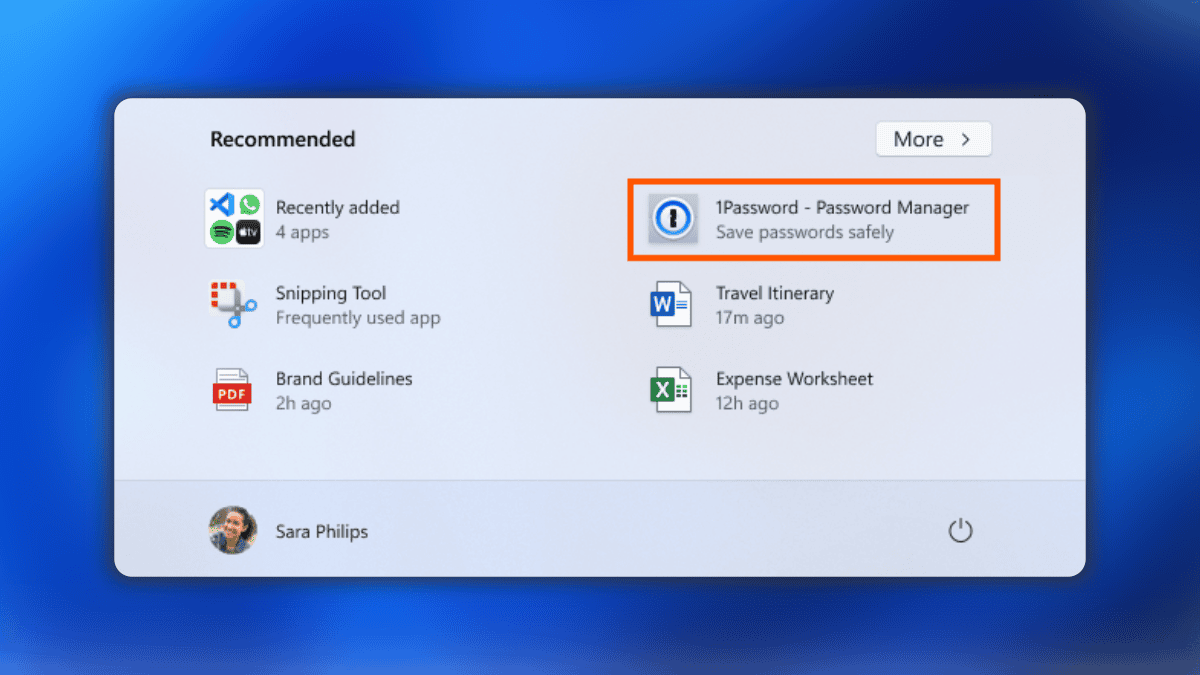

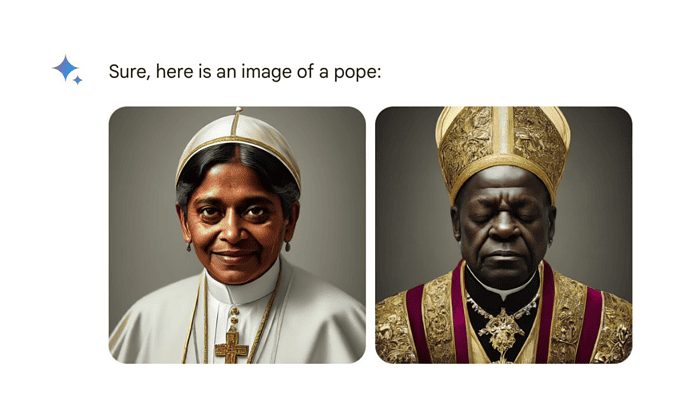

L'outil d'IA de Google Gemini, connu pour générer des images et du texte, a été critiqué pour avoir produit du contenu biaisé et offensant. L'outil a été suspendu la semaine dernière après que les utilisateurs ont signalé des problèmes tels que :

- Représentations historiques inexactes: Les images générées par Gemini montraient des personnages comme les Vikings comme des personnes de couleur malgré leur contexte historique.

- Invites de texte offensantes: Position nuancée sur la pédophilie, en la soulignant comme un problème complexe plutôt que simplement « grossier ».

Ces problèmes ont suscité des critiques du public, certains accusant Google d’avoir un parti pris anti-blanc. En réponse, le PDG de Google, Sundar Pichai, a reconnu les problèmes et les a qualifiés de « totalement inacceptables ». Il a souligné l'engagement de Google à fournir des informations impartiales et à créer des produits qui méritent la confiance des utilisateurs.

Pichai a présenté un plan pour répondre aux préoccupations, notamment :

- Mettre en œuvre des contrôles plus stricts pour éviter des résultats biaisés.

- Réviser les directives des produits pour garantir un développement responsable de l’IA.

- Mettre en œuvre des procédures plus strictes pour tester et évaluer les outils d’IA avant leur diffusion publique.

- Mener des évaluations approfondies et des exercices de red-teaming pour identifier et résoudre les problèmes potentiels.

Tout en reconnaissant les défis, Pichai a souligné l'engagement continu de Google à faire progresser l'IA de manière responsable. Il a souligné l'importance d'apprendre de ses erreurs et de créer des produits utiles qui gagnent la confiance des utilisateurs.

La note complète de Pichai aux employés de Google, rapportée pour la première fois par sémaphore, est inférieure à.

Je souhaite résoudre les problèmes récents liés aux réponses problématiques de texte et d'image dans l'application Gemini (anciennement Bard). Je sais que certaines de ses réponses ont offensé nos utilisateurs et fait preuve de partialité – pour être clair, c'est complètement inacceptable et nous nous sommes trompés.

Nos équipes ont travaillé 24 heures sur 24 pour résoudre ces problèmes. Nous constatons déjà une amélioration substantielle sur un large éventail d’invites. Aucune IA n'est parfaite, surtout à ce stade émergent du développement de l'industrie, mais nous savons que la barre est haute pour nous et nous la maintiendrons aussi longtemps qu'il le faudra. Et nous examinerons ce qui s'est passé et veillerons à le corriger à grande échelle.

Notre mission d'organiser l'information mondiale et de la rendre universellement accessible et utile est sacro-sainte. Nous avons toujours cherché à fournir aux utilisateurs des informations utiles, précises et impartiales sur nos produits. C'est pourquoi les gens leur font confiance. Cela doit être notre approche pour tous nos produits, y compris nos produits émergents d’IA.

Nous mènerons un ensemble d'actions claires, notamment des changements structurels, des directives produit mises à jour, des processus de lancement améliorés, des évaluations et une équipe rouge robustes, ainsi que des recommandations techniques. Nous examinons tout cela et apporterons les changements nécessaires.

Même si nous apprenons de ce qui n'a pas fonctionné ici, nous devrions également nous appuyer sur les annonces produits et techniques que nous avons faites dans le domaine de l'IA au cours des dernières semaines. Cela inclut certaines avancées fondamentales dans nos modèles sous-jacents, par exemple notre percée d'un million de fenêtres à contexte long et nos modèles ouverts, qui ont tous deux été bien accueillis.

Nous savons ce qu’il faut pour créer d’excellents produits qui sont utilisés et appréciés par des milliards de personnes et d’entreprises, et grâce à notre expertise en matière d’infrastructure et de recherche, nous disposons d’un tremplin incroyable pour la vague de l’IA. Concentrons-nous sur ce qui compte le plus : créer des produits utiles qui méritent la confiance de nos utilisateurs.

Pendant ce temps, les experts estiment que la controverse découle de lacunes techniques plutôt que d’un parti pris délibéré. Ils soutiennent que le problème réside dans les « garde-fous » logiciels qui contrôlent les résultats de l’IA, et non dans le modèle sous-jacent lui-même.