L'influence de l'IA et des Deepfakes sur la réalité et l'avenir

5 minute. lis

Mis à jour le

Lisez notre page de divulgation pour savoir comment vous pouvez aider MSPoweruser à soutenir l'équipe éditoriale En savoir plus

En partenariat avec ExpressVPN

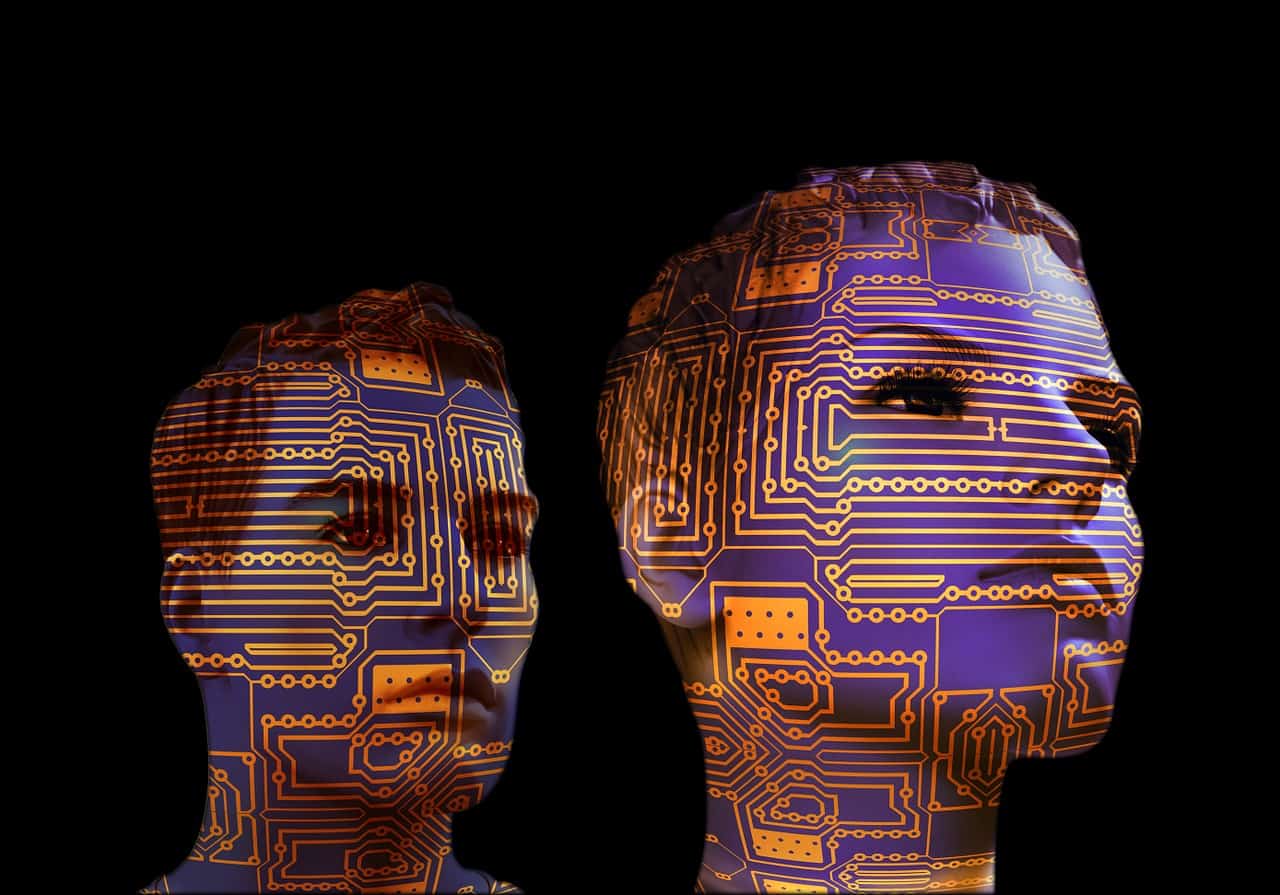

Les progrès récents de l'intelligence artificielle apportent des changements considérables dans la vie des hommes d'aujourd'hui. Aujourd'hui, nous pouvons voir comment l'IA peut effectuer sans effort le codage, la rédaction d'essais et, surtout, la génération de contenu en quelques secondes. Ces mêmes capacités impressionnantes, cependant, sont la propre malédiction de l'IA. Selon Fournisseurs VPN, beaucoup utilisent l'IA pour générer des médias synthétiques pour la désinformation, et les deepfakes commencent maintenant à se répandre comme une traînée de poudre dans le monde entier.

Les experts expérimentent l'IA depuis des décennies, mais la récente grande poussée de Microsoft pour la technologie a suscité l'intérêt de l'industrie à investir davantage dans de telles créations. Juste après le dévoilement de son Bing alimenté par ChatGPT moteur de recherche, Google a riposté en utilisant barde. Contrairement à son concurrent, cependant, Google applique toujours une limite stricte pour l'accès au test Bard, les experts spéculant que cela est dû à la peur de l'entreprise de ce que l'IA peut faire entre de mauvaises mains.

Cela est vrai dans le cas d'autres produits technologiques d'IA en cours de développement. Par exemple, le modèle de langage VALL-E de Microsoft, qui n'est actuellement pas disponible publiquement, peut imiter la voix et les émotions d'une personne pour synthétiser des discours personnalisés. Il ne nécessite qu'un enregistrement de trois secondes comme invite acoustique, mais peut produire un message différent en utilisant la voix de l'orateur d'origine.

Bien que le grand public ne puisse toujours pas accéder aux créations mentionnées ci-dessus, ils ont déjà des homologues proposés par de petites entreprises technologiques. Cela a permis non seulement aux utilisateurs ordinaires, mais aussi aux acteurs malveillants d'utiliser les outils comme ils le souhaitent. Avec cela, il n'est plus surprenant que différents rapports aient fait surface récemment sur des personnes se faisant berner et arnaquer avec l'aide de l'IA.

Ces rapports ont spécifiquement souligné l'utilisation de voix générées par l'IA imitant leurs victimes. Dans une histoire partagée avec Business Insider ce mois-ci, une mère aurait reçu un appel d'une personne prétendant être un kidnappeur demandant une rançon de 50,000 15 $ pour sa fille de 100 ans. Décrivant l'appel reçu, la mère a déclaré qu'il s'agissait « à XNUMX % » de la voix de sa fille.

"C'était complètement sa voix. C'était son inflexion. C'était comme ça qu'elle aurait pleuré. Je n'ai jamais douté une seule seconde que c'était elle », a déclaré la mère, qui a découvert plus tard que l'appel était une tromperie et que sa fille était en fait avec son mari.

Le même incident impliquant la voix de l'IA a été vécu par un couple du Canada, qui a malheureusement perdu 21,000 XNUMX $ à cause d'un escroc au téléphone. Selon Washington Post, l'escroc s'est fait passer pour un avocat et le fils du couple en utilisant une voix générée par l'IA et a déclaré que l'argent serait utilisé pour les frais juridiques après avoir affirmé que le fils avait tué un diplomate dans un accident de voiture.

Outre les voix, d'autres formes de médias génératifs produits par l'IA peuvent également tromper n'importe qui - par exemple, de fausses images et des vidéos deepfake. Bien qu'il n'existe aucun rapport actuel montrant que des escrocs les utilisent à des fins financières, leur effet peut être généralisé pour le grand public. Récemment, certaines images générées par l'IA de personnalités célèbres ont circulé sur le Web. Certaines incluent des photos montrant le pape François dans une doudoune à la mode, l'ancien président Donald Trump arrêté et Elon Musk tenant la main de sa rivale et PDG de GM, Mary Barra, lors d'un rendez-vous. Pendant ce temps, en mars 2022, une vidéo deepfake du président ukrainien Volodymyr Zelensky a fait surface, demandant aux citoyens ukrainiens de se rendre à la Russie.

Bien que les matériaux aient été rapidement identifiés comme faux, leur présence a indéniablement trompé le public et causé une confusion temporaire pour beaucoup. Même modèle et auteur Chrissy Teigen a été victime des images du pape. Pourtant, l'effet de ces supports synthétiques pourrait être plus grave à mesure que l'IA continue de se développer, en particulier en ces temps où de plus en plus d'entreprises technologiques dépensent des milliards de dollars pour façonner la création parfaite de l'IA. Le moment venu, l'IA pourrait être exploitée pour déformer la réalité que tout le monde connaît, ce qui n'est pas impossible. Plus encore, il pourrait même être utilisé pour contrôler et influencer le public, ce qui entraînerait différents problèmes politiques, sociaux et moraux à travers le monde.

Cela est évident dans une vidéo deepfake lors des élections de mi-mandat de 2018 montrant Barack Obama calomniant Donald Trump. Le contenu était initialement destiné à avertir le monde en ligne des dangers des fausses nouvelles sur le Web, mais il a rebondi négativement. Cela a provoqué la colère de plusieurs partisans de Trump et nui involontairement à l'image des individus utilisés dans le matériel.

Maintenant, imaginez l'effet de ces médias génératifs s'ils étaient spécifiquement conçus pour influencer et manipuler l'opinion et promouvoir la propagande auprès du public. Les résultats pourraient être dramatiques. Cela pourrait être particulièrement vrai dans les pays où les médias et l'information sont censurés par des gouvernements restrictifs, tels que la Biélorussie, la Chine, l'Égypte, la Russie, l'Iran, la Corée du Nord, le Turkménistan, les Émirats arabes unis, l'Ouganda, l'Irak, la Turquie, Oman et d'autres pays à prédominance islamique. . Certains ont recours à des VPN pour accéder à du contenu, des sites Web et des services géographiquement verrouillés afin de rester à jour. Pourtant, l'accès VPN n'est pas entièrement possible dans ces endroits car ils contournent la censure sur Internet et bloquent même les sites Web liés aux services VPN. Avec cela, vous pouvez imaginer l'avenir de ces zones avec un accès limité aux nouvelles internationales et leur gouvernement ayant le pouvoir d'autoriser le contenu en ligne. Ensuite, ajoutez la possibilité d'une IA génératrice de contenu plus parfaite à l'avenir, et le public devrait avoir plus de mal à discerner ce qui est vrai et ce qui ne l'est pas.

Les groupes industriels et les entreprises de technologie de l'IA sont déjà en train de définir des politiques qui guideront l'utilisation des outils d'IA. Le Partenariat sur l'IA, par exemple, fournit des recommandations aux institutions et aux particuliers qui créent des outils de médias synthétiques ou simplement à ceux qui distribuent de tels matériaux. Cependant, les entreprises privées et les organisations à but non lucratif ne sont pas les seules nécessaires ici. Les législateurs doivent également créer un ensemble concret de règles que les constructeurs d'IA et les utilisateurs finaux seront poussés à respecter. Néanmoins, ces futures lois seront-elles suffisamment efficaces pour exploiter la puissance de l'IA et empêcher les gens de l'exploiter ? On devrait bientôt voir ça.