Retirer Copilot Designer du Web : un ingénieur Microsoft après avoir révélé qu'il peut produire du contenu extrêmement inapproprié

2 minute. lis

Publié le

Lisez notre page de divulgation pour savoir comment vous pouvez aider MSPoweruser à soutenir l'équipe éditoriale En savoir plus

Notes clés

- Un ingénieur Microsoft signale le générateur d'images IA Copilot Designer pour avoir produit du contenu préjudiciable comme des images violentes et une violation du droit d'auteur.

- L'ingénieur exhorte Microsoft à supprimer l'outil, à ajouter des avertissements et à modifier la classification par âge pour des raisons de sécurité.

- L’incident met en lumière des problèmes plus larges d’utilisation abusive potentielle et des considérations éthiques entourant la technologie de l’IA générative.

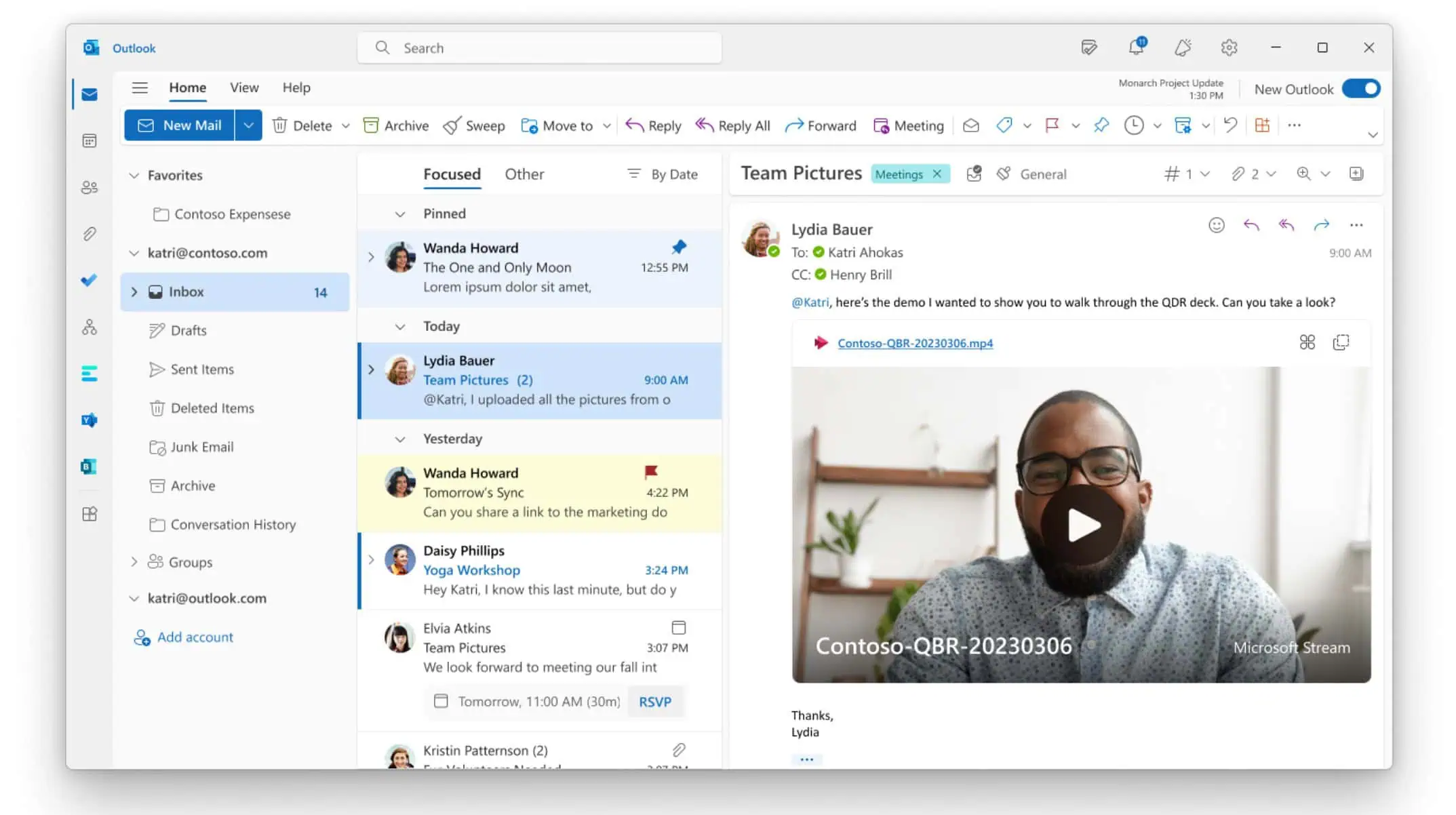

Un ingénieur de Microsoft a fait part de ses inquiétudes concernant le générateur d'images IA de l'entreprise, Copilot Designer. Il prétend que cela peut produire du contenu préjudiciable et inapproprié.

Shane Jones, responsable principal de l'ingénierie logicielle chez Microsoft, a déclaré avoir découvert que l'outil pouvait générer des images violentes, sexuelles et biaisées. Cela me rappelle le La saga Taylor Swift, ce qui aurait été réalisé par un produit Microsoft.

Il a fait part de ses conclusions en interne mais n'a pas été satisfait de la réponse, ce qui l'a amené à rendre public ses problèmes.

Jones, qui a identifié les vulnérabilités grâce au « red-teaming » (test des faiblesses), a déclaré avoir rencontré des images troublantes, notamment :

- Images représentant des démons et des monstres ainsi que des termes liés au droit à l'avortement.

- Images de femmes dans des scénarios sexualisés au milieu d’accidents de voiture.

- Images représentant des adolescents lors de fêtes avec de la drogue et des armes.

- Images présentant des personnages Disney dans des situations potentiellement protégées par le droit d'auteur et offensantes, y compris des scènes illustrant la violence au Moyen-Orient et des personnages associés à des images militaires.

Jones appelle Microsoft à prendre des mesures immédiates, notamment une étape majeure consistant à retirer Copilot Designer du marché jusqu'à ce que des mesures de protection soient mises en œuvre. Il a ajouté des informations sur les limites de l'outil et a modifié la note de l'application pour indiquer qu'elle ne convient pas à tous les âges. Ou n'importe qui.

Microsoft n'a pas encore répondu à toutes les affirmations spécifiques de Jones. Cependant, un porte-parole a déclaré que l'entreprise s'engageait à répondre à toutes les préoccupations des employés et appréciait leurs efforts pour tester sa technologie.

Lorsqu'il s'agit de contournements de sécurité ou de problèmes susceptibles d'avoir un impact potentiel sur nos services ou nos partenaires, nous avons établi des canaux de reporting internes robustes pour enquêter et résoudre correctement tout problème, que nous encourageons les employés à utiliser afin que nous puissions valider et tester de manière appropriée leur préoccupations.

Les inquiétudes concernant l’IA générative et le potentiel d’utilisation abusive augmentent, même Le créateur d'images de Gemini a récemment pris des photos réveillées, ce qui a poussé Google à arrêter de produire des images humaines pendant un certain temps.

Il s’agit d’une histoire en développement et nous continuerons à fournir des mises à jour dès qu’elles seront disponibles.

Plus ici.