La puce Meta MTIA de nouvelle génération pour l'IA est enfin arrivée et elle est plus rapide

Les puces Google Axion ont également été annoncées il y a quelques temps.

2 minute. lis

Publié le

Lisez notre page de divulgation pour savoir comment vous pouvez aider MSPoweruser à soutenir l'équipe éditoriale En savoir plus

Notes clés

- Meta construit une infrastructure axée sur l'IA et annonce maintenant les puces MTIA de nouvelle génération

- MTIA v1, son prédécesseur, améliore l'efficacité des modèles de recommandation.

- Le MTIA de nouvelle génération utilise en réalité plus d’énergie, mais dispose d’une meilleure mémoire et d’une meilleure vitesse.

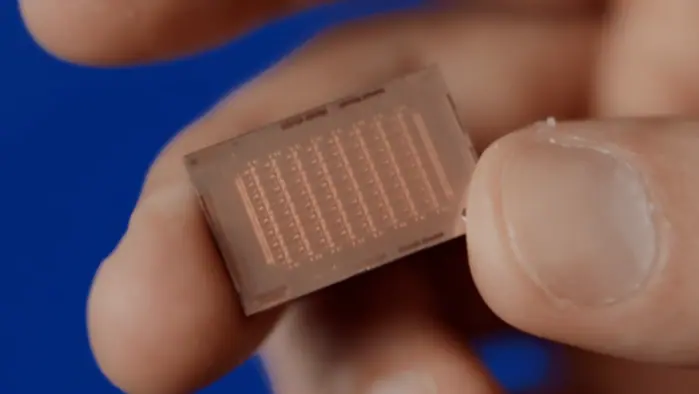

Meta vient de dévoilé récemment ses puces d'IA personnalisées de nouvelle génération, se vantant d'être plus puissantes et bien axées sur l'IA générative : la prochaine puce MTIA.

Meta Training and Inference Accelerator (MTIA) v1 est arrivé pour la première fois l'année dernière en mai. À cette époque, il s’agissait de l’accélérateur d’inférence d’IA de première génération de Meta, conçu pour ses modèles de recommandation d’apprentissage en profondeur. Il a également réorganisé diverses expériences sur les propriétés de Meta comme Facebook et Instagram.

Désormais, Meta promet que la prochaine version de MTIA sera plus rapide que jamais. Selon leurs propres termes, cela « fait plus que doubler la bande passante de calcul et de mémoire de notre solution précédente tout en maintenant notre lien étroit avec nos charges de travail ».

Dans une révélation à TechCrunch, Meta détaille plus en détail à quoi ressemble cette puce. Même s'il consomme plus d'énergie (90 W contre 25 W), le MTIA de nouvelle génération possède de meilleures fonctionnalités comme plus de mémoire (128 Mo contre 64 Mo) et fonctionne plus rapidement (1.35 GHz contre 800 MHz). Il est fabriqué à l’aide d’un processus plus petit de 5 nm, physiquement plus grand et doté de plus de cœurs de traitement.

Meta déclare que les nouvelles puces ont été mises en service dans leurs centres de données, où elles servent activement les modèles en production. Ils rapportent des résultats positifs du programme, soulignant que les puces sont capables de gérer des modèles de classement et de recommandation simples et complexes.

Meta affirme que leurs puces sont plus efficaces que les GPU disponibles dans le commerce car elles contrôlent l'ensemble du système.

Il y a peu, Google a également annoncé Axion de Google Puce AI, sa première incursion sur le marché des puces dédiées aux modèles en cours d'exécution. Le nouveau d'Intel Puce IA Gaudi 3 affirme également qu'il est 50 % plus rapide que le Nvidia H100.