Fraîchement débarqué après Gemini 1.5, Google lance le nouveau modèle d'IA Gemma

Il est construit à partir de la même technologie que celle utilisée pour les modèles Gemini.

2 minute. lis

Publié le

Lisez notre page de divulgation pour savoir comment vous pouvez aider MSPoweruser à soutenir l'équipe éditoriale En savoir plus

Notes clés

- Google a annoncé Gemma, un autre modèle construit à partir de la même technologie que celle utilisée pour les modèles Gemini.

- Il s'agit d'un modèle léger spécialement conçu pour aider les développeurs et les chercheurs à créer une IA responsable.

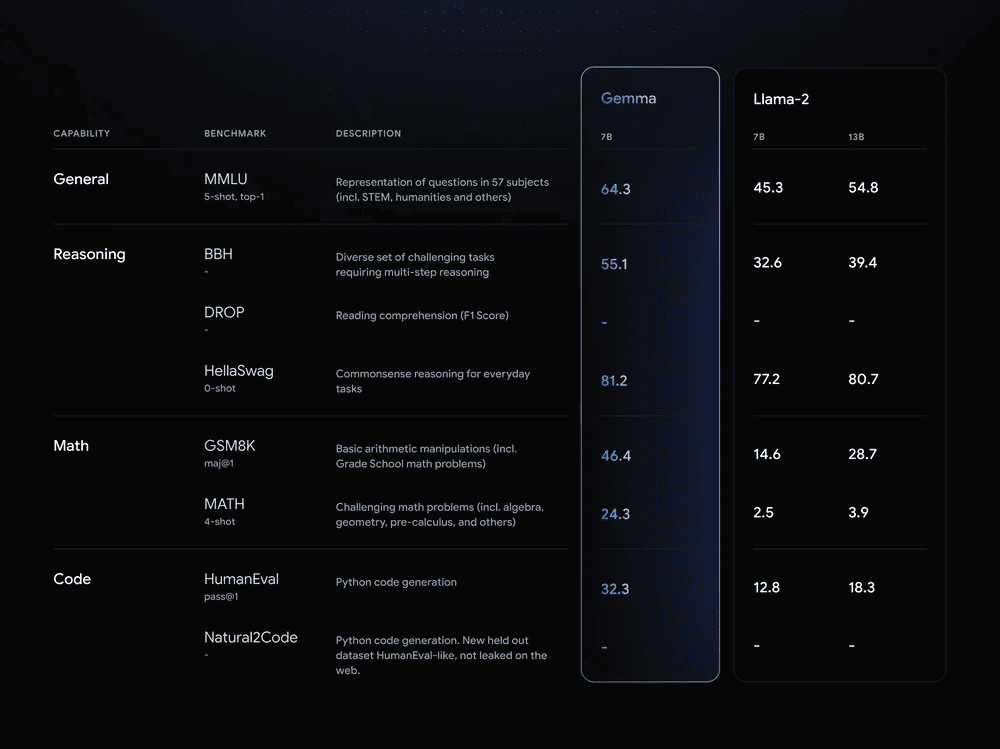

- Gemma AI se décline en deux modèles : Gemma 2B et Gemma 7B.

Google a quelques mois assez chargés pour rattraper Microsoft dans la course à l'IA. Peu de temps après lancer les Gémeaux et de Gemini 1.5, son modèle d'IA le plus performant à ce jour, la société annonça Gemma, un autre modèle construit à partir de la même technologie utilisée pour les modèles Gemini.

"Développé par Google DeepMind et d'autres équipes de Google, Gemma s'inspire de Gemini et son nom reflète le latin. gemme, signifiant « pierre précieuse », déclare Google dans l'annonce officielle, juste après annonce de Gemini 1.5 ça pourrait être 20 fois plus rapide que GPT-4.

Gemma AI de Google se décline en deux modèles : Gemma 2B et Gemma 7B. Ceux-ci diffèrent par leur taille et leurs capacités. Les deux sont disponibles en deux versions : « pré-entraînés » pour un usage général et « adaptés aux instructions » pour des tâches spécifiques.

Mais quelle est exactement la différence ? Gemma n'est pas n'importe quel modèle d'IA open source. Il s'agit d'un modèle léger spécialement conçu pour aider les développeurs et les chercheurs à créer une IA responsable, guidée par les principes d'IA de Google.

Vous pouvez également créer des applications d'IA plus sûres et plus éthiques à l'aide du kit d'outils d'IA générative responsable de Google, qui s'inscrit également dans ce modèle.

La boîte à outils fournit également des chaînes d'outils pour l'inférence et le réglage fin dans des frameworks populaires tels que JAX, PyTorch et TensorFlow, ainsi que des blocs-notes prêts à l'emploi et des intégrations avec des outils établis tels que Hugging Face et NVIDIA NeMo.