Bing pourrait bientôt avoir la capacité d'utiliser des images, des vidéos et d'autres types de données dans les réponses

3 minute. lis

Publié le

Lisez notre page de divulgation pour savoir comment vous pouvez aider MSPoweruser à soutenir l'équipe éditoriale En savoir plus

La nouveau Bing alimenté par ChatGPT s'améliore continuellement et Microsoft pourrait commencer son plus grand développement la semaine prochaine. Andreas Braun, directeur technique de Microsoft Allemagne, a récemment annoncé que GPT-4 arriverait la semaine prochaine. Parallèlement, l'exécutif a fait allusion à "des modèles multimodaux qui offriront des possibilités complètement différentes".

Microsoft a déjà investi des milliards de dollars dans ses initiatives d'IA, notamment pour améliorer sans relâche Bing afin de mieux concurrencer Google. Maintenant, le géant du logiciel a confirmé l'arrivée de GPT-4 la semaine prochaine, qui devrait être injecté dans son moteur de recherche et son chatbot.

Avant la sortie de ChatGPT Bing, il y avait rumeurs à propos de Bing utilisant GPT-4. Cependant, Microsoft a plutôt utilisé le modèle GPT-3.5 aux côtés de sa technologie propriétaire Prométhée, ce qui permet à Bing de générer des données à jour. Étonnamment, même si le nouveau Bing n'est toujours pas disponible pour tout le monde, la société a déjà prévu de donner un coup de pouce significatif au moteur de recherche via le prochain GPT-4.

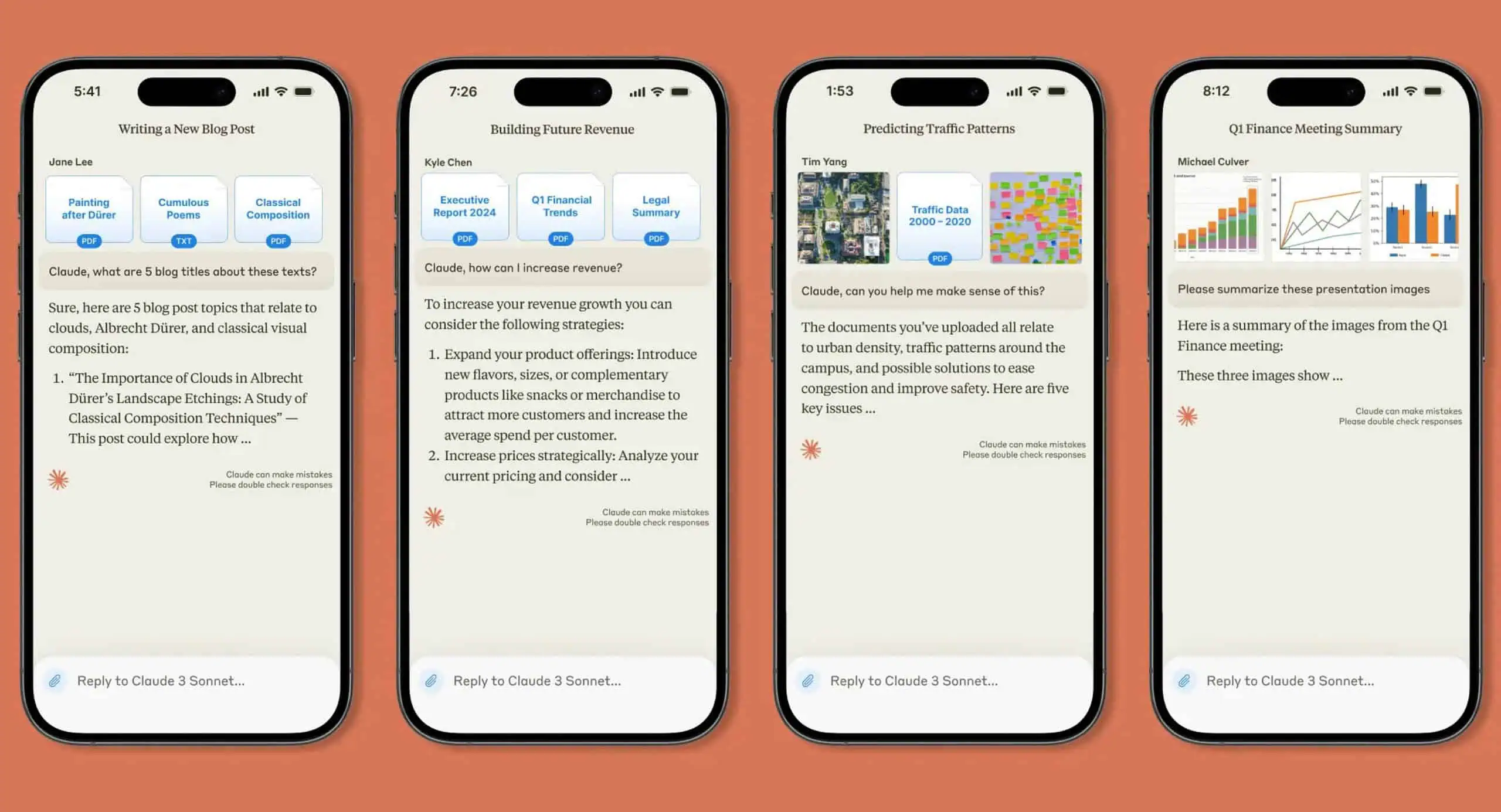

Le nouveau et à venir Large Language Model d'OpenAI devrait permettre au chatbot Bing de générer des résultats plus rapides, ce qui peut être d'une grande aide puisque la version actuelle prend généralement quelques secondes pour commencer à générer des réponses. Néanmoins, mis à part la vitesse, une capacité multimodale pourrait être la plus grande chose que la nouvelle introduction de LLM pourrait apporter.

Lors de l'événement AI in Focus - Digital Kickoff de Microsoft, Braun a partagé quelques détails sur ce à quoi s'attendre de l'entrée d'un nouveau LLM. (via Heise)

"Nous présenterons GPT-4 la semaine prochaine, nous aurons là des modèles multimodaux qui offriront des possibilités complètement différentes - par exemple des vidéos", a déclaré Braun, qui a décrit LLM comme un "changeur de jeu".

De plus, Braun a confirmé que Microsoft prévoyait de "rendre les modèles complets" en utilisant la capacité multimodalité. Une fois injecté, cela devrait permettre à Bing de fournir une variété de données lorsqu'il répond aux questions, ce qui signifie qu'il pourrait également traiter des vidéos, des images et d'autres types de données. Cela devrait se traduire par de meilleures réponses, faisant de Bing un assistant de recherche plus efficace pour tout le monde.

En revanche, il est important de noter que Bing n'est pas le premier dans la multimodalité. Récemment, Vous.com a déployé sa fonction de recherche de chat multimodale, permettant aux utilisateurs de fournir des entrées textuelles et vocales et de recevoir des réponses au-delà des textes conversationnels. Le moteur de recherche, cependant, a encore du mal à attirer l'attention du public. Pendant ce temps, bien qu'il ne soit pas encore entièrement accessible à tous, Bing a déjà une liste d'attente en constante expansion. L'injection d'une capacité multimodale en son sein affectera certainement ses concurrents, comme You.com. Pourtant, il est encore trop tôt pour dire l'ampleur de cet effet puisque l'annonce de Braun ne confirme que très peu de détails.