Le modèle sur appareil d'Apple fonctionne mieux que le modèle de serveur Phi-3-mini de Microsoft, comparable au GPT-4 Turbo

3 minute. lis

Publié le

Lisez notre page de divulgation pour savoir comment vous pouvez aider MSPoweruser à soutenir l'équipe éditoriale Plus d'informations

Notes clés

- La course au développement de modèles d’IA plus efficaces et plus performants conduit finalement à de meilleurs produits, à des expériences utilisateur plus intuitives et à une gamme plus large d’outils basés sur l’IA à notre disposition.

En avril de cette année, Microsoft annoncé Famille Phi-3 de petits modèles de langage (SLM). Le Phi-3-mini avec un modèle de langage de 3.8 milliards de paramètres est formé sur 3.3 billions de jetons et bat Mixtral 8x7B et GPT-3.5. Microsoft a récemment annoncé PC Copilot+ qui utilisent de grands modèles de langage (LLM) exécutés dans Azure Cloud de concert avec plusieurs petits modèles de langage (SLM) de classe mondiale de Microsoft pour débloquer un nouvel ensemble d'expériences d'IA que vous pouvez exécuter localement, directement sur l'appareil.

Lors de la WWDC 2024, Apple a annoncé Apple Intelligence (son alternative Copilot) pour ses appareils. Apple Intelligence s'appuie sur plusieurs modèles génératifs hautement performants. Semblable à l'approche de Microsoft, Apple utilise à la fois des modèles sur appareil et des modèles basés sur serveur. Hier, Apple détaillé deux des modèles de base qu’il utilise pour alimenter Apple Intelligence.

- Le modèle Apple On-Device est un SLM à 3 milliards de paramètres

- Apple Server est un LLM hébergé sur le propre Cloud Compute d'Apple et exécuté sur des serveurs Apple Silicon.

Détails techniques:

- Les modèles de base d'Apple sont formés sur Le framework AXLearn d'Apple.

- Apple a formé les modèles avec une efficacité et une évolutivité élevées sur divers matériels de formation et plates-formes cloud, notamment les TPU et les GPU cloud et sur site.

- Apple a formé ses modèles de base sur des données sous licence, y compris des données sélectionnées pour améliorer des fonctionnalités spécifiques, ainsi que des données accessibles au public collectées par notre robot d'exploration Web, AppleBot.

- Le modèle sur appareil utilise une taille de vocabulaire de 49 Ko, tandis que le modèle de serveur utilise une taille de vocabulaire de 100 Ko, qui inclut des jetons de langage et techniques supplémentaires.

- Sur l’iPhone 15 Pro, Apple a pu atteindre une latence d’environ 0.6 milliseconde par jeton d’invite et un taux de génération de 30 jetons par seconde.

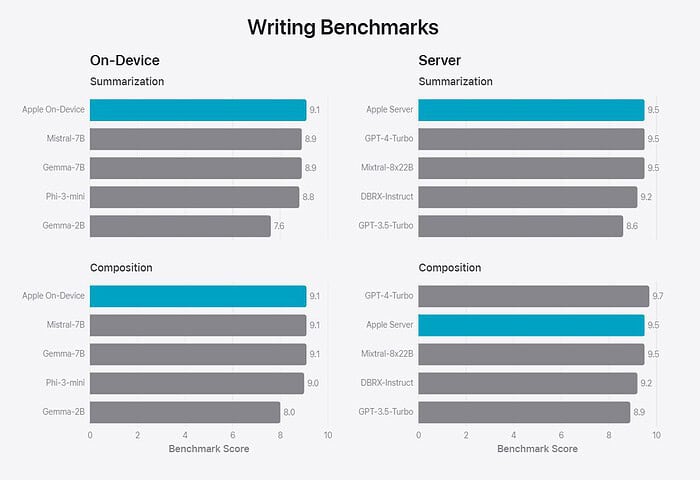

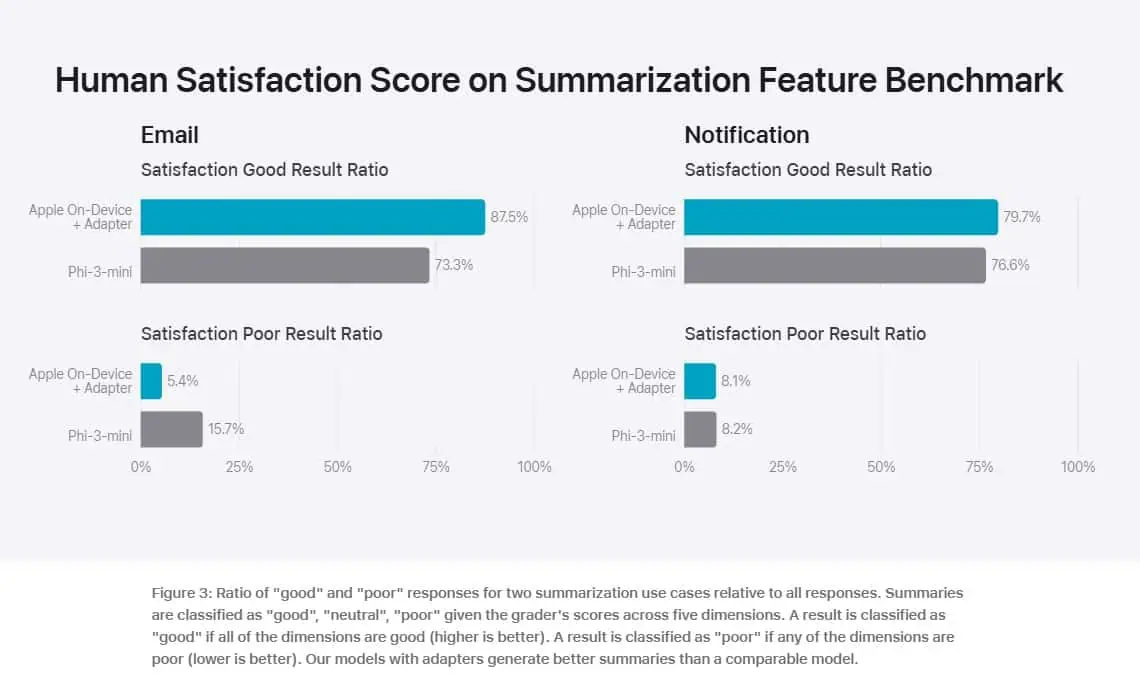

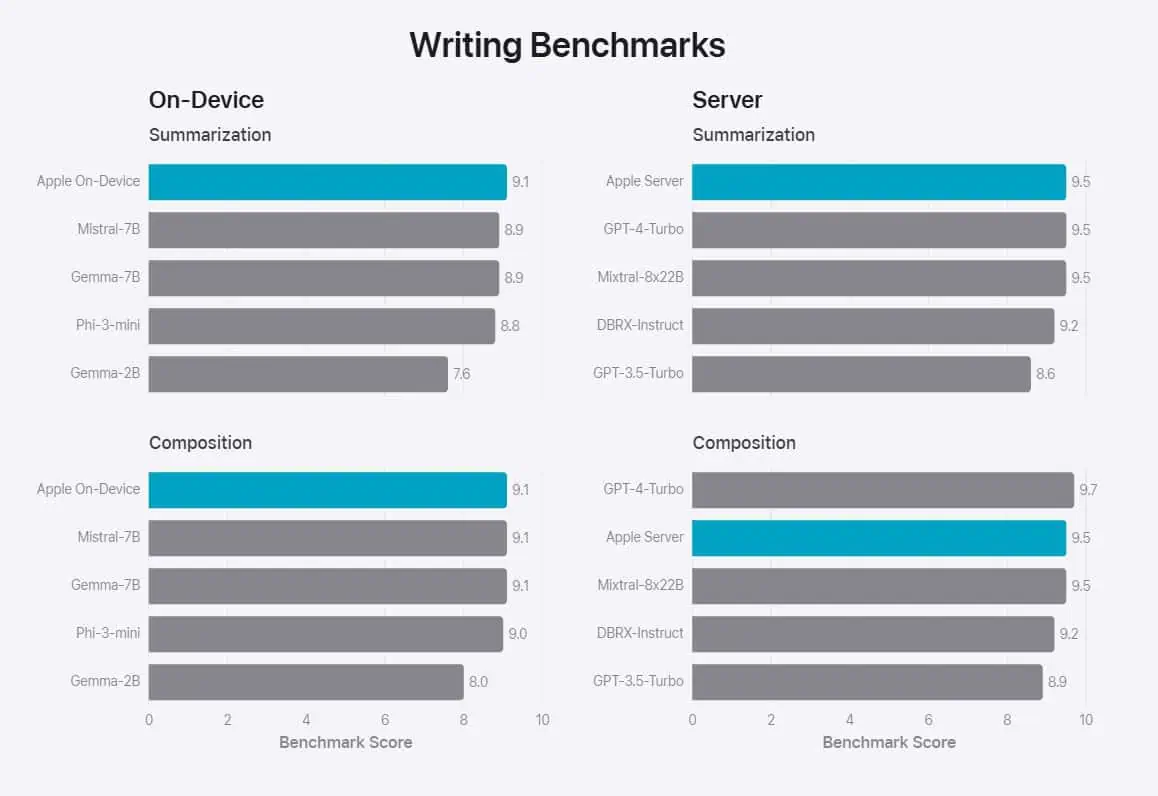

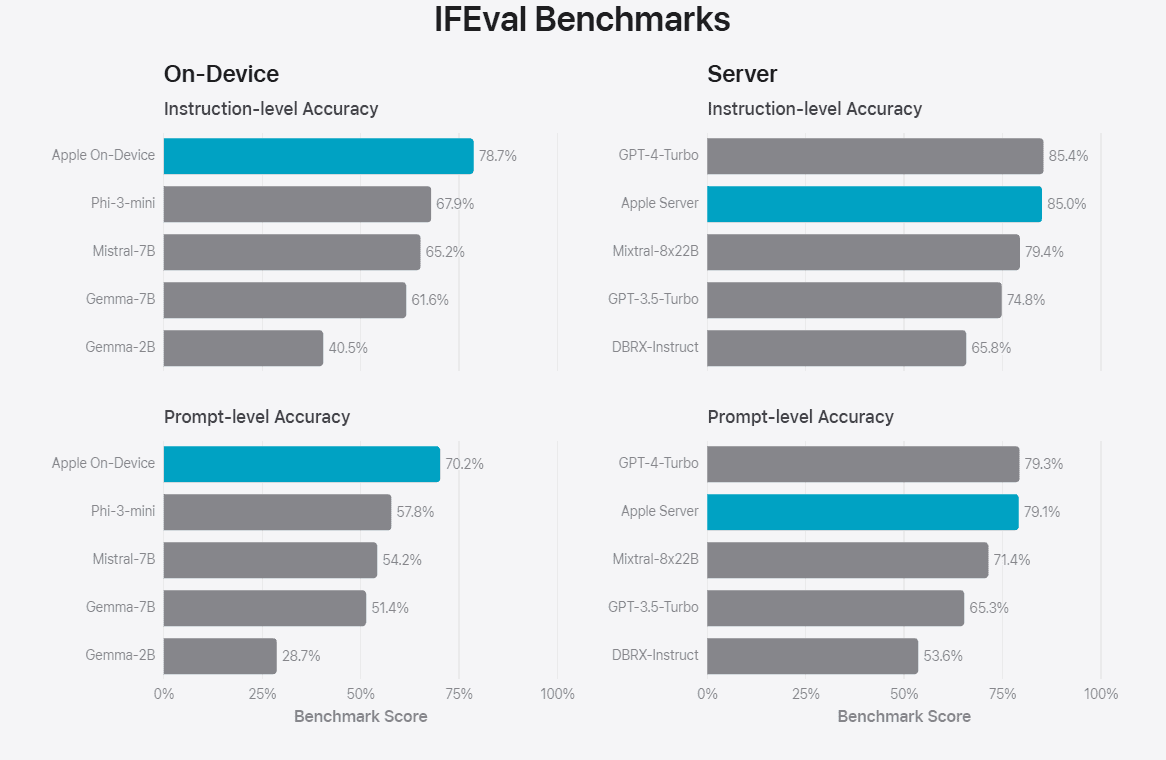

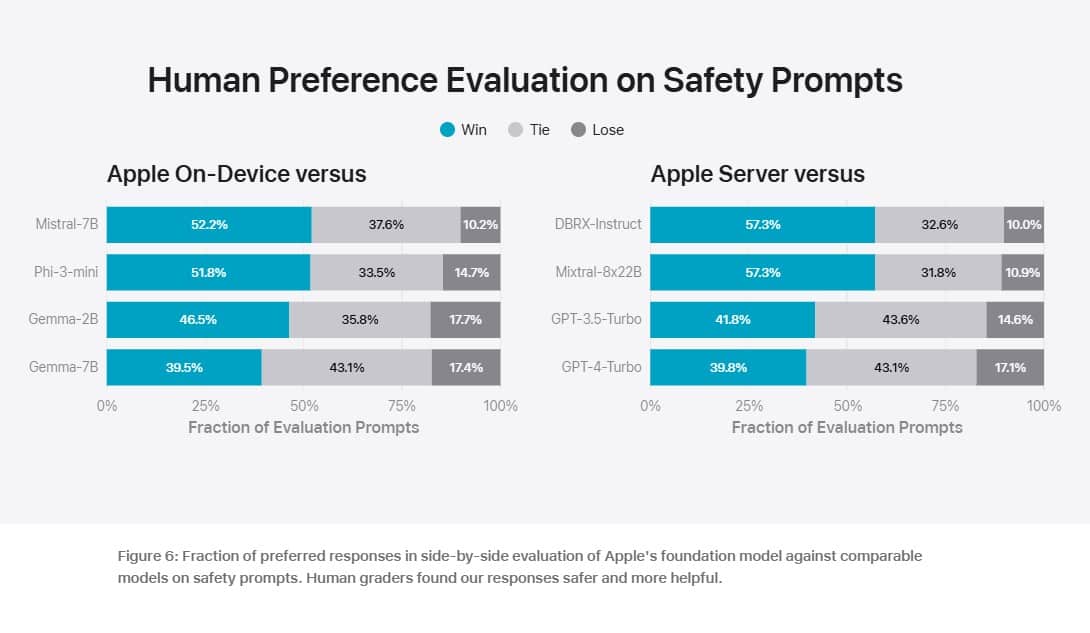

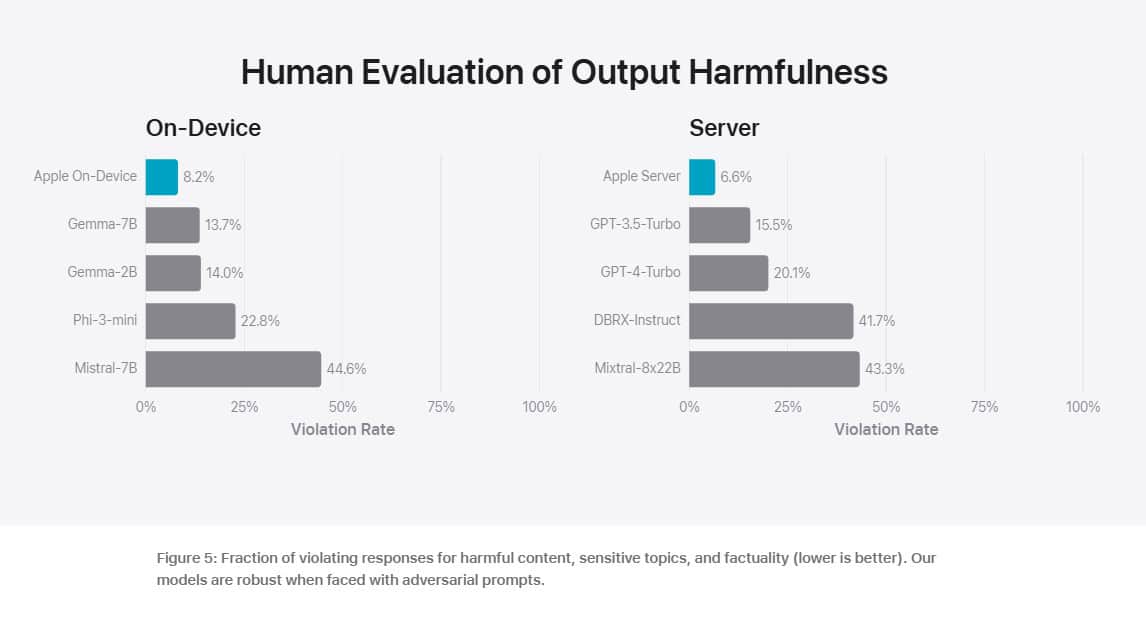

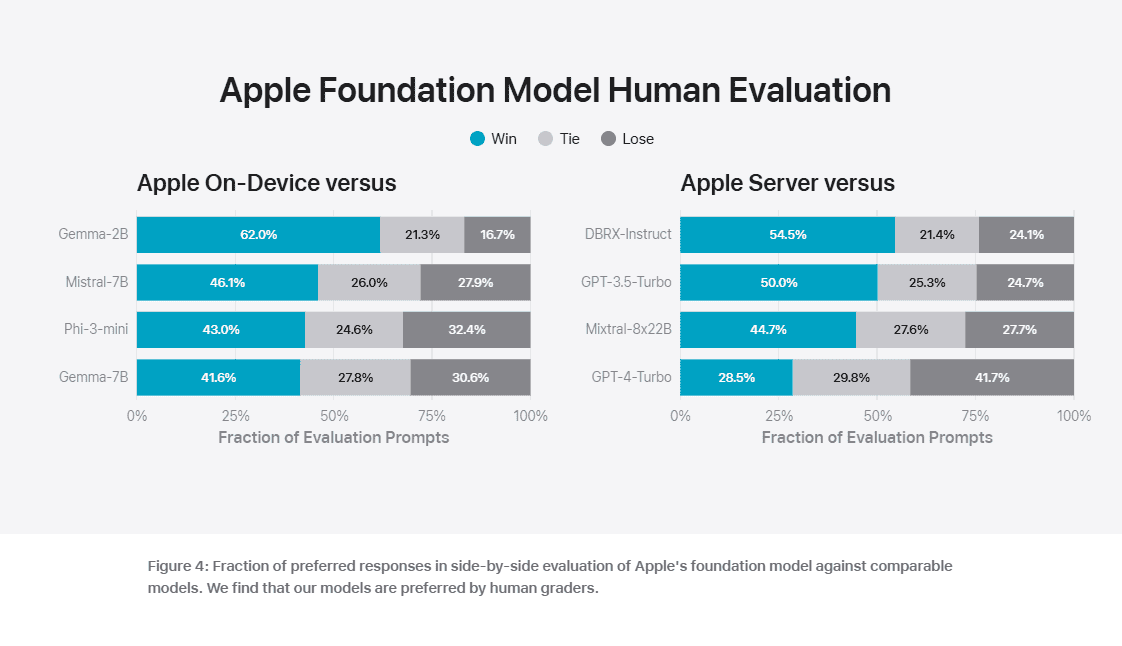

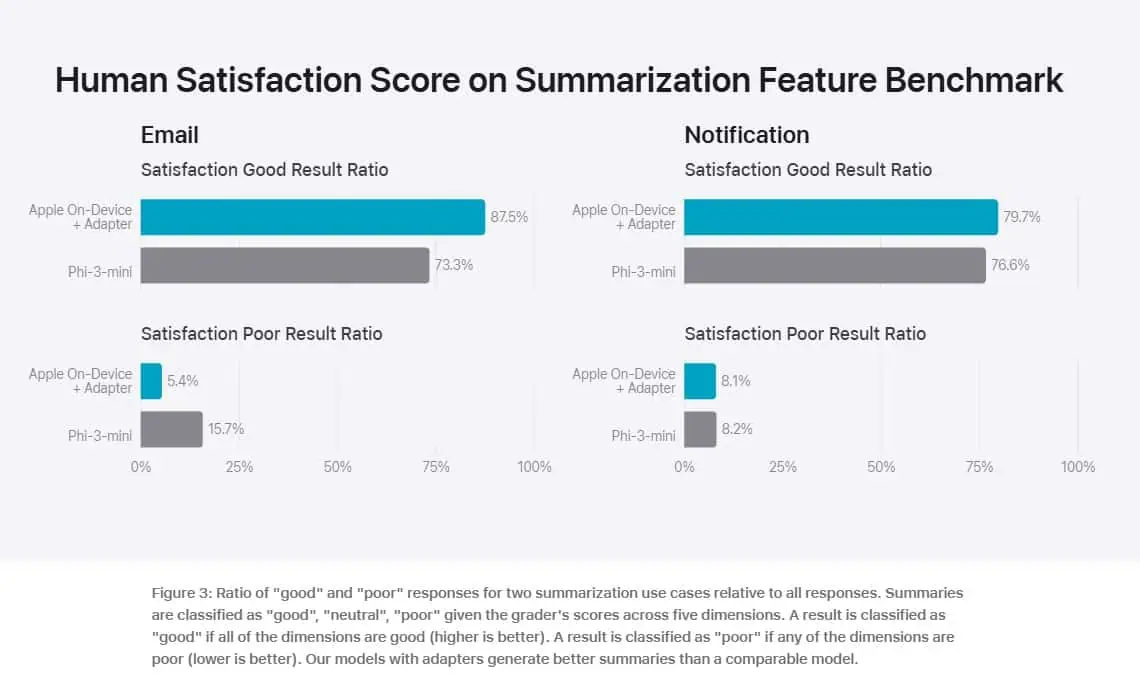

Pour évaluer les performances de ces modèles, Apple les a comparés à la fois à des modèles open source (Phi-3, Gemma, Mistral, DBRX) et à des modèles commerciaux de taille comparable (GPT-3.5-Turbo, GPT-4-Turbo). Apple affirme que ses modèles ont été préférés par les évaluateurs humains à la plupart des modèles concurrents comparables. Par exemple, le modèle Apple sur appareil avec les paramètres 3B surpasse les modèles tels que Phi-3-mini, Mistral-7B et Gemma-7B. Et le modèle de serveur Apple se compare favorablement à DBRX-Instruct, Mixtral-8x22B et GPT-3.5-Turbo tout en étant très efficace.

Vous pouvez consulter les résultats de l'évaluation d'Apple ci-dessous.

L'utilisation stratégique par Apple de modèles à la fois sur appareil et sur serveur reflète l'approche de Microsoft, indiquant une tendance vers des solutions d'IA hybrides qui équilibrent puissance et efficacité. Les performances impressionnantes des modèles Apple, en particulier leur vitesse et leur préférence parmi les niveleurs humains, soulignent le potentiel de modèles plus petits et plus efficaces pour rivaliser avec les plus grands dans certaines applications.

Alors que ces deux géants continuent d’innover, l’avenir de l’IA s’annonce de plus en plus prometteur. Les consommateurs peuvent s’attendre à voir des expériences d’IA plus puissantes et personnalisées intégrées à leurs appareils et flux de travail. Qu'il s'agisse du Copilot+ de Microsoft ou d'Apple Intelligence d'Apple, la convergence de l'IA et de la technologie quotidienne est appelée à redéfinir la façon dont nous interagissons avec le monde numérique.

Forum des utilisateurs

Messages 0