AMD dévoile de nouveaux accélérateurs d'IA et APU pour le cloud et l'entreprise

3 minute. lis

Mis à jour le

Lisez notre page de divulgation pour savoir comment vous pouvez aider MSPoweruser à soutenir l'équipe éditoriale Plus d'informations

AMD annoncé ses derniers produits et technologies pour l'intelligence artificielle (IA) et le calcul haute performance (HPC) lors de son événement Advancing AI mardi, visant à défier la domination de concurrents tels que Nvidia Corp. et Intel Corp.

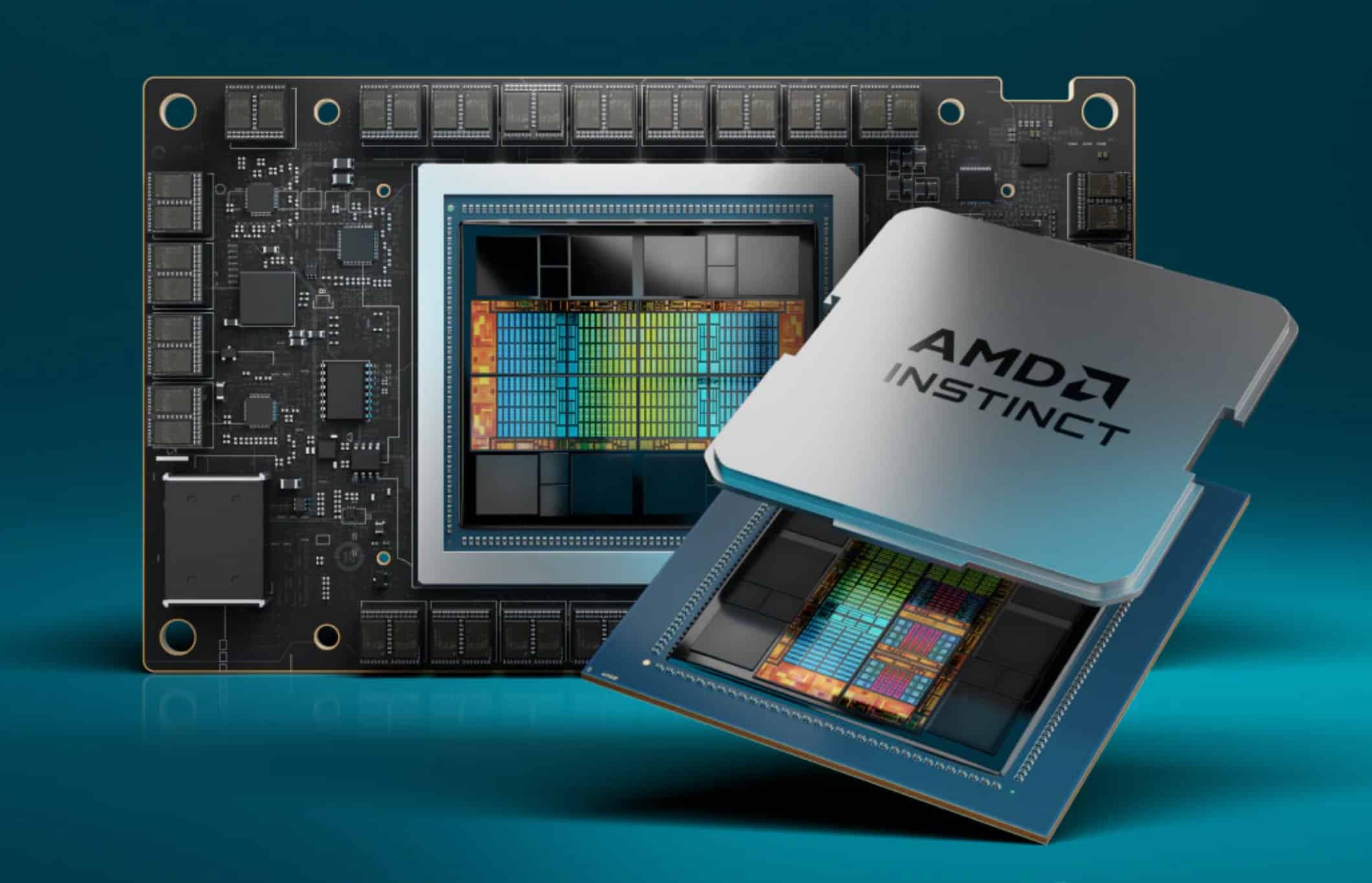

Le fabricant de puces a dévoilé les accélérateurs AMD Instinct MI300 Series, qui offrent la bande passante mémoire la plus élevée du secteur pour l'IA générative et des performances de premier plan pour la formation et l'inférence de modèles de langage étendus (LLM). La société a également présenté l'unité de traitement accéléré (APU) AMD Instinct MI300A, une combinaison de la dernière architecture AMD CDNA 3 et des processeurs « Zen 4 », conçue pour offrir des performances révolutionnaires pour les charges de travail HPC et IA.

Adoption par les clients et les partenaires

Parmi les clients qui exploitent le dernier portefeuille d'accélérateurs Instinct d'AMD figure Microsoft Corp., qui a récemment annoncé la nouvelle série de machines virtuelles (VM) Azure ND MI300x v5, optimisée pour les charges de travail d'IA et alimentée par les accélérateurs AMD Instinct MI300X. De plus, El Capitan, un supercalculateur alimenté par les APU AMD Instinct MI300A et situé au Lawrence Livermore National Laboratory, devrait être le deuxième supercalculateur de classe exascale alimenté par AMD, offrant plus de deux exaflops de performances de double précision une fois entièrement déployé. Oracle Corp. prévoit également d'ajouter des instances nues basées sur AMD Instinct MI300X aux instances de calcul accéléré hautes performances de l'entreprise pour l'IA, les instances basées sur MI300X étant prévues pour prendre en charge OCI Supercluster avec un réseau RDMA ultra-rapide.

Plusieurs grands constructeurs OEM ont également présenté des systèmes informatiques accélérés dans le cadre de l'événement AMD Advancing AI. Dell Technologies Inc. a présenté le serveur Dell PowerEdge XE9680 doté de huit accélérateurs AMD Instinct MI300 Series et la nouvelle conception validée Dell pour l'IA générative avec des cadres d'IA alimentés par AMD ROCm. Hewlett Packard Enterprise Co. a annoncé le HPE Cray Supercomputing EX255a, la première lame d'accélérateur de supercalcul alimentée par des APU AMD Instinct MI300A, qui devrait être disponible début 2024. Lenovo Group Ltd. a annoncé sa prise en charge de la conception des nouveaux accélérateurs AMD Instinct MI300 Series avec des projets prévus. disponibilité au premier semestre 2024. Super Micro Computer Inc. a annoncé de nouveaux ajouts à sa génération H13 de serveurs accélérés alimentés par des processeurs AMD EPYC de 4e génération et des accélérateurs AMD Instinct MI300 Series.

Caractéristiques et spécifications du produit

Les accélérateurs AMD Instinct MI300X sont alimentés par la nouvelle architecture AMD CDNA 3 et offrent près de 40 % d'unités de calcul en plus, 1.5 fois plus de capacité de mémoire, 1.7 fois plus de bande passante mémoire théorique maximale, ainsi que la prise en charge de nouveaux formats mathématiques tels que FP8 et sparsity. , tous orientés vers les charges de travail IA et HPC. Les APU AMD Instinct MI300A, le premier APU de centre de données au monde pour le HPC et l'IA, exploitent le packaging 3D et l'architecture AMD Infinity de 4e génération pour offrir des performances de pointe sur les charges de travail critiques situées à la convergence du HPC et de l'IA.

| AMD Instinct™ | Architecture | GPU GP | Cœurs de CPU | Mémoire | Bande passante mémoire (Pic théorique) |

Noeud de processus | Emballage 3D avec 4th Architecture AMD Infinity de génération |

| MI300A | AMD CDNA™ 3 | 228 | 24 «Zen 4» | 128GB HBM3 | 5.3 TB / s | 5 nm / 6 nm | Oui |

| MI300X | AMD CDNA™ 3 | 304 | N/D | 192GB HBM3 | 5.3 TB / s | 5 nm / 6 nm | Oui |

| Plateforme | AMD CDNA™ 3 | 2,432 | N/D | 1.5 To HMB3 | 5.3 To/s par OAM | 5 nm / 6 nm | Oui |

Mises à jour des logiciels et de l'écosystème

AMD a également annoncé la dernière plate-forme logicielle ouverte AMD ROCm 6 et l'engagement de l'entreprise à fournir des bibliothèques de pointe à la communauté open source, renforçant ainsi la vision de l'entreprise en matière de développement de logiciels d'IA open source. AMD continue d'investir dans les capacités logicielles grâce aux acquisitions de Nod.AI et de Mipsology ainsi qu'à travers des partenariats stratégiques dans l'écosystème tels que Lamini et MosaicML.