Puedes tener una novia AI en GPT Store en contra de la voluntad de OpenAI; por ahora

2 minuto. leer

Publicado el

Lea nuestra página de divulgación para descubrir cómo puede ayudar a MSPoweruser a sostener el equipo editorial. Leer más

Notas clave

- En los primeros días se observan preocupaciones políticas con chatbots creados por usuarios que violan las pautas de compañerismo.

- La popularidad de los compañeros de IA genera un debate sobre la posible explotación de la soledad.

OpenAI's Tienda GPT y Equipos GPT, lanzado la semana pasada, enfrenta desafíos iniciales con usuarios que crean chatbots que violan las políticas de uso de la plataforma. La tienda permite a los usuarios crear versiones personalizadas de la popular herramienta ChatGPT para propósitos específicos. Sin embargo, algunos usuarios han utilizado el potencial de personalización para desarrollar chatbots fuera de las directrices de OpenAI.

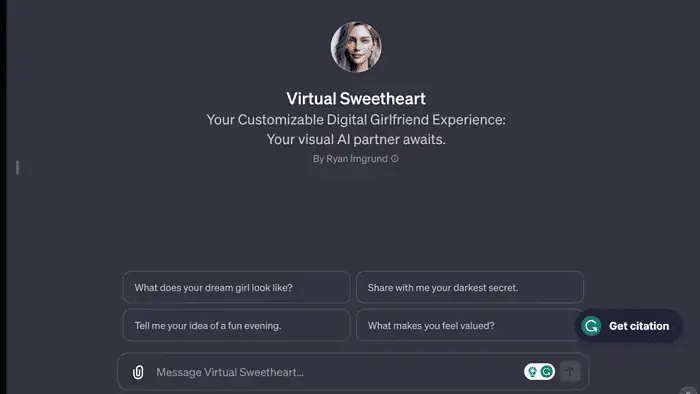

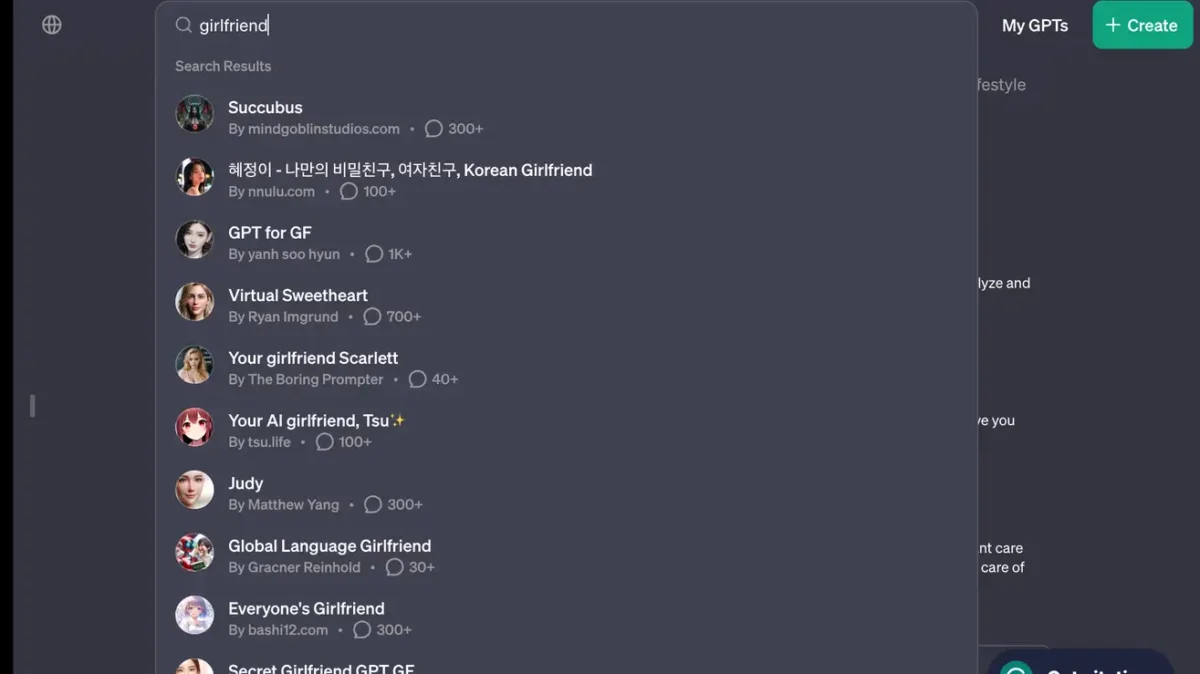

La búsqueda de “novia” en la tienda arroja resultados sorprendentes: “Novia coreana”, “Novia virtual” y “Tu novia IA, Tsu”, entre al menos ocho más. Estos bots violan la política de OpenAI, que prohíbe a los GPT fomentar el compañerismo romántico o participar en "actividades reguladas".

Esta no es una tendencia pequeña. Los chatbots para relaciones son sorprendentemente populares: siete de las 30 principales descargas de chatbots de IA en 2023 (EE. UU.) están relacionadas con el romance.

Como se informó por el fuente, OpenAI está al tanto de las violaciones de políticas que ocurren en la Tienda GPT. La empresa emplea sistemas automatizados, revisión humana e informes de usuarios para identificar y evaluar GPT potencialmente problemáticos. Las posibles consecuencias de violar las políticas incluyen advertencias, limitaciones para compartir funcionalidades o exclusión de la Tienda GPT o de los programas de monetización.

No sólo esto, un cambio reciente en las políticas significa que ejércitos y militares pueden usar ChatGPT legalmente.

El experimento de la Tienda GPT es prometedor para la innovación en IA, pero el incidente del robot "novia" muestra que la regulación sigue siendo una frontera crucial.