El motor de procesamiento neuronal Snapdragon de Qualcomm permitirá mejores experiencias de RA

3 minuto. leer

Publicado el

Lea nuestra página de divulgación para descubrir cómo puede ayudar a MSPoweruser a sostener el equipo editorial. Leer más

Apple ARKit será la plataforma AR más grande del mundo cuando se lance a finales de este año. Cientos de millones de dispositivos iPhone y iPad serán compatibles con ARKit, gracias a la potente CPU y GPU que ya están disponibles en estos dispositivos. Para habilitar la detección de escenas y el seguimiento de objetos de alta precisión, debe ejecutar algoritmos controlados por redes neuronales en el dispositivo. Estos algoritmos no pueden ejecutarse completamente en la CPU como cualquier otro algoritmo, ya que requieren más energía y consumen más batería. Dado que Apple conoce exactamente el hardware dentro de estos dispositivos, han optimizado el ARKit para que funcione bien en los dispositivos iOS de manera eficiente.

Google, por otro lado, no puede hacer lo mismo ya que su ecosistema de Android se basa en una amplia variedad de modelos de CPU y GPU de diferentes proveedores como Qualcomm, Samsung, MediaTek, etc., y sus capacidades varían drásticamente. Qualcomm, el fabricante de procesadores móviles más popular, está tratando de resolver este problema utilizando el SDK del motor de procesamiento neuronal (NPE). Snapdragon NPE es un marco de software de aprendizaje profundo diseñado para plataformas móviles Snapdragon. Ayuda a los desarrolladores a ejecutar uno o más modelos de redes neuronales entrenados en Caffe/Caffe2 o TensorFlow en plataformas móviles Snapdragon, ya sea CPU, GPU o DSP. Admite redes neuronales convolucionales y capas personalizadas.

- Snapdragon NPE está diseñado para ayudar a los desarrolladores a ahorrar tiempo y esfuerzo en la optimización del rendimiento de las redes neuronales capacitadas en dispositivos con Snapdragon.

- Lo hace proporcionando herramientas para la conversión y ejecución de modelos, así como API para apuntar al núcleo con el perfil de potencia y rendimiento para que coincida con la experiencia de usuario deseada.

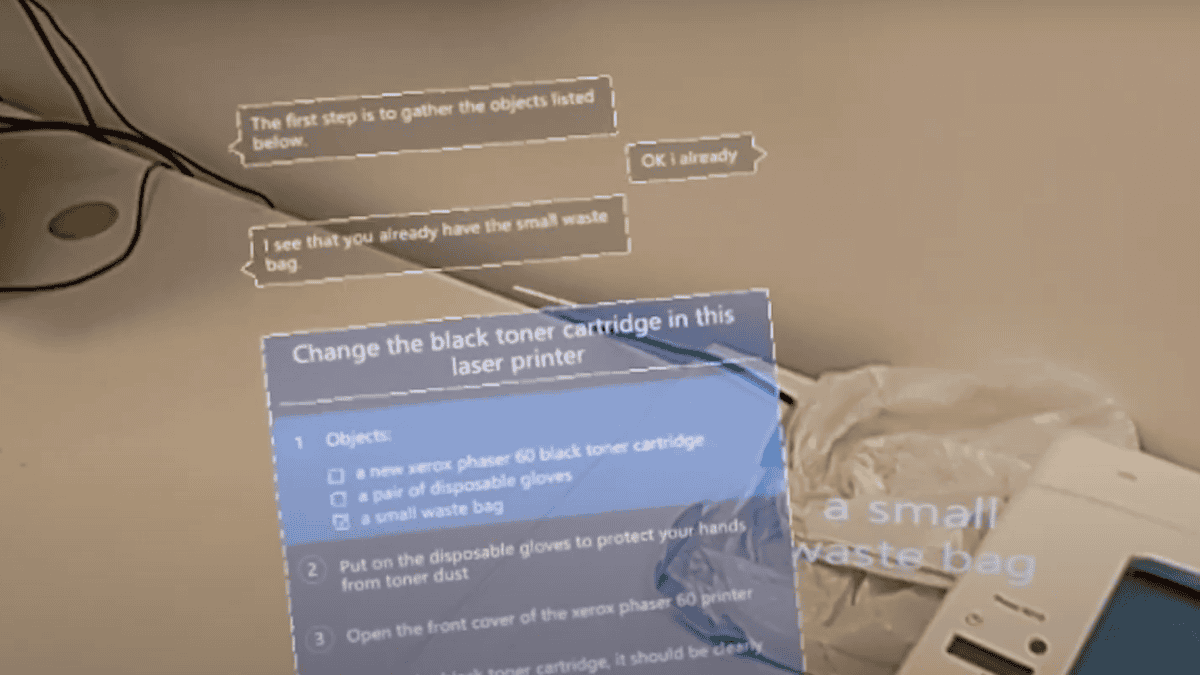

- Los desarrolladores pueden aprovechar las experiencias de usuario de aprendizaje profundo como transferencias de estilo y filtros (realidad aumentada), detección de escenas, reconocimiento facial, comprensión del lenguaje natural, seguimiento y evitación de objetos, gestos y reconocimiento de texto, por nombrar algunos.

Facebook, por ejemplo, planea integrar Snapdragon NPE en la cámara de la aplicación de Facebook para acelerar las funciones de realidad aumentada impulsadas por Caffe2. Como resultado, pueden lograr un rendimiento 5 veces mejor en la GPU Adreno, en comparación con una implementación de CPU genérica, lo que resulta en una aplicación más fluida, fluida y realista de las funciones de AR al capturar fotos y videos en vivo.

Snapdragon NPE SDK incluye lo siguiente:

- Tiempos de ejecución de Android y Linux para la ejecución de modelos de redes neuronales

- Soporte de aceleración para Qualcomm Hexagon DSP, Qualcomm Adreno GPU y Qualcomm Kryo, CPU

- Soporte para modelos en formatos Caffe, Caffe2 y TensorFlow3

- API para controlar la carga, la ejecución y la programación en los tiempos de ejecución

- Herramientas de escritorio para la conversión de modelos

- Punto de referencia de rendimiento para la identificación de cuellos de botella

- Ejemplo de código y tutoriales

- Documentación HTML

Snapdragon NPE es compatible con las plataformas móviles de las series Snapdragon 600 y 800. Según mis estimaciones, habrá al menos 200 millones de dispositivos móviles activos con procesadores de las series Snapdragon 600 y 800. Con suerte, los desarrolladores aprovecharán esta plataforma NPE para crear excelentes experiencias de realidad aumentada en dispositivos móviles. Puedes descargar el SDK esta página.

En una nota relacionada, Microsoft anunció a principios de esta semana que la próxima versión de HoloLens contará con la segunda versión de la HPU que incluirá un coprocesador de IA para implementar redes neuronales profundas de forma nativa y flexible. Leer más al respecto esta página.