OpenAI se une al Comité Directivo de C2PA

2 minuto. leer

Publicado el

Lea nuestra página de divulgación para descubrir cómo puede ayudar a MSPoweruser a sostener el equipo editorial. Leer más

Notas clave

- OpenAI se une a la Coalición para la Procedencia y Autenticidad del Contenido (C2PA) y desarrolla nuevas técnicas de marca de agua.

La Coalición para la Procedencia y Autenticidad del Contenido (C2PA) desarrolla estándares técnicos para certificar la fuente y el historial (o procedencia) del contenido multimedia. El proyecto C2PA fue iniciado inicialmente por Adobe, Arm, Intel, Microsoft y Truepic.

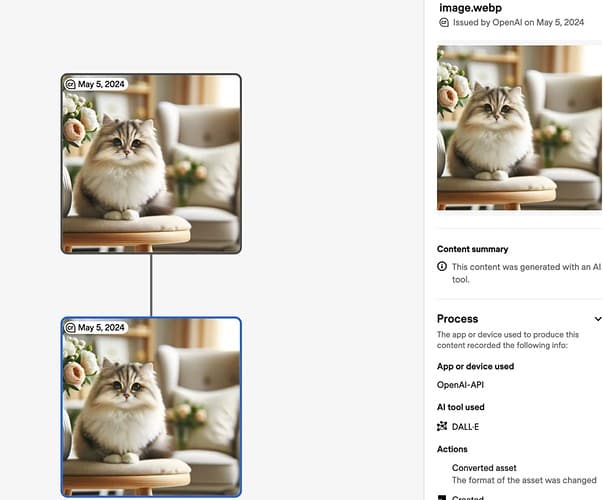

Hoy, OpenAI anunció que se une al Comité Directivo de C2PA. OpenAI contribuirá al desarrollo del estándar. Es importante señalar que OpenAI comenzó a agregar metadatos C2PA a todas las imágenes creadas y editadas por DALL·E 3 a principios de este año. En el futuro, OpenAI integrará metadatos C2PA para Sora. Al igual que otros metadatos, las personas aún pueden eliminar los metadatos del contenido creado por IA, pero no pueden falsificar ni alterar esta información fácilmente.

Además de unirse al comité C2PA, OpenAI también está desarrollando nuevos métodos de procedencia para mejorar la integridad del contenido digital. Por ejemplo, están desarrollando marcas de agua a prueba de manipulaciones, herramientas que utilizan inteligencia artificial para identificar con precisión la probabilidad de que el contenido se haya originado a partir de modelos generativos. OpenAI está abriendo solicitudes para acceder al clasificador de detección de imágenes de OpenAI a un grupo de evaluadores a partir de hoy. Se pueden presentar solicitudes para acceder a esta nueva herramienta esta página.

Finalmente, OpenAI ha incluido marcas de agua de audio en Voice Engine, su modelo de voz personalizado, que actualmente se encuentra en una vista previa de investigación limitada.

“Si bien soluciones técnicas como las anteriores nos brindan herramientas activas para nuestras defensas, permitir de manera efectiva la autenticidad del contenido en la práctica requerirá una acción colectiva. Por ejemplo, las plataformas, los creadores de contenido y los manejadores intermedios deben facilitar la retención de metadatos para permitir la transparencia para el consumidor final de contenido sobre la fuente del contenido”, escribió el equipo de OpenAI mientras hacía los anuncios anteriores.