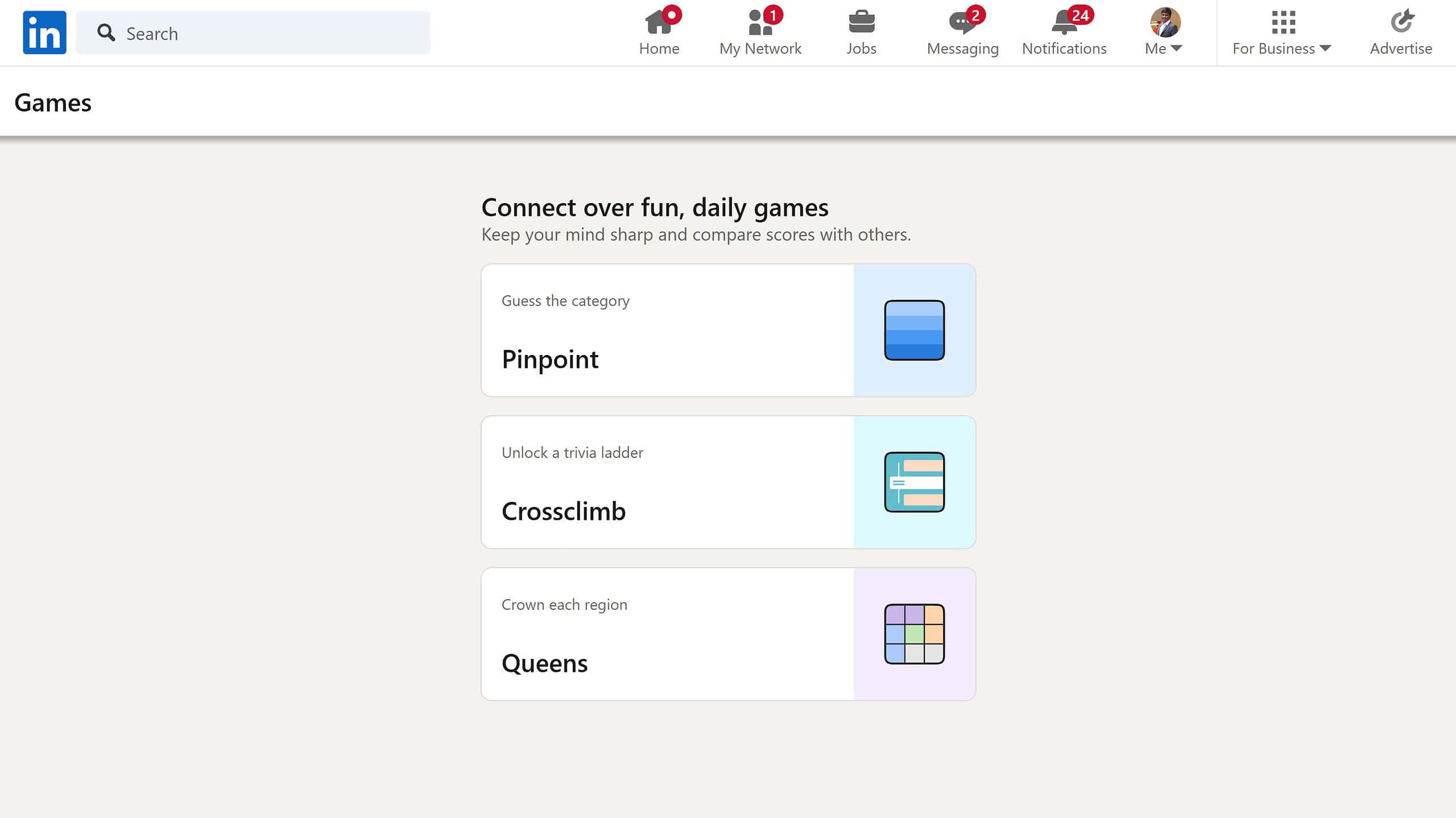

Microsoft DeBERTa supera a los humanos insignificantes en la prueba de comprensión de lectura SuperGlue

2 minuto. leer

Publicado el

Lea nuestra página de divulgación para descubrir cómo puede ayudar a MSPoweruser a sostener el equipo editorial. Leer más

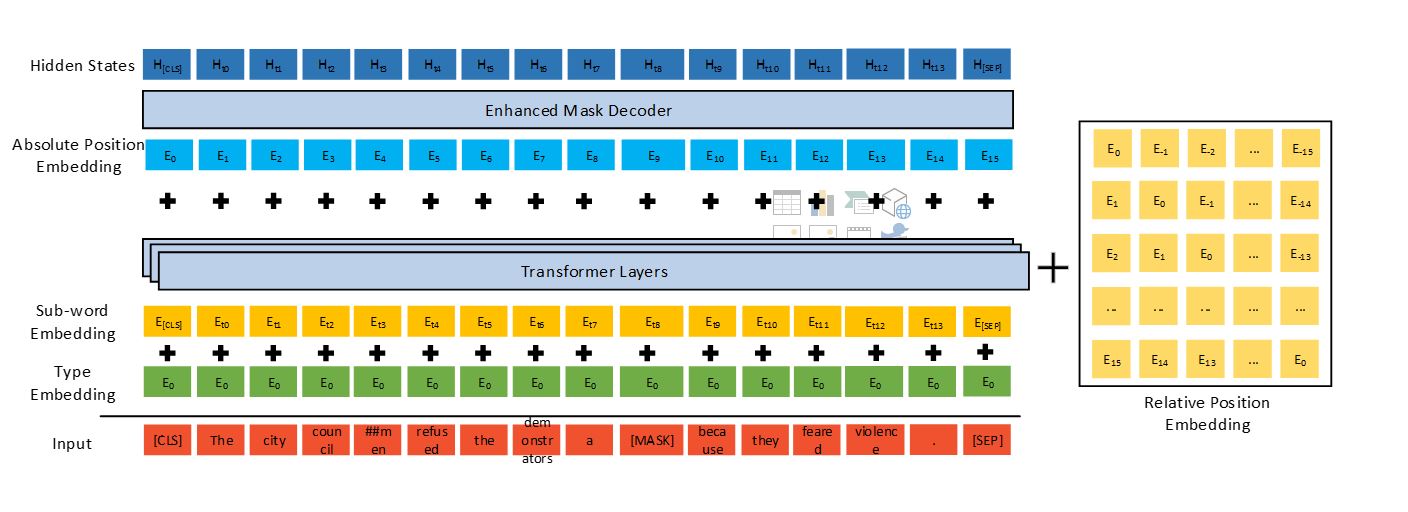

Ha habido un progreso masivo recientemente en redes de entrenamiento con millones de parámetros. Microsoft actualizó recientemente el modelo DeBERTa (BERT mejorado con decodificación con atención desenredada) entrenando una versión más grande que consta de 48 capas de transformadores con 1.5 millones de parámetros. El aumento significativo del rendimiento hace que el modelo único de DeBERTa supere el rendimiento humano en el procesamiento y la comprensión del lenguaje SuperGLUE por primera vez en términos de puntaje promedio macro (89.9 frente a 89.8), superando la línea base humana por un margen decente (90.3 frente a 89.8) . El punto de referencia SuperGLUE consta de una amplia gama de tareas de comprensión del lenguaje natural, que incluyen respuesta a preguntas e inferencia del lenguaje natural. El modelo también se encuentra en la parte superior de las clasificaciones de referencia de GLUE con un puntaje promedio macro de 90.8.

DeBERTa mejora los PLM de última generación anteriores (por ejemplo, BERT, Roberta, UniLM) utilizando tres técnicas novedosas: un mecanismo de atención desenredado, un decodificador de máscara mejorado y un método de entrenamiento adversario virtual para el ajuste fino.

En comparación con el modelo T5 de Google, que consta de 11 1.5 millones de parámetros, el DeBERTa de XNUMX millones de parámetros es mucho más eficiente energéticamente para entrenar y mantener, y es más fácil de comprimir e implementar en aplicaciones de varias configuraciones.

DeBERTa superar el rendimiento humano en SuperGLUE marca un hito importante hacia la IA general. A pesar de sus resultados prometedores en SuperGLUE, el modelo no está alcanzando la inteligencia de nivel humano de NLU. Los humanos son extremadamente buenos para aprovechar el conocimiento aprendido de diferentes tareas para resolver una nueva tarea con poca o ninguna demostración específica de la tarea.

Microsoft integrará la tecnología en la próxima versión del modelo de representación de lenguaje natural de Microsoft Turing, utilizado en lugares como Bing, Office, Dynamics y Azure Cognitive Services, impulsando una amplia gama de escenarios que involucran interacciones humano-máquina y humano-humano a través de lenguaje natural (como chatbot, recomendación, respuesta a preguntas, búsqueda, asistencia personal, automatización de atención al cliente, generación de contenido y otros). Además, Microsoft lanzará al público el modelo DeBERTa de 1.5 millones de parámetros y el código fuente.

Lea todo el detalle en Microsoft esta página.