Το Microsoft Azure AI αποκαλύπτει τα «Prompt Shields» για την καταπολέμηση της χειραγώγησης LLM

2 λεπτό. ανάγνωση

Δημοσιεύθηκε στις

Διαβάστε τη σελίδα αποκάλυψης για να μάθετε πώς μπορείτε να βοηθήσετε το MSPoweruser να διατηρήσει τη συντακτική ομάδα Διάβασε περισσότερα

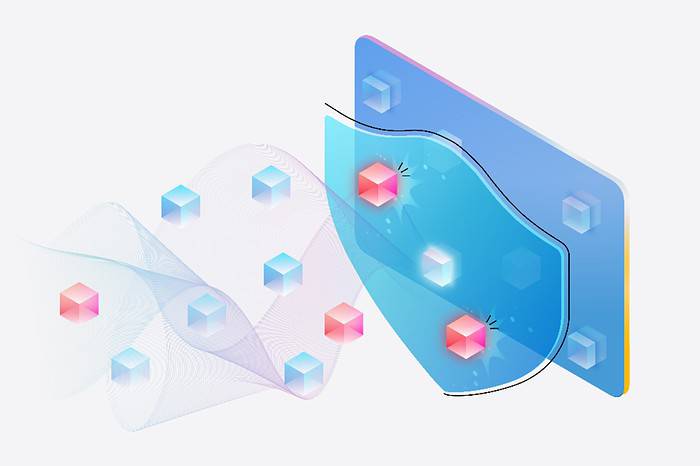

Η Microsoft σήμερα ανακοίνωσε μια σημαντική βελτίωση ασφαλείας για τις πλατφόρμες Azure OpenAI Service και Azure AI Content Safety. Με την ονομασία "Prompt Shields", η νέα δυνατότητα προσφέρει ισχυρή άμυνα έναντι ολοένα και πιο εξελιγμένων επιθέσεων που στοχεύουν μεγάλα γλωσσικά μοντέλα (LLM).

Το Prompt Shields προστατεύει από:

- Άμεσες επιθέσεις: Γνωστές και ως επιθέσεις jailbreak, αυτές οι προσπάθειες καθοδηγούν ρητά το LLM να αγνοήσει τα πρωτόκολλα ασφαλείας ή να εκτελέσει κακόβουλες ενέργειες.

- Έμμεσες επιθέσεις: Αυτές οι επιθέσεις ενσωματώνουν διακριτικά επιβλαβείς οδηγίες σε φαινομενικά κανονικό κείμενο, με στόχο να εξαπατήσουν το LLM σε ανεπιθύμητη συμπεριφορά.

Το Prompt Shields είναι ενσωματωμένο με φίλτρα περιεχομένου υπηρεσίας Azure OpenAI και είναι διαθέσιμα στο Azure AI Content Safety. Χάρη στους προηγμένους αλγόριθμους μηχανικής εκμάθησης και την επεξεργασία φυσικής γλώσσας, το Prompt Shields μπορεί να εντοπίσει και να εξουδετερώσει πιθανές απειλές στα μηνύματα προτροπής των χρηστών και σε δεδομένα τρίτων.

Spotlighting: A Novel Defense Technique

Η Microsoft εισήγαγε επίσης το "Spotlighting", μια εξειδικευμένη προσέγγιση άμεσης μηχανικής που έχει σχεδιαστεί για να αποτρέπει έμμεσες επιθέσεις. Οι τεχνικές επισήμανσης, όπως η οριοθέτηση και η σήμανση δεδομένων, βοηθούν τους LLM να διακρίνουν ξεκάθαρα τις νόμιμες οδηγίες και τις δυνητικά επιβλαβείς ενσωματωμένες εντολές.

Διαθεσιμότητα

Το Prompt Shields βρίσκεται επί του παρόντος σε δημόσια προεπισκόπηση ως μέρος της Ασφάλειας περιεχομένου Azure AI και θα είναι διαθέσιμο στην υπηρεσία Azure OpenAI την 1η Απριλίου. Η ενσωμάτωση στο Azure AI Studio σχεδιάζεται στο εγγύς μέλλον.