Was ist GPT-3 und wie wirkt es sich auf Ihren aktuellen Job aus?

3 Minute. lesen

Aktualisiert am

Lesen Sie unsere Offenlegungsseite, um herauszufinden, wie Sie MSPoweruser dabei helfen können, das Redaktionsteam zu unterstützen Lesen Sie weiter

GPT ist die Abkürzung für Generative Pre-training Transformer (GPT), ein Sprachmodell, das von Alec Radford geschrieben und 2018 von OpenAI, Elon Musks Forschungslabor für künstliche Intelligenz, veröffentlicht wurde. Es verwendet ein generatives Sprachmodell (bei dem sich zwei neuronale Netze durch Konkurrenz perfektionieren) und ist in der Lage, Wissen über die Welt zu erwerben und weitreichende Abhängigkeiten zu verarbeiten, indem es auf verschiedene Sätze von schriftlichem Material mit langen Abschnitten zusammenhängenden Textes vortrainiert.

GPT-2 (Generative Pretrained Transformer 2) wurde im Februar 2019 angekündigt und ist ein unbeaufsichtigtes Transformer-Sprachmodell, das mit 8 Millionen Dokumenten für insgesamt 40 GB Text aus Artikeln trainiert wurde, die über Reddit-Einreichungen geteilt wurden. Elon Musk war bekanntermaßen zurückhaltend, es zu veröffentlichen, da er befürchtete, es könnte verwendet werden, um soziale Netzwerke mit gefälschten Nachrichten zu überfluten.

Im Mai 2020 kündigte OpenAI GPT-3 (Generative Pretrained Transformer 3) an, ein Modell, das zwei Größenordnungen mehr Parameter enthält als GPT-2 (175 Milliarden vs. 1.5 Milliarden Parameter) und das eine dramatische Verbesserung gegenüber GPT-2 bietet.

Bei jeder Textaufforderung gibt der GPT-3 eine Textvervollständigung zurück und versucht, dem von Ihnen angegebenen Muster zu entsprechen. Sie können es „programmieren“, indem Sie ihm nur ein paar Beispiele dessen zeigen, was es tun soll, und es wird einen vollständigen Artikel oder eine Geschichte liefern, wie den unten stehenden Text, der vollständig von GPT-3 geschrieben wurde.

GPT-3 erzielt eine starke Leistung bei vielen NLP-Datensätzen, einschließlich Übersetzungs-, Fragebeantwortungs- und Lückentextaufgaben sowie bei mehreren Aufgaben, die spontanes Denken oder Domänenanpassung erfordern, wie z. B. das Entschlüsseln von Wörtern unter Verwendung eines neuen Wortes in a Satz oder 3-stellige Arithmetik ausführen. GPT-3 kann Muster von Nachrichtenartikeln generieren, die menschliche Bewerter nur schwer von Artikeln unterscheiden können, die von Menschen geschrieben wurden.

Die letzte Anwendung hat OpenAI immer Sorgen gemacht. GPT-3 ist derzeit als offene Beta verfügbar, wobei eine kostenpflichtige private Beta voraussichtlich irgendwann verfügbar sein wird. OpenAI sagte, dass sie den API-Zugriff für offensichtlich schädliche Anwendungsfälle wie Belästigung, Spam, Radikalisierung oder Astroturfing beenden werden.

Während die am offensichtlichsten bedrohte Bevölkerung diejenigen sind, die schriftliche Arbeiten produzieren, wie z. B. Drehbuchautoren, haben KI-Entwickler bereits überraschende Anwendungen gefunden, z. B. die Verwendung von GPT-3 zum Schreiben von Code.

Sharif Shameem hat zum Beispiel einen Layout-Generator geschrieben, bei dem man im Klartext beschreibt, was man will, und das Modell den passenden Code generiert.

Das ist umwerfend.

Mit GPT-3 habe ich einen Layout-Generator erstellt, in dem Sie einfach jedes gewünschte Layout beschreiben und der den JSX-Code für Sie generiert.

WAS pic.twitter.com/w8JkrZO4lk

- Sharif Shameem (@sharifshameem) 13. Juli 2020

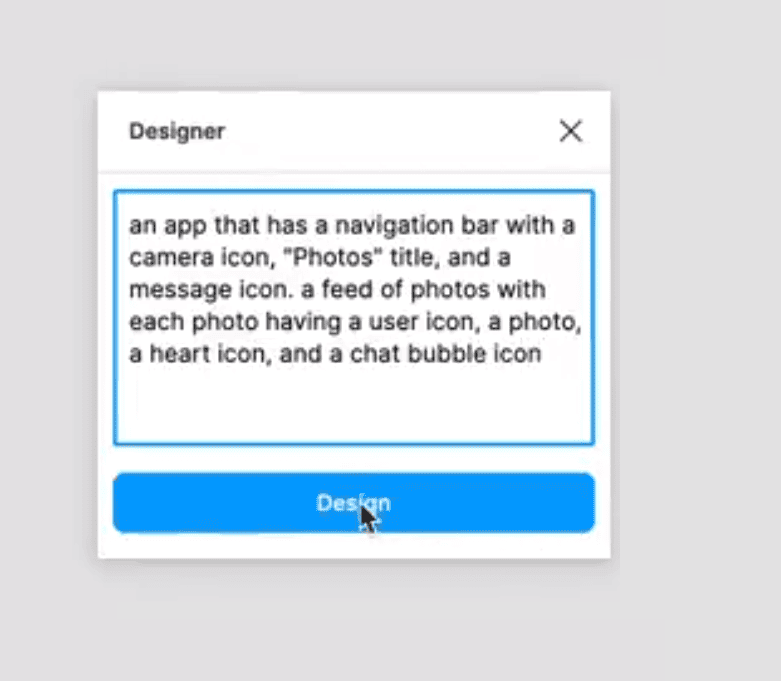

Jordan Singer hat auf ähnliche Weise ein Figma-Plugin entwickelt, mit dem man Apps mit einfachen Textbeschreibungen erstellen kann.

Das ändert alles. ?

Mit GPT-3 habe ich ein Figma-Plugin erstellt, um es für Sie zu entwerfen.

Ich nenne es "Designer" pic.twitter.com/OzW1sKNLEC

— jordanischer Sänger (@jsngr) 18. Juli 2020

Es kann sogar verwendet werden, um Asthma zu diagnostizieren und Medikamente zu verschreiben.

So @ OpenAI haben mir frühzeitig Zugang zu einem Tool verschafft, das es Entwicklern ermöglicht, den im Wesentlichen leistungsstärksten Textgenerator aller Zeiten zu verwenden. Ich dachte, ich teste es, indem ich eine medizinische Frage stelle. Der fettgedruckte Text ist der von der KI generierte Text. Unglaublich… (1/2) pic.twitter.com/4bGfpI09CL

— Qasim Munye (@qasimmunye) 2. Juli 2020

Andere Anwendungen sind eine Art Suchmaschine oder Orakel und können sogar verwendet werden, um schwierige Konzepte zu erklären und zu erweitern.

Ich habe eine voll funktionsfähige Suchmaschine auf GPT3 aufgebaut.

Für jede beliebige Abfrage gibt es die genaue Antwort UND die entsprechende URL zurück.

Sehen Sie sich das gesamte Video an. Es ist umwerfend gut.

cc: @gdb @npew @gwern pic.twitter.com/9ismj62w6l

– Paras Chopra (@paraschopra) 19. Juli 2020

Während es scheint, dass dieser Ansatz direkt zu einer allgemeinen KI führt, die wie ein Mensch verstehen, argumentieren und sich unterhalten kann, warnt OpenAI, dass sie möglicherweise auf grundlegende Skalierungsprobleme gestoßen sind, da GPT-3 mehrere tausend Petaflop/s-Tage an Rechenleistung erfordert , verglichen mit Dutzenden von Petaflop/s-Tagen für die vollständige GPT-2. Es scheint, während wir näher sind, ist der Durchbruch, der alle unsere Jobs obsolet machen wird, noch in weiter Ferne.

Lesen Sie mehr über GPT-3 bei GitHub hier.