Die Free Software Foundation ist der Meinung, dass GitHub Copilot illegal sein sollte

3 Minute. lesen

Aktualisiert am

Lesen Sie unsere Offenlegungsseite, um herauszufinden, wie Sie MSPoweruser dabei helfen können, das Redaktionsteam zu unterstützen Lesen Sie weiter

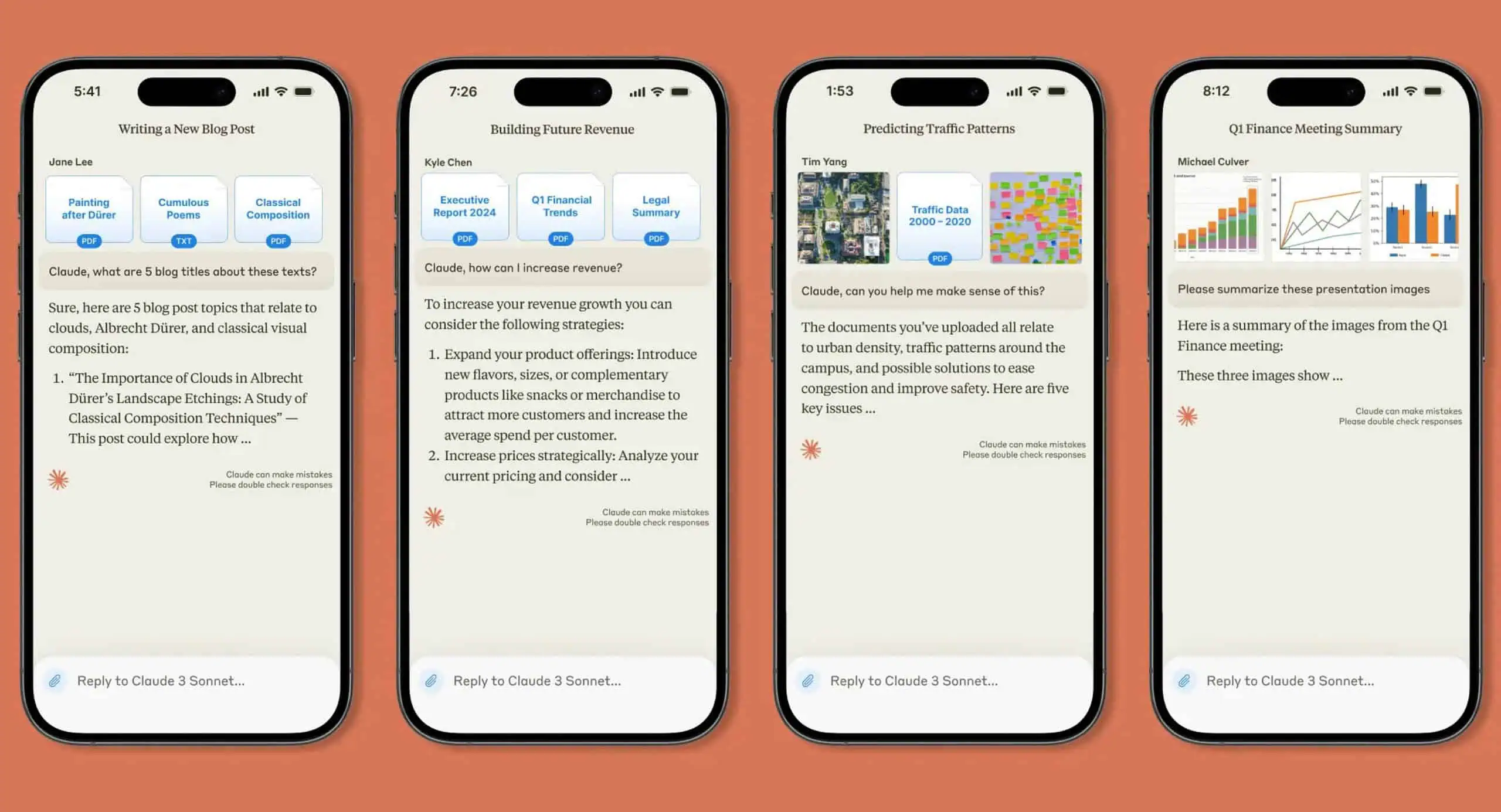

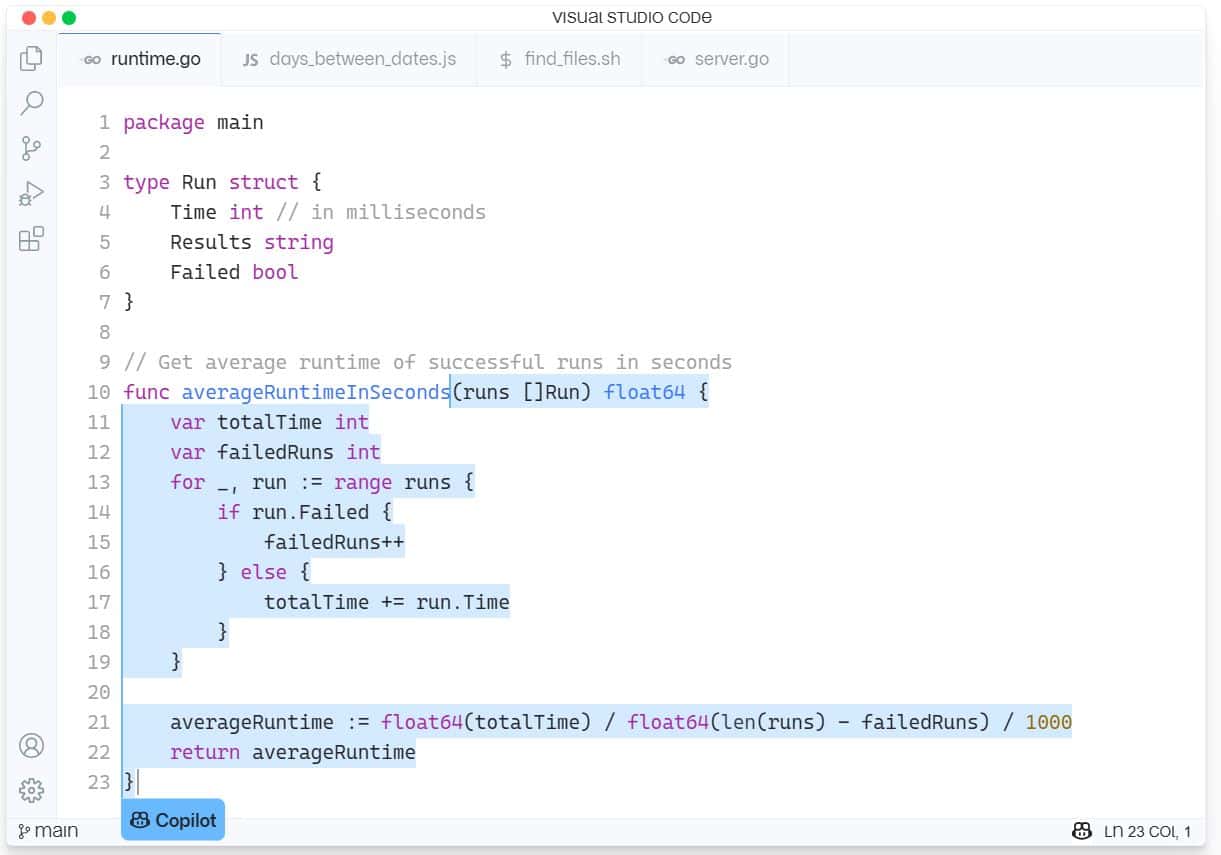

GitHub Copilot ist ein neuer KI-Unterstützungsdienst für die Softwareentwicklung, der in Visual Studio Code von Microsoft integriert ist. GitHub Copilot unterstützt eine Vielzahl von Sprachen und Frameworks und erleichtert Entwicklern das Leben, indem es Vorschläge für ganze Zeilen oder ganze Funktionen direkt in der IDE anbietet. GitHub Copilot basiert auf OpenAI Codex und wurde mit Milliarden von Open-Source-Codezeilen trainiert.

Das letzte Problem hat dazu geführt, dass die Free Software Foundation (FSF) eine massive Biene in ihrer Motorhaube hat und das Tool als „aus unserer Sicht inakzeptabel und ungerecht“ bezeichnet.

Der Befürworter von Open-Source-Software beschwert sich darüber, dass Copilot Closed-Source-Software wie Microsofts Visual Studio IDE oder den Visual Studio Code-Editor benötigt, um ausgeführt zu werden, und dass es einen „Dienst als Software-Ersatz“ darstellt, was bedeutet, dass es eine Möglichkeit ist, Macht über die Computer anderer Leute zu erlangen.

Die FSF war der Ansicht, dass es zahlreiche Probleme mit Copilot gab, die noch vor Gericht geprüft werden mussten.

„Entwickler möchten wissen, ob das Trainieren eines neuronalen Netzwerks in ihrer Software als faire Nutzung angesehen werden kann. Andere, die Copilot verwenden möchten, fragen sich, ob die Codeschnipsel und andere Elemente, die aus von GitHub gehosteten Repositories kopiert wurden, zu einer Urheberrechtsverletzung führen könnten. Und selbst wenn alles rechtlich kopacetisch sein mag, fragen sich Aktivisten, ob es nicht grundlegend unfair ist, wenn ein proprietäres Softwareunternehmen einen Dienst aus seiner Arbeit aufbaut“, schrieb die FSF.

Um diese Fragen zu beantworten, hat die FSF Weißbücher angefordert, die die folgenden Themen untersuchen:

- Ist die Schulung von Copilot zu öffentlichen Repositories eine Urheberrechtsverletzung? Faire Nutzung?

- Wie wahrscheinlich ist es, dass die Ausgabe von Copilot einklagbare Ansprüche wegen Verstößen gegen GPL-lizenzierte Werke nach sich zieht?

- Können Entwickler, die Copilot verwenden, freie Softwarelizenzen wie die GPL einhalten?

- Wie können Entwickler sicherstellen, dass Code, an dem sie das Urheberrecht besitzen, vor von Copilot generierten Verletzungen geschützt ist?

- Wenn Copilot Code generiert, der zu einer Verletzung eines lizenzierten Werks für kostenlose Software führt, wie kann diese Verletzung vom Urheberrechtsinhaber entdeckt werden?

- Ist ein trainiertes KI/ML-Modell urheberrechtlich geschützt? Wer hat das Urheberrecht?

- Sollten Organisationen wie die FSF für eine Änderung des Urheberrechtsgesetzes eintreten, die für diese Fragen relevant ist?

Die FSF zahlt 500 US-Dollar für veröffentlichte Whitepaper und kann weitere Mittel freigeben, wenn weitere Forschung gerechtfertigt ist.

Wer etwas einreichen möchte, kann es an senden [E-Mail geschützt] vor dem 21. August. Lesen Sie mehr über den Prozess bei FSF.org hier.

Microsoft hat auf die kommende Herausforderung mit den Worten reagiert: „Dies ist ein neuer Raum, und wir sind sehr daran interessiert, mit Entwicklern über diese Themen zu diskutieren und die Branche bei der Festlegung geeigneter Standards für das Training von KI-Modellen anzuführen.“

Angesichts der Tatsache, dass Copilot manchmal ganze Funktionen von anderen Open-Source-Apps stiehlt, stimmen unsere Leser der FSF zu, oder ist die FSF heuchlerisch, nur weil es eher eine KI als ein menschlicher Umnutzungscode ist? Teilen Sie uns Ihre Meinung in den Kommentaren unten mit.