Microsoft und NVIDIA kündigen das größte und leistungsfähigste Sprachmodell an, das bisher trainiert wurde

1 Minute. lesen

Veröffentlicht am

Lesen Sie unsere Offenlegungsseite, um herauszufinden, wie Sie MSPoweruser dabei helfen können, das Redaktionsteam zu unterstützen Lesen Sie weiter

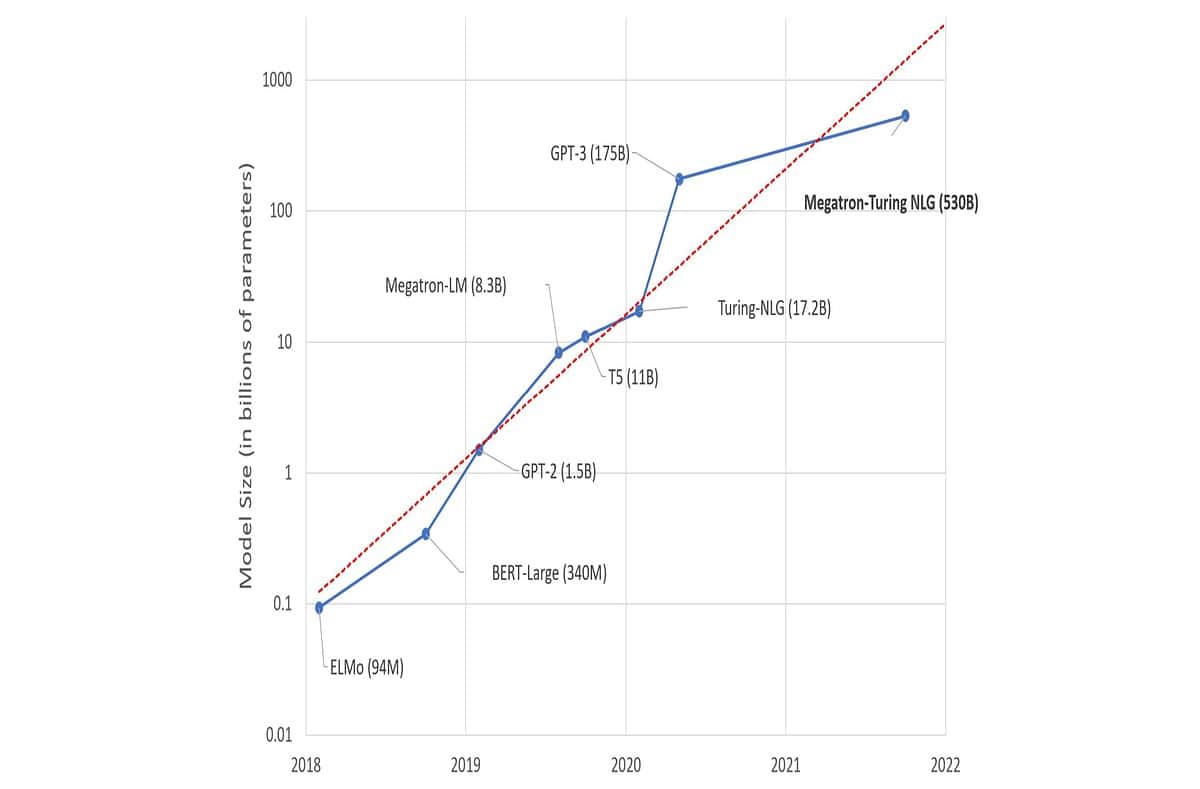

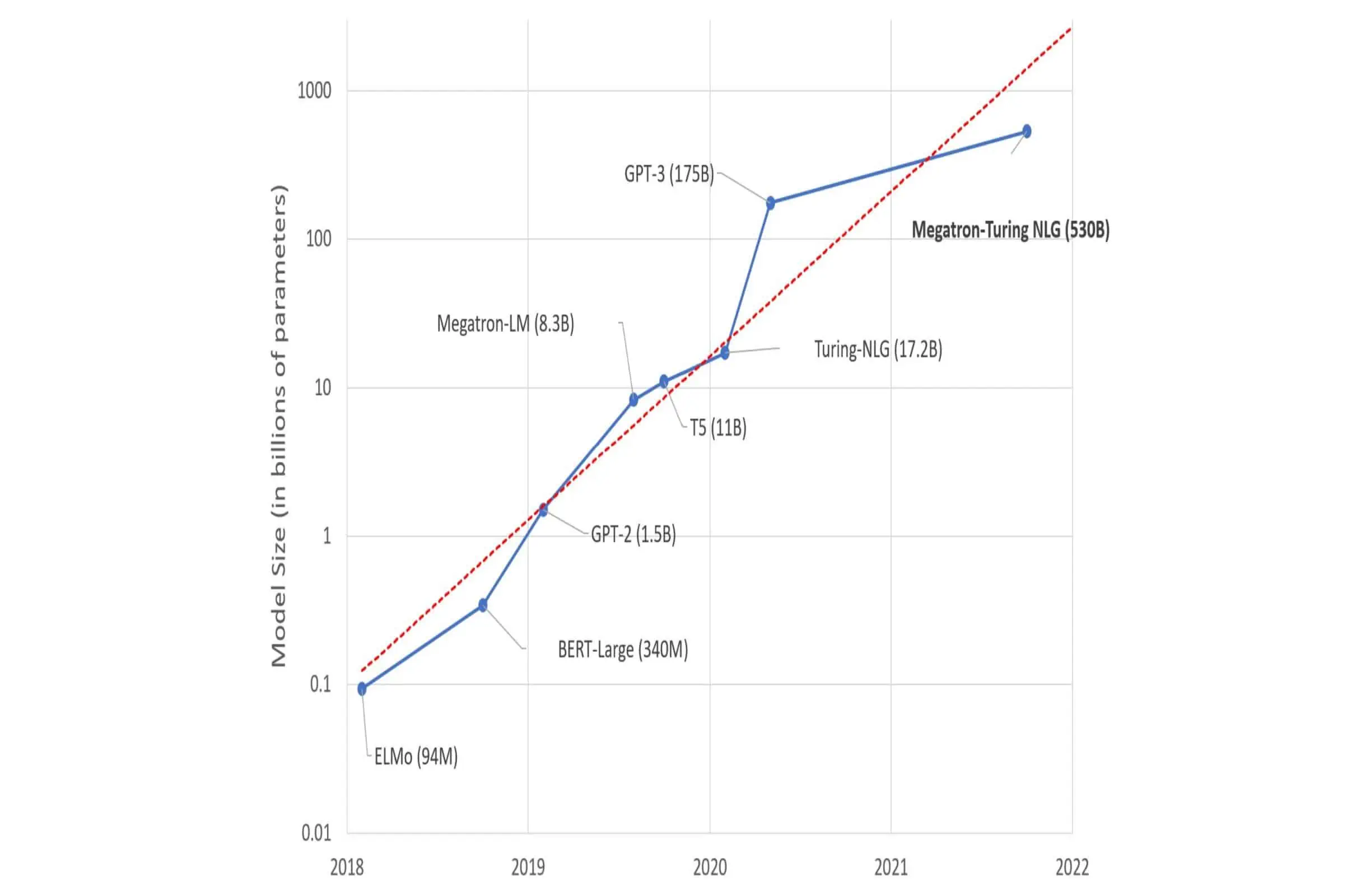

Microsoft und NVIDIA haben heute das von DeepSpeed und Megatron betriebene Megatron-Turing Natural Language Generation Model (MT-NLG) angekündigt, das größte und leistungsfähigste monolithische Transformer-Sprachmodell, das bisher trainiert wurde. Dieses Modell umfasst 530 Milliarden Parameter, das Dreifache der Anzahl an Parametern im Vergleich zum bestehenden größten Modell GPT-3. Das Trainieren eines solch großen Modells bringt verschiedene Herausforderungen mit sich. NVIDIA und Microsoft haben an vielen Innovationen und Durchbrüchen entlang aller KI-Achsen gearbeitet.

Beispielsweise haben NVIDIA und Microsoft in enger Zusammenarbeit eine beispiellose Schulungseffizienz erreicht, indem sie eine hochmoderne GPU-beschleunigte Schulungsinfrastruktur mit einem hochmodernen verteilten Lernsoftware-Stack zusammengeführt haben. Wir haben hochwertige, natürliche Sprachtrainingskorpora mit Hunderten von Milliarden von Token aufgebaut und gemeinsam Trainingsrezepte entwickelt, um die Effizienz und Stabilität der Optimierung zu verbessern.

Unter den folgenden Links können Sie mehr über dieses Projekt erfahren.