Free Software Foundation mener, at GitHub Copilot burde være ulovligt

3 min. Læs

Opdateret den

Læs vores oplysningsside for at finde ud af, hvordan du kan hjælpe MSPoweruser med at opretholde redaktionen Læs mere

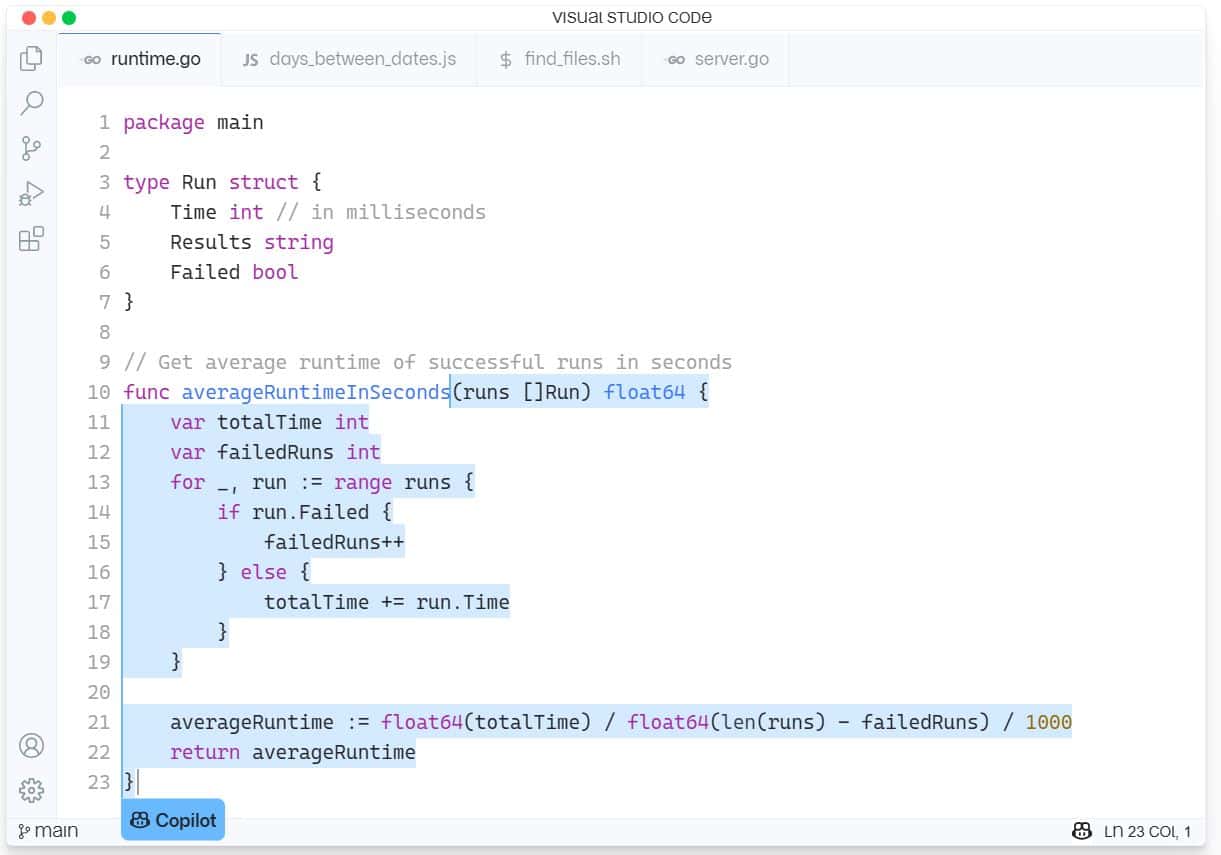

GitHub Copilot er en ny AI-hjælpetjeneste til softwareudvikling indbygget i Microsofts Visual Studio Code. GitHub Copilot understøtter en række sprog og rammer og gør livet lettere for udviklere ved at tilbyde forslag til hele linjer eller hele funktioner lige inde i IDE. GitHub Copilot er drevet af OpenAI Codex og blev trænet på milliarder af linjer med open source-kode.

Det sidste problem har fået Free Software Foundation (FSF) til at have en massiv bi i deres motorhjelm, der kalder værktøjet "uacceptabelt og uretfærdigt set fra vores perspektiv."

Fortaleren for open source-software klager over, at Copilot kræver lukket kilde-software som Microsofts Visual Studio IDE eller Visual Studio Code-editor for at køre, og at det udgør en "service som softwareerstatning", hvilket betyder, at det er en måde at få magt over andre menneskers computere.

FSF mente, at der var adskillige problemer med Copilot, som stadig skulle testes i retten.

"Udviklere vil gerne vide, om træning af et neuralt netværk på deres software kan betragtes som rimelig brug. Andre, der måske vil bruge Copilot, spekulerer på, om kodestykkerne og andre elementer kopieret fra GitHub-hostede arkiver kan resultere i krænkelse af ophavsretten. Og selvom alt kan være lovligt kopacetisk, spekulerer aktivister på, om der ikke er noget fundamentalt uretfærdigt ved et proprietært softwarefirma, der bygger en tjeneste ud af deres arbejde,” skrev FSF.

Hjælpen med at besvare disse spørgsmål har FSF efterlyst hvidbøger, der undersøger følgende spørgsmål:

- Er Copilots træning i offentlige depoter krænkelse af ophavsretten? Fair brug?

- Hvor sandsynligt er det, at Copilots output genererer handlingspligtige påstande om overtrædelser af GPL-licenserede værker?

- Kan udviklere, der bruger Copilot, overholde gratis softwarelicenser som GPL?

- Hvordan kan udviklere sikre, at kode, som de har ophavsretten til, er beskyttet mod krænkelser genereret af Copilot?

- Hvis Copilot genererer kode, der giver anledning til en krænkelse af et gratis softwarelicenseret værk, hvordan kan denne krænkelse opdages af indehaveren af ophavsretten?

- Er en trænet AI/ML-model ophavsretligt beskyttet? Hvem har ophavsretten?

- Bør organisationer som FSF argumentere for ændringer i ophavsretsloven, der er relevant for disse spørgsmål?

FSF vil betale $500 for offentliggjorte hvidbøger og kan frigive flere midler, hvis yderligere forskning er berettiget.

Dem, der ønsker at lave en aflevering, kan sende den til [e-mail beskyttet] inden den 21. august. Læs mere om processen på FSF.org her.

Microsoft har reageret på den kommende udfordring ved at sige: "Dette er et nyt rum, og vi er ivrige efter at engagere os i en diskussion med udviklere om disse emner og lede industrien i at sætte passende standarder for træning af AI-modeller."

I betragtning af at Copilot nogle gange stjæler hele funktioner fra andre Open Source-apps, er vores læsere så enige med FSF, eller er FSF hyklerisk, blot fordi det er en AI snarere end en menneskelig genbrugskode? Fortæl os din mening i kommentarerne nedenfor.

via infoverden

Brugerforum

0 meddelelser