Microsoft og OpenAI bekæmper deepfakes ved valg og bruger næsten 2 millioner dollars på modforanstaltninger

Verden bevæger sig hurtigt, alt for hurtigt med AI

2 min. Læs

Udgivet den

Læs vores oplysningsside for at finde ud af, hvordan du kan hjælpe MSPoweruser med at opretholde redaktionen Læs mere

Nøgle noter

- Microsoft og OpenAI lancerer en fond på 2 millioner dollars til at bekæmpe deepfakes ved valg.

- Fonden støtter ngo'er, der fremmer AI-uddannelse og bekæmper vildledende AI-indhold.

- Partnere arbejder med træning, kampagner og rammer for ansvarlig AI.

Da 2 milliarder mennesker verden over holder præsidentvalg i deres respektive lande i år, sagde Microsoft og OpenAI, at de lancerer en fond på 2 millioner dollars til at bekæmpe deepfakes.

I tirsdagens meddelelse, Redmonds teknologigigant, $2 millioner-fonden, er en del af, hvad den kaldte en "Societal Resilience Fund" for at fremme AI-uddannelse blandt vælgere over hele verden. Fonden vil derefter støtte ikke-statslige organisationer, der fokuserer på teknologiuddannelse og hvordan man kan bekæmpe brugen af vildledende AI-indhold.

"Lanceringen af Societal Resilience Fund er blot et skridt, der repræsenterer Microsoft og OpenAI's forpligtelse til at løse udfordringerne og behovene inden for AI-kompetencer og uddannelsesområdet," beroliger Microsoft.

Nogle af de fremhævede partnere vil også arbejde på træningsprogrammer, uddannelseskampagner, global træning og rammer for at fremme ansvarlig AI-udvikling.

En af partnerne, Coalition for Content Provenance and Authenticity (C2PA), vil lancere en uddannelseskampagne for at afklare digitale offentliggørelsesmetoder og bedste praksis, der forklarer indholdets oprindelse og vandmærkning af AI-genereret indhold.

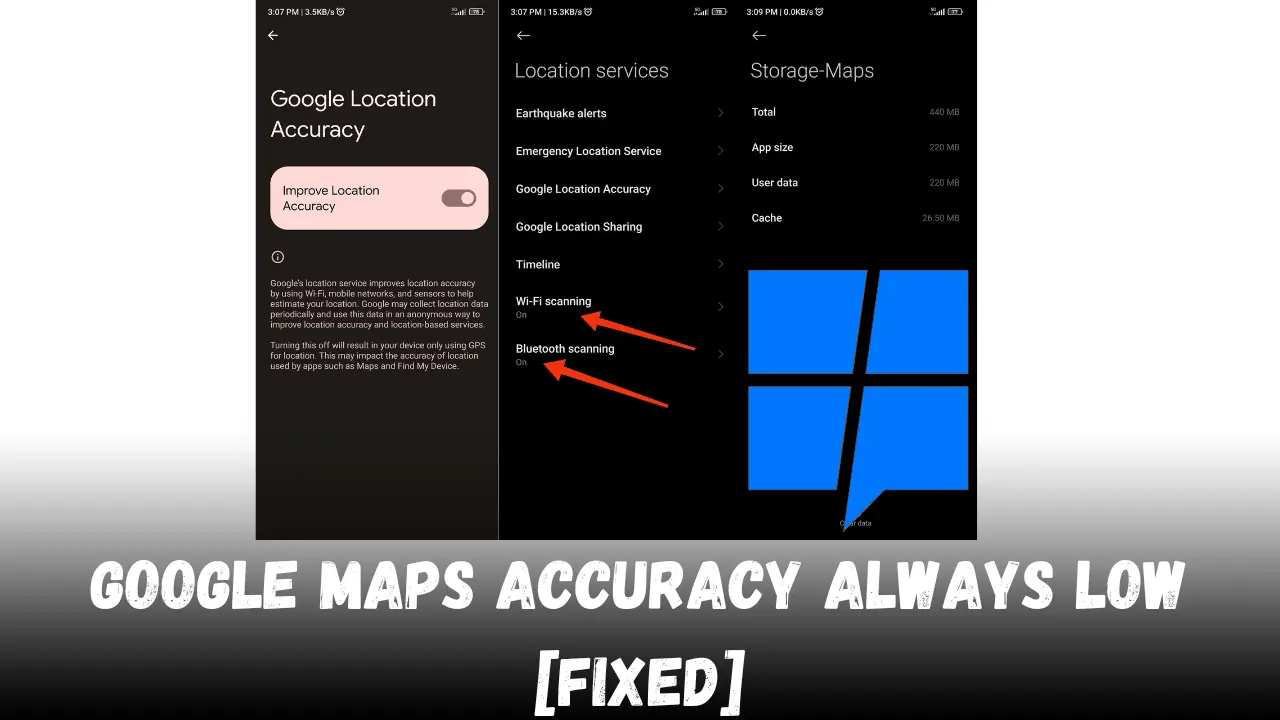

Verden bevæger sig hurtigt, alt for hurtigt med AI. Selv OpenAI-chef Sam Altman er bange for det. Microsoft, som tidligere har godkendt et lovforslag, der forbyder kunstig intelligens i politiske annoncer, har lanceret Indholdsoplysninger at vandmærke AI-indhold digitalt. Systemet blev derefter udviklet af C2PA.

"Brugere kan vedhæfte indholdsoplysninger til deres billeder eller videoer for at vise, hvordan, hvornår og af hvem indholdet blev oprettet eller redigeret, herunder om det blev genereret af AI. Disse legitimationsoplysninger bliver en del af indholdets historie og rejser med det, hvilket skaber en permanent registrering og kontekst, uanset hvor det udgives,” siger Microsoft i endnu et blogindlæg, medforfatter af VC Brad Smith.