Microsoft forklarer, hvorfor LLM'er hallucinerer og finder på svar

2 min. Læs

Opdateret den

Læs vores oplysningsside for at finde ud af, hvordan du kan hjælpe MSPoweruser med at opretholde redaktionen Læs mere

En nylig Twitter-udveksling mellem en bruger og en Microsoft-chef har bragt fornyet opmærksomhed på begrænsningerne ved store sprogmodeller (LLM'er) som Bing og potentialet for informationshuller, når de udelukkende er afhængige af deres interne viden.

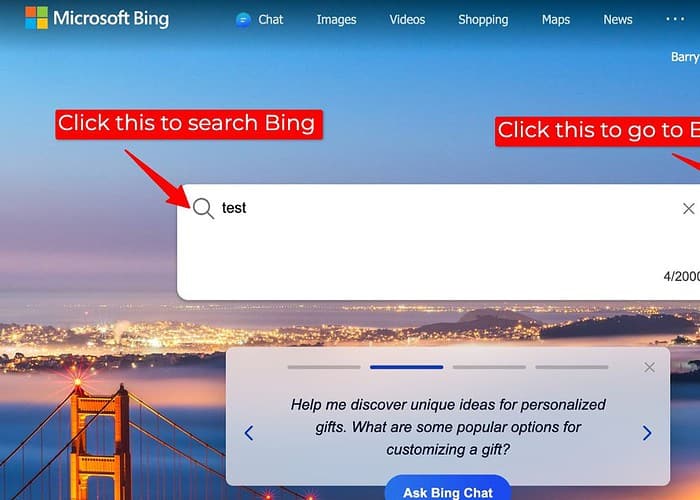

Diskussionen udsprang af en bruger, der rapporterede unøjagtige søgeresultater på Bing, da dets søgeplugin, som tilgår eksterne webdata, blev deaktiveret. Som svar anerkendte Mikhail Parakhin, CEO for Advertising & Web Services hos Microsoft, muligheden for, at LLM'er "finder op" i sådanne situationer.

Han forklarede, at når de er frataget den enorme information, der er tilgængelig via nettet, kan LLM'er nogle gange ty til deres interne vidensbase, en samling af tekst og kode, der bruges til træning, for at generere svar. Imidlertid er denne interne generation muligvis ikke altid nøjagtig eller i overensstemmelse med den faktiske virkelighed, hvilket fører til potentielle uoverensstemmelser i søgeresultaterne sammenlignet med dem, der opnås med søgepluginet aktiveret.

For mig rejser dette vigtige spørgsmål om gennemsigtighed og nøjagtighed i LLM-drevne søgninger, især når eksterne datakilder ikke er tilgængelige. Når LLM'er genererer svar uden at få adgang til eksterne data, bør brugerne have en klar indikation af informationens kilde og eventuelle potentielle begrænsninger.

Selvom det er værdifuldt at give svar, skal LLM'er prioritere pålidelig information frem for at udfylde videnshuller med potentielt unøjagtige interne generationer. At udforske alternative tilgange, såsom at angive usikkerhed, foreslå yderligere forskning eller blot at sige, at et svar er utilgængeligt, kunne øge tilliden og forhindre spredning af misinformation.

Derfor er det ikke underligt hvorfor folk foretrækker ChatGPT frem for Bing Chat/Copilot.

Og af disse grunde foretrækker jeg personligt at bruge Bard, fordi Google har leveret en funktionalitet, hvor Bard lader brugerne vide, om oplysningerne er refereret fra et andet sted eller ej, hvilket gør det lettere for brugerne at stole på oplysningerne.

Brugerforum

0 meddelelser