Co je GPT-3 a jak to ovlivní vaši současnou práci

3 min. číst

Aktualizováno dne

Přečtěte si naši informační stránku a zjistěte, jak můžete pomoci MSPoweruser udržet redakční tým Více informací

GPT je zkratka pro Generative Pre-training Transformer (GPT), jazykový model napsaný Alecem Radfordem a publikovaný v roce 2018 OpenAI, laboratoří Elona Muskse pro výzkum umělé inteligence. Využívá generativní model jazyka (kde se dvě neuronové sítě navzájem zdokonalují konkurencí) a je schopen získat znalosti o světě a zpracovávat dlouhodobé závislosti předtrénováním na různorodých souborech psaného materiálu s dlouhými úseky souvislého textu.

GPT-2 (Generative Pretrained Transformer 2) byl oznámen v únoru 2019 a jedná se o jazykový model transformátoru bez dozoru vyškolený na 8 milionech dokumentů pro celkem 40 GB textu z článků sdílených prostřednictvím příspěvků na Redditu. Elon Musk se skvěle zdráhal ji vydat, protože se obával, že by mohla být použita k spamování sociálních sítí falešnými zprávami.

V květnu 2020 OpenAI oznámila GPT-3 (Generative Pretrained Transformer 3), model, který obsahuje o dva řády více parametrů než GPT-2 (175 miliard vs. 1.5 miliardy parametrů) a který nabízí dramatické zlepšení oproti GPT-2.

Po zadání jakékoli textové výzvy GPT-3 vrátí dokončení textu a pokusí se odpovídat vzoru, který jste mu zadali. Můžete jej „naprogramovat“ tak, že mu ukážete jen několik příkladů toho, co byste chtěli, aby dělal, a poskytne vám kompletní článek nebo příběh, jako je text níže, napsaný výhradně GPT-3.

GPT-3 dosahuje vysokého výkonu u mnoha datových sad NLP, včetně úloh překladu, odpovídání na otázky a zavírání, a také u několika úloh, které vyžadují uvažování za běhu nebo přizpůsobení domény, jako je dekódování slov, pomocí nového slova v věta nebo provádění 3místné aritmetiky. GPT-3 může generovat vzorky zpravodajských článků, které lidští hodnotitelé jen obtížně odlišují od článků napsaných lidmi.

Poslední aplikace vždy dělala starosti OpenAI. GPT-3 je v současné době k dispozici jako otevřená beta, přičemž se očekává, že nakonec bude k dispozici placená soukromá beta. OpenAI uvedla, že ukončí přístup k API pro zjevně škodlivé případy použití, jako je obtěžování, spam, radikalizace nebo astroturfing.

Zatímco nejzjevněji ohroženou populací jsou ti, kteří vytvářejí písemnou práci, jako jsou scénáristé, vývojáři AI již našli překvapivé aplikace, jako je použití GPT-3 k psaní kódu.

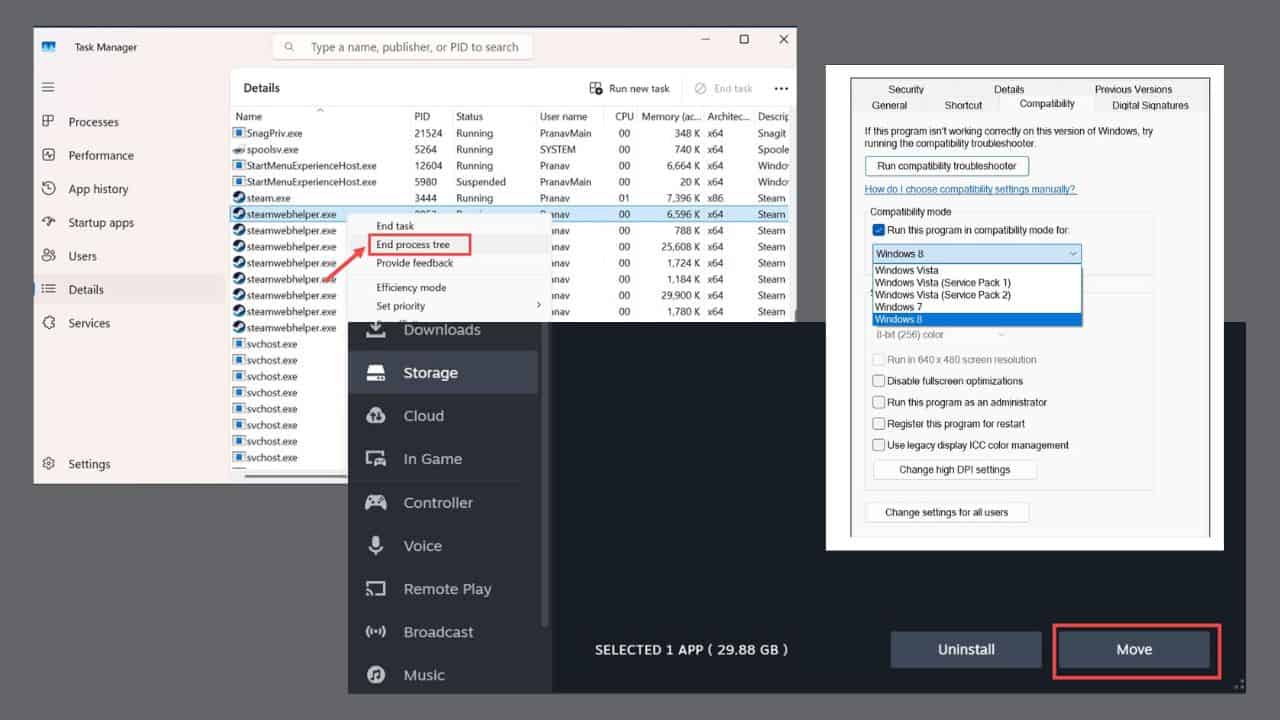

Sharif Shameem například napsal generátor rozložení, kde popíšete prostým textem, co chcete, a model vygeneruje příslušný kód.

To je ohromující.

S GPT-3 jsem postavil generátor rozvržení, kde právě popíšete jakékoli rozvržení, které chcete, a generuje vám kód JSX.

- Sharif Shameem (@sharifshameem) Července 13, 2020

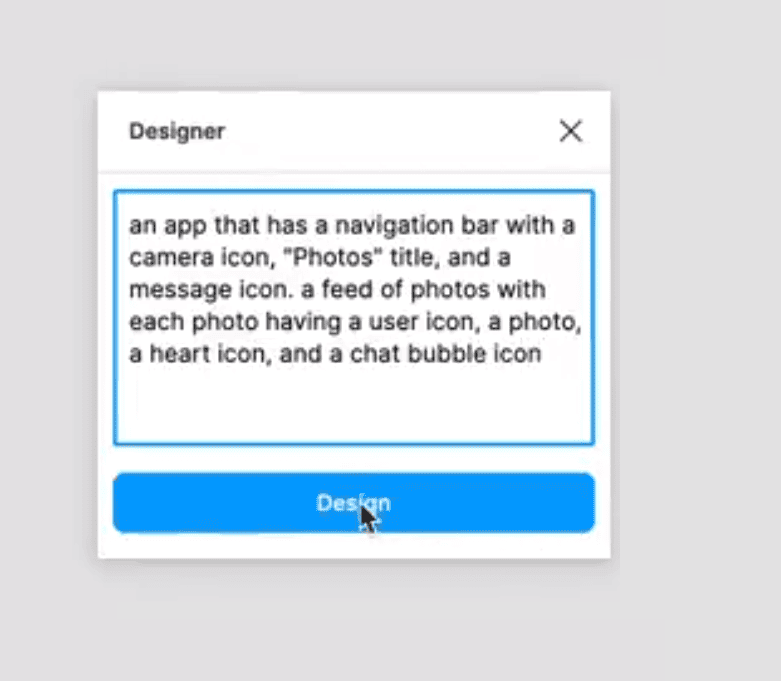

Jordan Singer podobně vytvořil plugin Figma, který umožňuje vytvářet aplikace pomocí prostého textového popisu.

Tím se vše mění. ?

S GPT-3 jsem pro vás vytvořil plugin Figma.

Říkám tomu "designér" pic.twitter.com/OzW1sKNLEC

— jordánská zpěvačka (@jsngr) Července 18, 2020

Může být dokonce použit k diagnostice astmatu a předepisování léků.

So @OpenAI mi poskytli včasný přístup k nástroji, který umožňuje vývojářům používat v podstatě nejvýkonnější generátor textu všech dob. Myslel jsem, že to otestuji tak, že se zeptám na lékařskou otázku. Tučný text je text generovaný AI. Neuvěřitelné… (1/2) pic.twitter.com/4bGfpI09CL

— Qasim Munye (@qasimmunye) Července 2, 2020

Jiné aplikace jsou jako vyhledávač nebo orákulum a lze je dokonce použít k vysvětlení a rozšíření obtížných pojmů.

Vytvořil jsem plně funkční vyhledávač nad GPT3.

Pro jakýkoli libovolný dotaz vrací přesnou odpověď A odpovídající URL.

Podívejte se na celé video. Je to neskutečně dobré.

cc: @gdb @npew @gwern pic.twitter.com/9ismj62w6l

— Paras Chopra (@paraschopra) Července 19, 2020

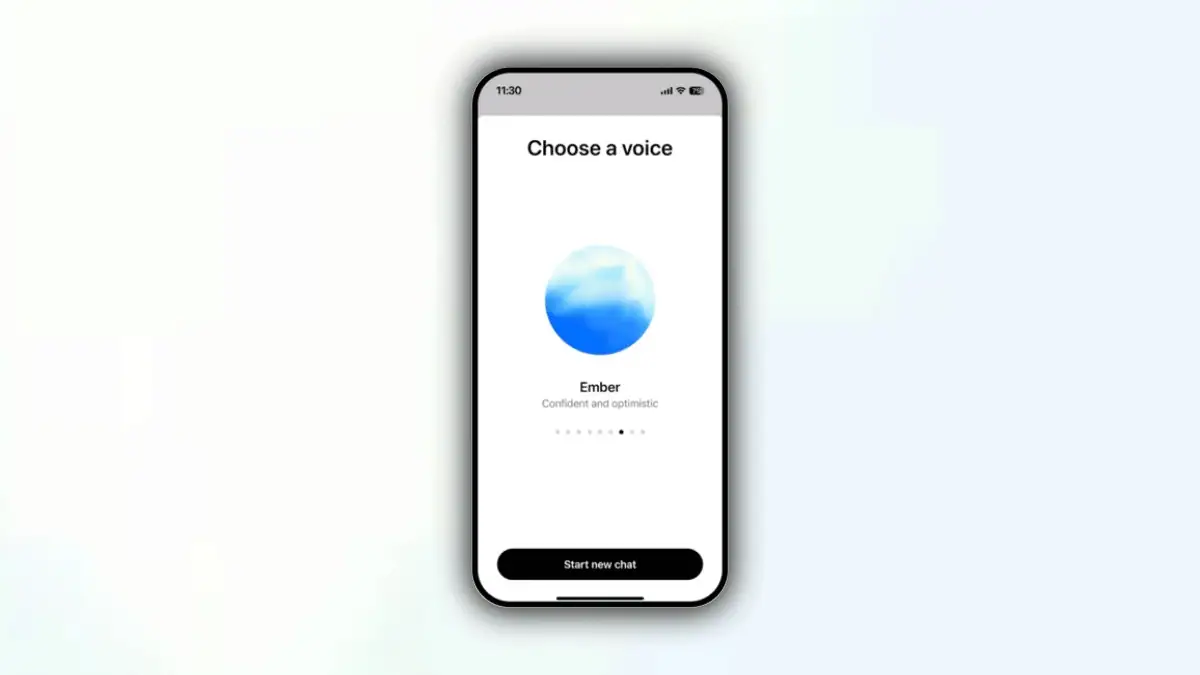

I když se zdá, že tento přístup může vést přímo k obecné umělé inteligenci, která dokáže chápat, uvažovat a konverzovat jako člověk, OpenAI varuje, že mohou narazit na zásadní problémy se škálováním, protože GPT-3 vyžaduje několik tisíc petaflop/s-dnů výpočtu. ve srovnání s desítkami petaflop/s-dny pro plnou GPT-2. Zdá se, že i když jsme blíž, průlom, který způsobí, že všechna naše zaměstnání budou zastaralá, je stále ještě daleko.

Přečtěte si více o GPT-3 na GitHubu zde.

Uživatelské fórum

0 zprávy